W zeszłym tygodniu przeglądałem dwa raporty dotyczące wdrożenia ROBO od operatorów prowadzących floty inspekcyjne.

Pierwszą rzeczą, którą zazwyczaj sprawdzam, nie jest wskaźnik ukończenia. Chodzi o to, jak szybko systemy poprawiają się między wdrożeniami.

Na początku liczby wyglądały prawie identycznie. Wskaźnik ukończenia zadań był stabilny. Przepustowość kolejki była stabilna. Odbitki wykonania zarejestrowane przez warstwę weryfikacyjną ROBO wyglądały czysto.

Ale krzywe poprawy się nie zgadzały.

Roboty jednego z operatorów dostosowywały się znacznie szybciej do nowych środowisk i bardziej złożonych warunków zadań.

Na początku założyłem, że wyjaśnienie tkwi w sprzęcie. Lepsze czujniki. Lepsze modele ruchu.

Na moment to wydawało się prawdopodobne.

Nie miało miejsca.

Różnica ujawniła się w tym, gdzie dane zadania trafiały po zakończeniu.

ROBO zarejestrowało potwierdzenie wykonania. Każde zakończone zadanie produkowało weryfikowalny zapis, który sieć mogła obserwować.

Ale sygnał behawioralny związany z tym zadaniem poszedł gdzie indziej.

Jak robot się poruszał. Gdzie się wahał. Jakie przypadki brzegowe się pojawiły.

Te dane wróciły prosto do prywatnego systemu operatora.

Protokół uchwycił pracę.

Uczenie miało miejsce gdzie indziej.

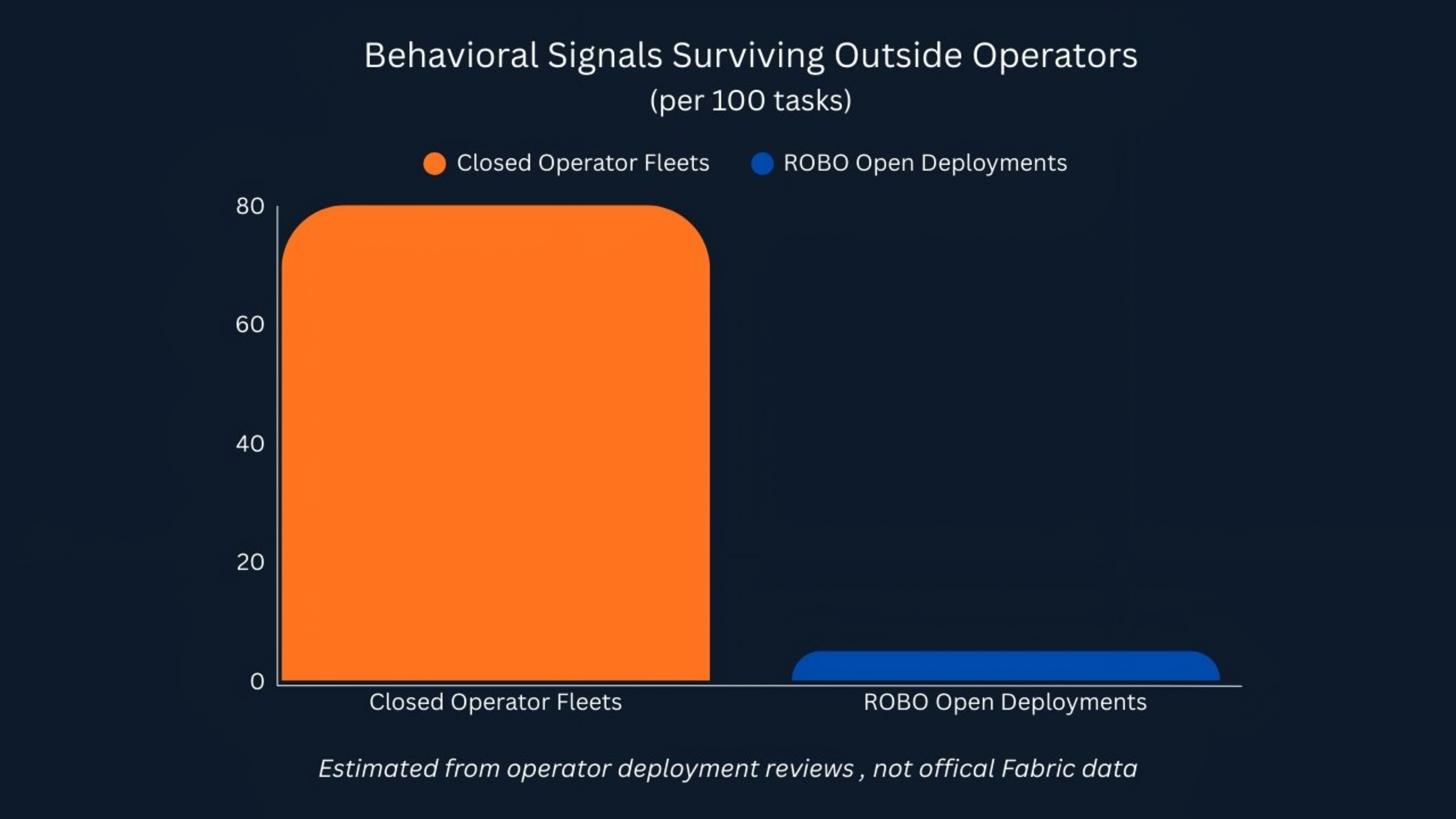

Zacząłem śledzić prosty wskaźnik po tym: sygnały behawioralne przetrwające poza operatorem na 100 zadań.

Wtedy wzór stał się oczywisty.

W większości otwartych wdrożeń, które przeglądałem, ta liczba pozostawała bliska zeru.

Potwierdzenia były publiczne.

Uczenie nie miało miejsca.

W wdrożeniu robotów pętla informacji staje się rowem.

Zamknięci operatorzy gromadzą dane behawioralne przy każdym wdrożeniu. Te dane poprawiają następne wdrożenie, które generuje więcej sygnałów i ponownie udoskonala modele.

Kilka miesięcy później ich roboty zaczynają brać zadania, których nikt inny nie zechce dotknąć.

ROBO koordynuje pracę wśród uczestników. Ale jeśli sygnał behawioralny generowany przez tę pracę nigdy nie opuszcza operatora prowadzącego roboty, pętla uczenia pozostaje zamknięta.

Wzór pojawia się powoli.

Operatorzy z bogatszymi zestawami danych zaczynają obsługiwać bardziej złożone zadania. Uczestnicy otwartej sieci pozostają w prostszych środowiskach. Nowi uczestnicy zaczynają od tej samej bazy za każdym razem.

Sieć pozostaje otwarta.

Pętla informacji nie działa.

Warstwa rynku danych Fabricu celuje dokładnie w tę lukę. Jeśli dane behawioralne dotyczące potwierdzeń zadań ROBO staną się częścią wspólnego zestawu danych, uczenie może zacząć kumulować się w sieci zamiast wewnątrz poszczególnych operatorów.

$ROBO ma znaczenie tylko wtedy, gdy sieć faktycznie uchwyci to uczenie.

Jeśli potwierdzenia zadań pozostają publiczne, podczas gdy sygnały behawioralne pozostają prywatne, otwarta sieć koordynuje pracę, podczas gdy zamknięte systemy stają się coraz mądrzejsze.

Więc prawdziwy test jest prosty.

Gdy wdrożenia ROBO rosną, czy sygnał behawioralny związany z tymi zadaniami zaczyna gromadzić się gdzieś, z czego sieć może się uczyć?

Czy pętla informacji pozostaje prywatna wewnątrz operatorów prowadzących roboty?