Po spędzeniu czasu na czytaniu o tym, jak zbudowana jest sieć Mira, zacząłem postrzegać ją mniej jako kolejny projekt blockchainowy, a bardziej jako próbę rozwiązania czegoś głębszego: luki w niezawodności systemów AI.

Większość modeli AI dzisiaj, niezależnie od tego, jak zaawansowane, wciąż produkuje halucynacje. Generują odpowiedzi, które brzmią poprawnie, ale takie nie są. W systemach scentralizowanych odpowiedzialność za naprawę tego spoczywa na firmie prowadzącej model. Audyty wewnętrzne, dostosowywanie i warstwy bezpieczeństwa odbywają się za zamkniętymi drzwiami. Użytkownicy muszą ufać dostawcy.

Sieć Mira wybiera inną drogę.

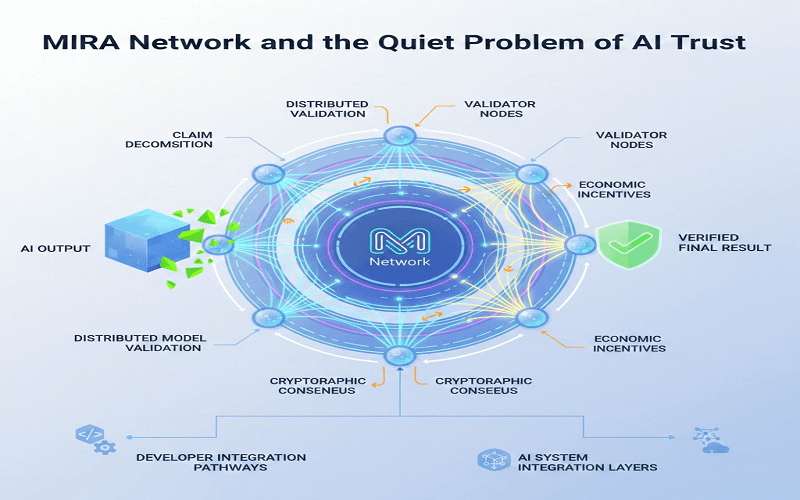

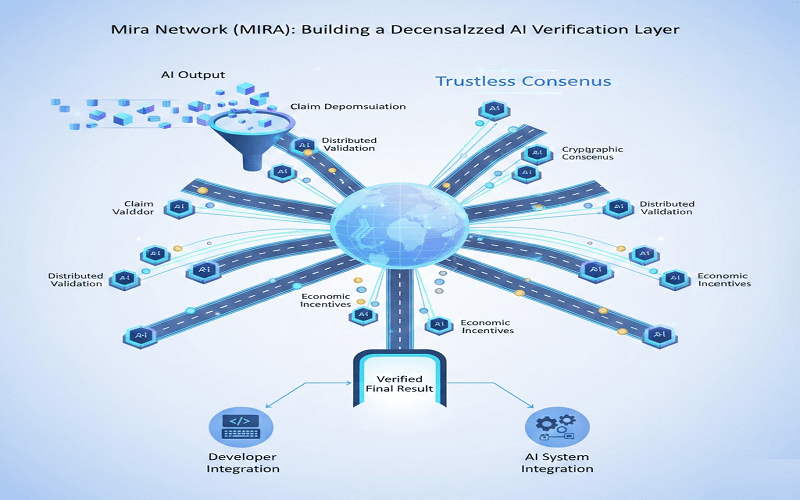

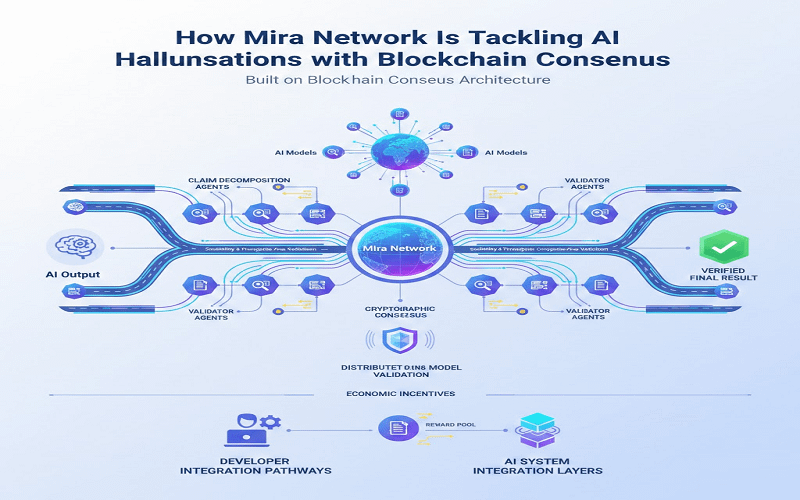

Zamiast zakładać, że jeden model może być w pełni bezpieczny, traktuje wyjścia sztucznej inteligencji jako twierdzenia wymagające weryfikacji. Kiedy AI generuje odpowiedź, protokół Mira rozkłada to wyjście na mniejsze stwierdzenia faktyczne. Te twierdzenia są następnie rozpraszane między niezależne modele w sieci w celu przeprowadzenia weryfikacji krzyżowej. Jeśli wystarczająca liczba z nich zgadza się, twierdzenie zyskuje pewność. Jeśli różnią się, zostaje oznaczone.

Przypomina mi to, jak działa sprawdzanie faktów w dziennikarstwie. Jeden reporter może napisać artykuł, ale przed publikacją recenzują go redaktorzy i niezależne źródła. Mira próbuje sformalizować ten proces, przekształcając go w warstwę protokołu.

Istotną różnicą jest to, że ta weryfikacja nie opiera się na centralnej instytucji. Wykorzystuje konsensus oparty na blockchain oraz dowody kryptograficzne do rejestrowania procesu weryfikacji. Rezultatem nie jest „zaufaj nam”. Jest to zweryfikowane dowód, że wiele niezależnych systemów doszło do podobnych wniosków.

To właśnie w tym miejscu element blockchain staje się praktyczny, a nie symboliczny.

Zamiast przechowywać duże wyjścia sztucznej inteligencji bezpośrednio w łańcuchu, Mira rejestruje wyniki weryfikacji i dowody. Walidatorzy są ekonomicznie motywowani za pomocą tokena $MIRA . Jeśli dostarczają dokładnych weryfikacji, zostają nagrodzeni. Jeśli zachowują się nieuczciwie, system może na nich nałożyć kary. Celem nie jest doskonałość; chodzi o zgodność zachowań z interesami, które prowadzą do uczciwej weryfikacji.

Kiedy przyjrzałem się aktualizacjom i dokumentacji @Mira - Trust Layer of AI , to, co zwróciło moją uwagę, nie były wielkie obietnice. Było to nacisk na strukturalną weryfikację. Protokół nie próbuje zastąpić dużych modeli sztucznej inteligencji. Usytuowany jest pod nimi, niczym warstwa weryfikacyjna.

W tradycyjnym wdrożeniu sztucznej inteligencji firma udostępnia model i być może dodaje narzędzie monitorujące. W przypadku #MiraNetwork weryfikacja staje się zdecentralizowaną infrastrukturą. Każda aplikacja oparta na sztucznej inteligencji – analizy finansowe, narzędzia badawcze, generatory treści – teoretycznie może podłączyć się do tego warstwy, aby sprawdzić wyjścia przed podjęciem działań na ich podstawie.

Ta separacja jest subtelna, ale ważna.

Zamiast pytać: „Czy ta sztuczna inteligencja jest mądra?”, Mira pyta: „Czy możemy zweryfikować to, co właśnie powiedziała?”

Oczywiście system nie jest pozbawiony wyzwań. Rozkładanie wyjść sztucznej inteligencji na strukturalne twierdzenia powoduje dodatkowe obciążenie obliczeniowe. Uruchamianie wielu modeli w celu przeprowadzenia weryfikacji krzyżowej zwiększa koszty. Koordynacja między walidatorami wprowadza nowe komplikacje. A szeroki sektor zdecentralizowanej sztucznej inteligencji staje się coraz bardziej konkurencyjny, ponieważ inne protokoły eksplorują podobne modele weryfikacji lub współdzielenia obliczeń.

Trzeba też uwzględnić fakt, że ekosystem jest jeszcze na początkowym etapie. Stworzenie narzędzi, akceptacja przez deweloperów i standaryzacja wymagają czasu. Warstwa weryfikacyjna staje się istotna tylko wtedy, gdy aplikacje integrują ją w spójny sposób.

Mimo wszystko uważam, że ten sposób myślenia jest przekonujący.

Zamiast gonić za większymi modelami, #Mira skupia się na odpowiedzialności pomiędzy modelami. Przyjmuje, że halucynacje nie znikną z dnia na dzień. Zamiast tego buduje zdecentralizowany system, który zmniejsza ślepą ufność i zastępuje ją zapisanym konsensem.

Ten przeskok od zcentralizowanej gwarancji do weryfikacji bez zaufania wydaje się prawdziwym eksperymentem w tym przypadku.

Niezależnie od tego, czy system się skaluje, czy nie, odzwierciedla rosnącą świadomość, że sama inteligencja nie wystarcza; weryfikacja ma równie duże znaczenie. #GrowWithSAC