Una sera stavo leggendo un rapporto generato da AI che qualcuno aveva condiviso in un gruppo crypto. Sembrava rifinito. Grafici, linguaggio tecnico, dichiarazioni sicure. Tutto sembrava… convincente.

Ma ho trovato un errore. Solo uno.

E all'improvviso tutto sembrava instabile.

Quello piccolo momento è fondamentalmente il motivo per cui esistono reti come Mira.

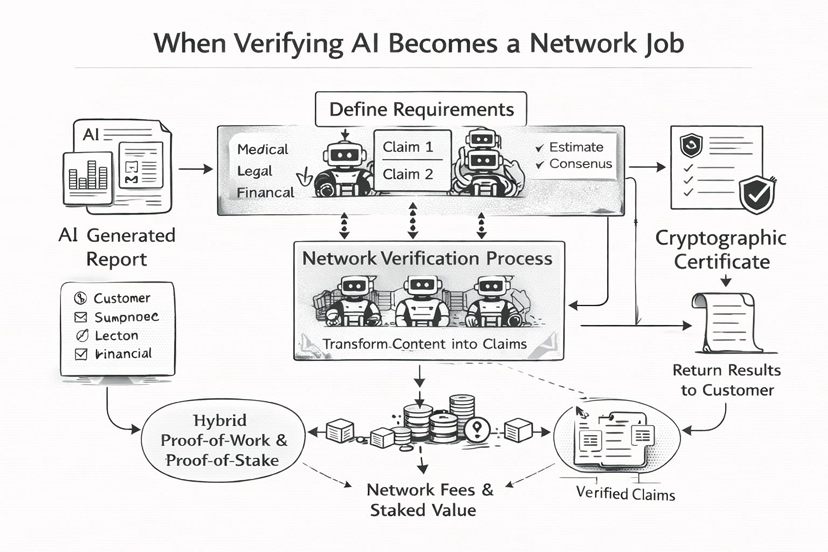

Invece di chiedere alle persone di fidarsi dell'output dell'AI, Mira ha costruito un sistema in cui la verifica stessa diventa un processo di rete. Non una macchina. Non una azienda. Un gruppo distribuito di nodi indipendenti che controllano le stesse affermazioni.

Ecco come funziona.

Un cliente invia contenuti che desidera verificati. Potrebbe essere un documento, una spiegazione tecnica, anche un pezzo di codice. Insieme al contenuto, definiscono i requisiti di verifica, come il dominio della conoscenza o la soglia di consenso.

Medico. Legale. Finanziario.

Poi la rete inizia il suo lavoro silenzioso.

Il sistema trasforma il contenuto in affermazioni individuali mantenendo le loro relazioni logiche. Queste affermazioni sono distribuite tra i nodi verificatori che eseguono modelli di IA. Ogni nodo elabora l'affermazione e invia i risultati della verifica.

Idea semplice.

Ma potente.

I nodi non appaiono semplicemente nel sistema casualmente. Operano in modo indipendente ma devono mantenere standard di prestazioni e affidabilità per rimanere parte della rete. Se le loro risposte si discostano costantemente dal consenso o mostrano segni di scarsa verifica, la loro partecipazione diventa rischiosa.

Una volta che i nodi inviano i risultati, la rete li aggrega e determina il consenso.

E poi succede qualcosa di interessante.

Un certificato crittografico viene generato.

Questo certificato registra l'esito della verifica, compreso quali modelli hanno concordato su ciascuna affermazione. Il cliente riceve sia il risultato che il certificato, essenzialmente una prova verificabile che le informazioni sono state controllate.

Quasi come una ricevuta per la verità.

Dietro a questo sistema si trova un modello economico ibrido che combina Proof-of-Work e Proof-of-Stake. Invece di miner che risolvono enigmi privi di significato, il lavoro qui ha effettivamente valore: verificare le informazioni.

I clienti pagano le commissioni di rete per ottenere output verificati, e tali commissioni sono distribuite agli operatori dei nodi e ai contributori di dati come ricompense.

Ma i designer di Mira hanno notato un problema strano.

Se i compiti di verifica sono standardizzati, ad esempio, domande a scelta multipla, la probabilità di indovinare diventa non banale. Una scelta binaria dà una probabilità del 50% di indovinare correttamente. Con quattro opzioni, è il 25%.

Troppo facile.

Quindi i nodi devono mettere in gioco valore per partecipare. Se il loro comportamento suggerisce indovinare casualmente piuttosto che un'inferenza reale, la loro partecipazione può essere ridotta.

Improvvisamente l'economia cambia.

Indovinare diventa costoso.

La verifica onesta diventa razionale.

E man mano che più nodi si uniscono, qualcosa altro migliora: la diversità.

Modelli diversi portano dati di addestramento diversi, schemi di ragionamento diversi, punti di forza diversi. Questa diversità riduce il bias e rafforza l'affidabilità del consenso finale.

Il sistema evolve anche nel tempo.

All'inizio, gli operatori dei nodi vengono accuratamente selezionati. Successivamente, la rete si decentralizza ulteriormente con modelli di verifica duplicati che elaborano gli stessi compiti. Alla fine, le richieste di verifica vengono frammentate casualmente tra i nodi, rendendo estremamente difficile la collusione.

Strati di sicurezza silenziosa.

Ciò che mi affascina di questa architettura è che tratta le informazioni allo stesso modo in cui le blockchain trattano le transazioni.

Non ti fidi del mittente.

Ti fidi della verifica di rete.

E forse è qui che i sistemi di intelligenza artificiale stanno andando.

Non verso modelli più intelligenti da soli…

ma verso reti che rendono l'intelligenza responsabile.

@Mira - Trust Layer of AI #Mira $MIRA