Zauważyłem coś dziwnego podczas ponownego testowania odpowiedzi AI niedawno 🤔

Wyjaśnienie wyglądało schludnie.

Strukturalne akapity.

Pewny ton.

Szczerze wyglądało to jak coś, co można by przeczytać w wypolerowanym podsumowaniu badań.

Potem sprawdziłem jeden mały szczegół.

Liczba w wyjaśnieniu nie zgadzała się z źródłem.

Nie było też zbytnio błędne… po prostu lekko nietrafione.

I to jest niekomfortowa część obecnych systemów AI.

Są niesamowicie dobrzy w produkowaniu odpowiedzi, które brzmią poprawnie.

Ale nie zawsze wiedzą, czy informacje zawarte w tych odpowiedziach są naprawdę prawdziwe.

Ten moment sprawił, że pomysł stojący za "Mira Network" zaskoczył mnie.

Większość projektów AI koncentruje się na "uczynieniu modeli mądrzejszymi."

Większe zbiory danych do treningu.

Więcej parametrów.

Lepsze modele rozumowania.

Założenie jest takie, że jeśli modele staną się wystarczająco potężne, problem wiarygodności w końcu zniknie.

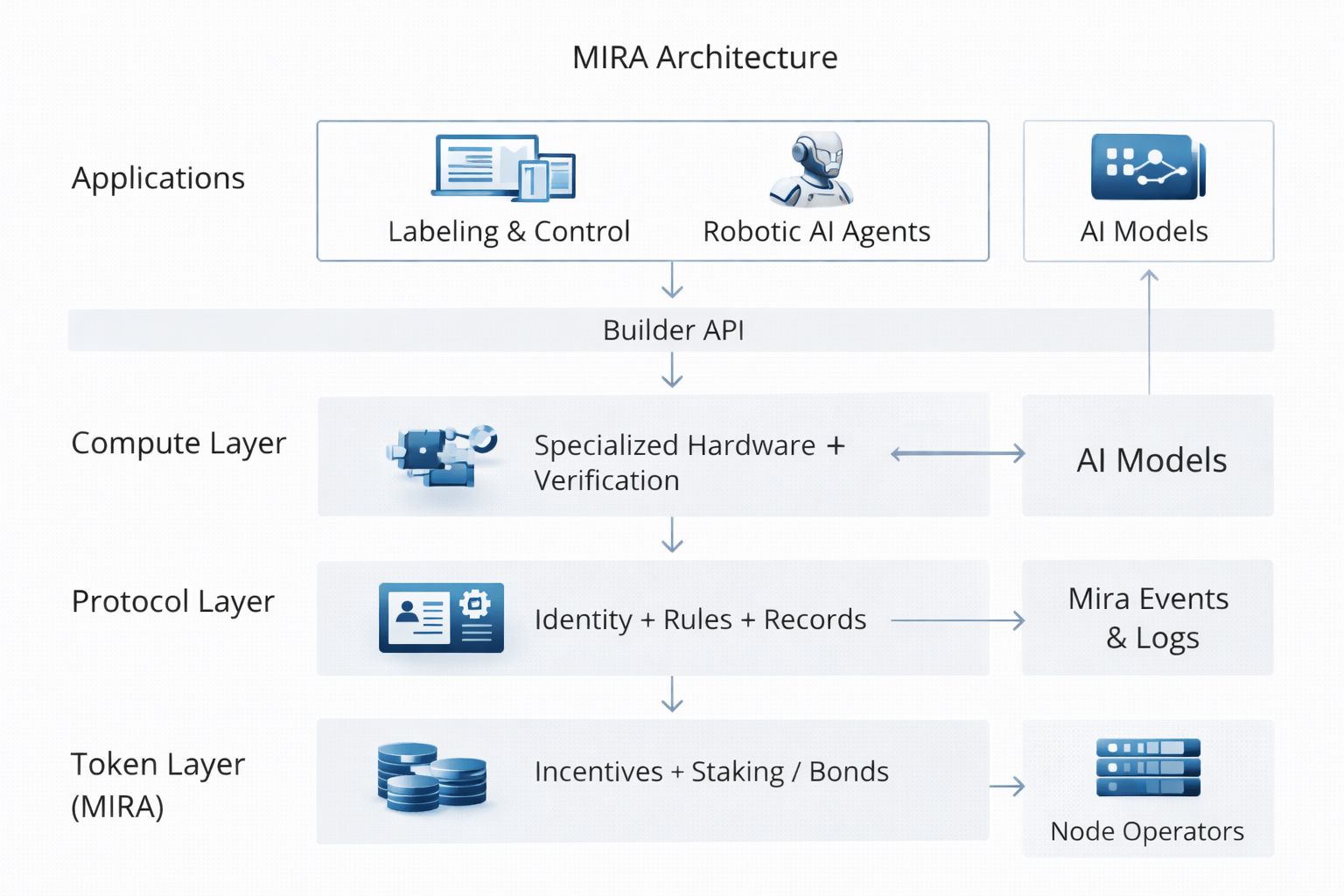

Mira podchodzi do tego z przeciwnej strony.

Zamiast zakładać, że AI stanie się doskonałe… koncentruje się na "weryfikowaniu informacji, które generują te modele."

A szczerze mówiąc, to wydaje się znacznie bardziej realistycznym sposobem radzenia sobie z AI.

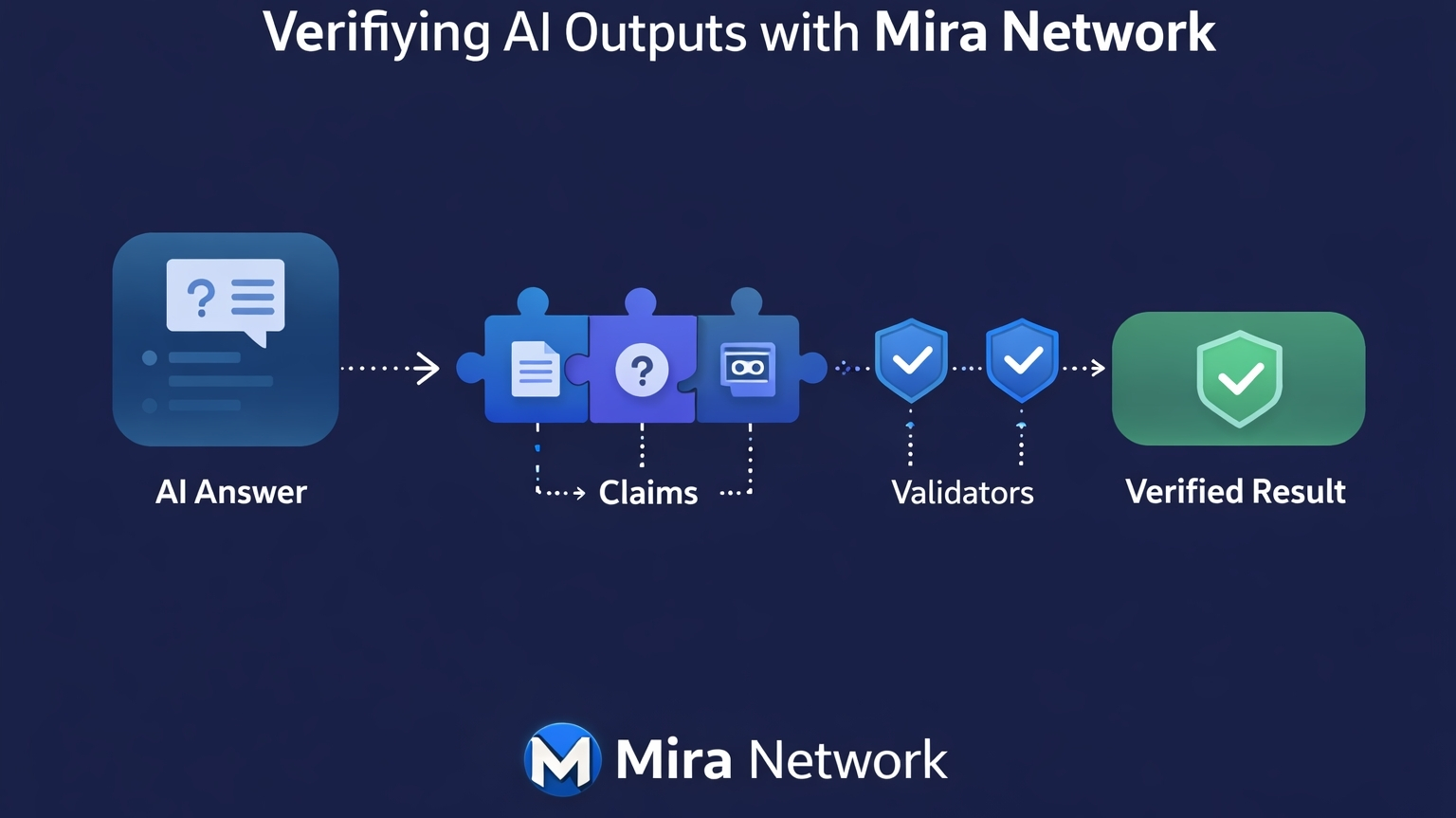

Sposób, w jaki działa Mira, jest naprawdę sprytny.

Gdy AI produkuje odpowiedź, system nie traktuje reakcji jako jednej części informacji.

Zamiast tego wynik można rozłożyć na "indywidualne roszczenia."

Statystyka.

Stwierdzenie.

Odniesienie.

Każde roszczenie staje się czymś, co sieć może ocenić niezależnie.

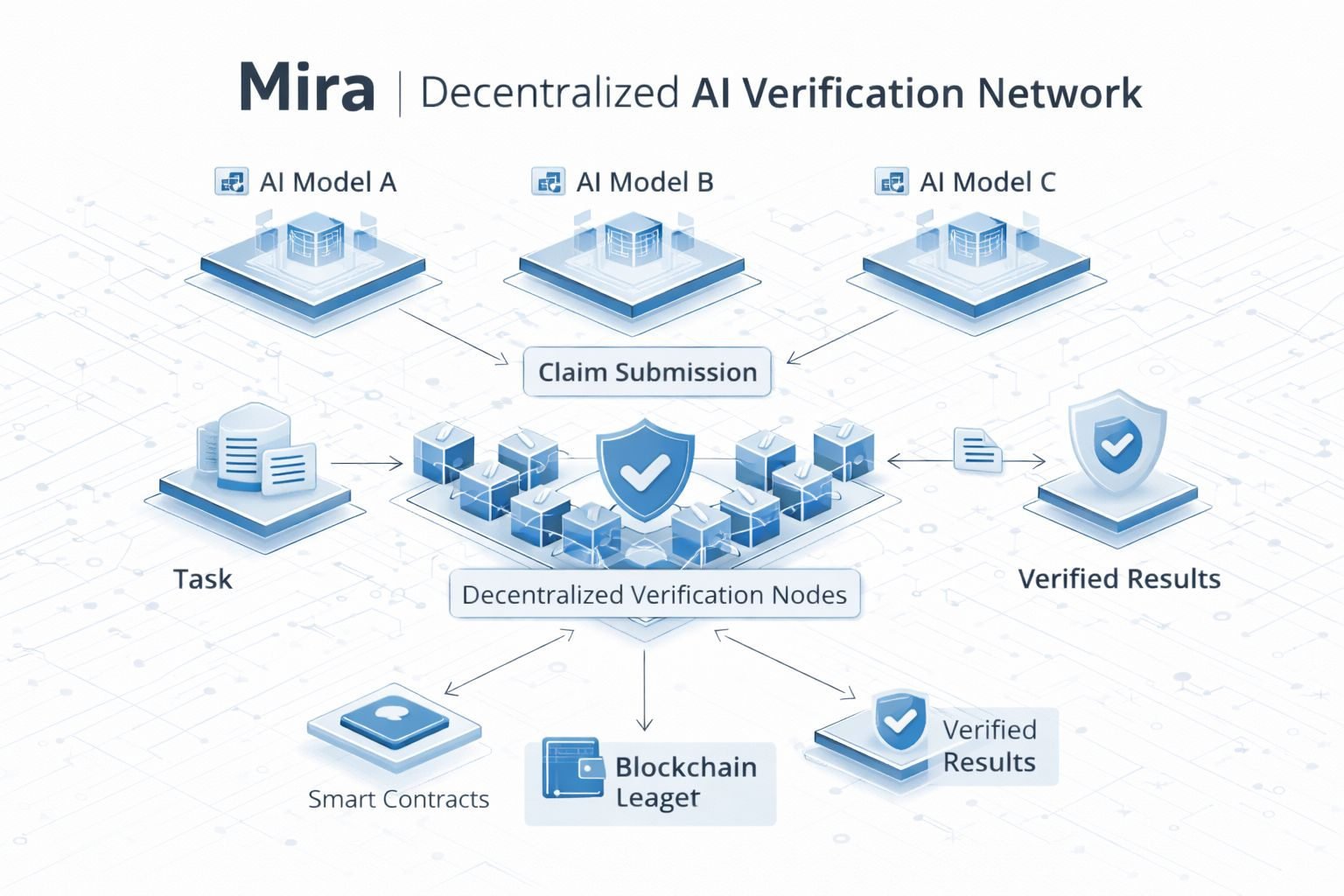

Te twierdzenia są następnie rozdzielane w sieci weryfikatorów.

Niektórzy weryfikatorzy mogą być innymi modelami AI.

Inni mogą być systemami zaprojektowanymi specjalnie do sprawdzania określonych typów informacji.

Zamiast ufać pewności jednego modelu… protokół szuka zgody wśród wielu weryfikatorów.

Jeśli wystarczająca liczba niezależnych weryfikatorów osiągnie ten sam wniosek, roszczenie staje się zweryfikowane, a wynik jest rejestrowany przez konsensus blockchain.

Ta mała zmiana zmienia model zaufania wokół AI dość mocno.

W tej chwili, gdy czytamy odpowiedź AI, zasadniczo działamy jako warstwa weryfikacyjna sami.

Otwieramy nowe karty.

Porównaj odpowiedzi między modelami.

Sprawdź źródła ręcznie.

Mira przenosi ten proces "do protokołu."

Weryfikatorzy są zachęcani do starannego oceniania roszczeń.

Dokładna weryfikacja może przynieść nagrody.

Błędna walidacja może prowadzić do kar.

Z biegiem czasu przekształca to wyniki AI w coś bliższego "weryfikowalnym informacjom zamiast pewnych przypuszczeń."

A ta różnica może mieć znacznie większe znaczenie w niedalekiej przyszłości.

Ponieważ AI powoli wykracza poza bycie tylko asystentem pisania.

Agenci AI już zaczynają wchodzić w interakcje z systemami finansowymi, przepływami pracy badawczej i zautomatyzowaną infrastrukturą.

Gdy maszyny zaczynają działać na informacji automatycznie… nawet małe błędy mogą powodować prawdziwe problemy.

Dlatego pomysł stojący za Mirą utkwił mi w głowie.

Zamiast zakładać, że inteligencja sama w sobie rozwiąże problem… protokół buduje sieć, w której wyniki AI są testowane i weryfikowane zbiorowo.

Mówiąc prosto

AI może generować odpowiedzi.

Ale "sieć decyduje, czy te odpowiedzi mogą być naprawdę ufane."

A szczerze mówiąc, po zobaczeniu kolejnego lekko błędnego wyjaśnienia AI kilka dni temu… ten pomysł nagle wydaje się całkiem konieczny.