Czy model potrafi rozumować?

Czy może podsumować złożone informacje?

Czy może wygenerować coś użytecznego szybciej niż człowiek?

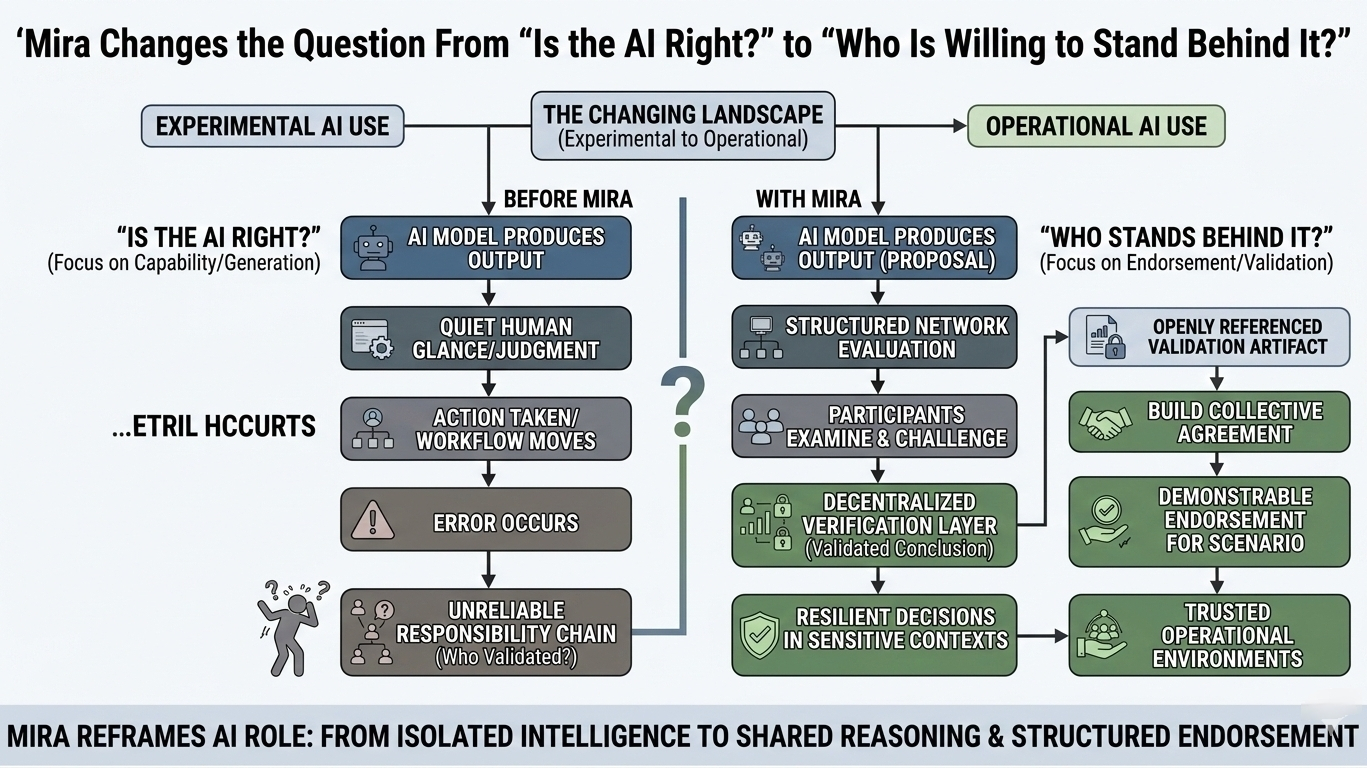

Te pytania miały sens, gdy AI było jeszcze eksperymentalne. Ale gdy te systemy zaczynają wślizgiwać się w prawdziwe środowiska operacyjne, inne pytanie cicho staje się ważniejsze.

Kto jest gotów stanąć za wynikiem?

To pytanie rzadko pojawia się w benchmarkach, a jednak kształtuje prawie każde poważne wdrożenie. W instytucjach finansowych, na przykład, wyzwaniem nie jest spowodowanie, by system AI analizował dokument lub flagował podejrzaną działalność. Modele już potrafią to robić. Wyzwaniem jest określenie, czy wynik można traktować jako coś wykonalnego, nie nakładając całej odpowiedzialności na osobę, która kliknęła „zatwierdź.”

Innymi słowy, prawdziwy punkt tarcia nie jest w generacji. To jest w zatwierdzeniu.

Mira wydaje się być zbudowana wokół tej dokładnej napięcia.

Zamiast traktować wyniki AI jako gotową odpowiedź, Mira przedstawia je bardziej jako propozycję — coś, co można zbadać, podważyć i zweryfikować w ramach zorganizowanej sieci, zanim stanie się czymś, na czym inni polegają. Zmiana może wydawać się subtelna, ale całkowicie przekształca rolę AI.

W większości dzisiejszych wdrożeń łańcuch odpowiedzialności jest kruchy. Model produkuje odpowiedź. Osoba na nią zerka. Przepływ pracy posuwa się naprzód. Jeśli wynik później okazuje się problematyczny, pytanie staje się niewygodne: kto właściwie zweryfikował rozumowanie?

Odpowiedź jest zazwyczaj niejasna.

Mira wprowadza inną strukturę, w której akceptacja wyniku może być powiązana z widocznym procesem oceny, a nie cichym momentem ludzkiego osądu. To nie oznacza, że system magicznie eliminuje błędy. To, co zmienia, to sposób, w jaki zgoda formuje się wokół wniosku AI.

Zamiast opierać się na indywidualnej dyskrecji, zgoda staje się czymś, co powstaje poprzez uczestnictwo.

Ma to znaczenie, ponieważ środowiska, w których AI ostatecznie będzie miało największy wpływ, to także te, w których nieformalne zaufanie najszybciej się załamuje. Finanse, zarządzanie, interpretacja regulacyjna, analiza ryzyka — to są dziedziny, w których decyzje muszą przetrwać kontrolę z wielu kierunków. Kontrahenci, audytorzy, organy regulacyjne i partnerzy wszyscy mają motywacje, aby zapytać, jak osiągnięto dany wniosek.

Gdy jedyną odpowiedzią jest „model to zasugerował”, zaufanie szybko maleje.

Model Miry sugeruje sposób na zakotwiczenie tego momentu akceptacji w czymś bardziej trwałym. Wprowadzając zdecentralizowaną warstwę weryfikacji, system tworzy miejsce, w którym ocena staje się działaniem, które uczestnicy mają motywacje do wykonywania starannie. Walidacja nie jest tylko uprzejmością. Staje się częścią struktury ekonomicznej i proceduralnej sieci.

Ten pomysł zmienia rolę AI z izolowanej inteligencji na wspólne rozumowanie.

A wspólne rozumowanie zmienia sposób, w jaki systemy się komponują.

W tradycyjnych pipeline'ach AI wyniki są efemeryczne. Pojawiają się w aplikacji, wpływają na decyzję i znikają w logach lub archiwach. Inne systemy, które wchodzą w interakcję z wynikiem, mają małą widoczność w tym, jak to zostało zweryfikowane. Cały proces pozostaje nieprzejrzysty poza oryginalnym środowiskiem.

Mira działa w przeciwnym kierunku. Zamiast pozwalać wynikom znikać w granicach aplikacji, daje im powierzchnię, na której aktywność walidacyjna może odbywać się otwarcie. To przekształca wnioski AI w artefakty, do których wiele podmiotów może się odwoływać, a nie w prywatne sugestie w ramach pojedynczego przepływu pracy.

Z biegiem czasu może to zmienić sposób, w jaki organizacje myślą o wdrażaniu AI w wrażliwych kontekstach.

W tej chwili wiele instytucji spowalnia adopcję AI nie dlatego, że wątpią w jego użyteczność, ale dlatego, że nie mogą łatwo udowodnić, jak jego wyniki były oceniane. Zespoły ds. zgodności martwią się o audytowalność. Ofiary ryzyka martwią się o odpowiedzialność. Inżynierowie kończą budowanie ręcznych systemów nadzoru, które ograniczają przewagę prędkości, jaką AI miało przynieść.

Zorganizowana warstwa walidacji zmienia tę dynamikę.

Jeśli akceptacja sama w sobie stanie się częścią widocznego procesu, organizacje zyskują coś, czego obecnie brakuje: sposób na udowodnienie, że decyzje oparte na AI przeszły przez kontrolę, a nie wygodę. Tego rodzaju demonstracyjność ma znaczenie, gdy decyzje muszą być bronione po fakcie.

Istnieje również implikacja ekosystemowa.

Jeśli wiele niezależnych systemów zacznie polegać na wynikach AI, potrzebują wspólnej powierzchni, na której te wyniki mogą być badane. Bez tego każda integracja tworzy swój własny prywatny model zaufania. Każda organizacja buduje swój własny proces oceny, a interoperacyjność staje się krucha.

Wspólne środowisko walidacji zmniejsza tę fragmentację.

Zamiast tego, aby każdy uczestnik wymyślał nadzór na nowo, sieć staje się miejscem, gdzie sama ocena jest kompozycyjna. Systemy mogą polegać na wnioskach nie tylko dlatego, że zostały wygenerowane, ale dlatego, że przetrwały badanie w ramach procesu, który wszyscy rozumieją.

To, co czyni to szczególnie interesującym, to że Mira nie musi zastępować istniejących modeli AI, aby osiągnąć ten efekt. Działa na innej warstwie stosu. Modele generują. Mira strukturyzuje, jak te generacje stają się akceptowanymi wynikami.

To rozdzielenie jest strategiczne.

Tempo rozwoju modelu jest nieprzewidywalne. Nowe architektury pojawiają się nieustannie. Wskaźniki wydajności zmieniają się co kilka miesięcy. Próba wygrania wyścigu inteligencji bezpośrednio jest kosztowna i niestabilna.

Budowanie warstwy, która organizuje, jak inteligencja staje się użyteczna, może okazać się znacznie trwalsze.

Ponieważ niezależnie od tego, które modele dominują w przyszłości, pytanie o zatwierdzenie pozostanie.

Ktoś zawsze będzie musiał zdecydować, czy wniosek wygenerowany przez AI jest wystarczająco silny, aby na nim działać. A gdy ta decyzja jest nieformalna, systemy gromadzą ukryte ryzyko. Gdy ta decyzja jest zorganizowana, systemy zyskują odporność.

Architektura Miry sugeruje przyszłość, w której ten moment zatwierdzenia nie jest już niewidoczny.

Zamiast cicho ufać odpowiedzi, ponieważ wydaje się przekonująca, systemy mogą polegać na fakcie, że inni ją zbadali, podważyli i ostatecznie stali za nią.

To nie czyni AI nieomylnym.

Ale sprawia, że zgoda co do wniosków AI staje się czymś, co można budować, obserwować i rozumieć zbiorowo.

A gdy AI wchodzi głębiej w środowiska, w których decyzje mają realne konsekwencje, zdolność do pokazania, kto stał za odpowiedzią, może być nawet ważniejsza niż sama odpowiedź.