Roboty przechodzą z kontrolowanych demonstracji do chaotycznych rzeczywistych środowisk, a największym problemem nie zawsze jest zdolność — to wiarygodność. Gdy coś pójdzie źle, ludzie nie tylko pytają „czy to robot to zrobił?” Pytają, która jednostka to była, jaką wersję oprogramowania uruchomiła, kto zatwierdził tę wersję, jakie zasady bezpieczeństwa były aktywne i czy dowody mogą być zaufane poza własnymi dziennikami operatora. Większość czasu te odpowiedzi znajdują się w prywatnych pulpitach nawigacyjnych. To działa, dopóki wielu interesariuszy nie musi zgodzić się na ten sam harmonogram: operatorzy, partnerzy, właściciele miejsc, audytorzy, ubezpieczyciele i organy regulacyjne.

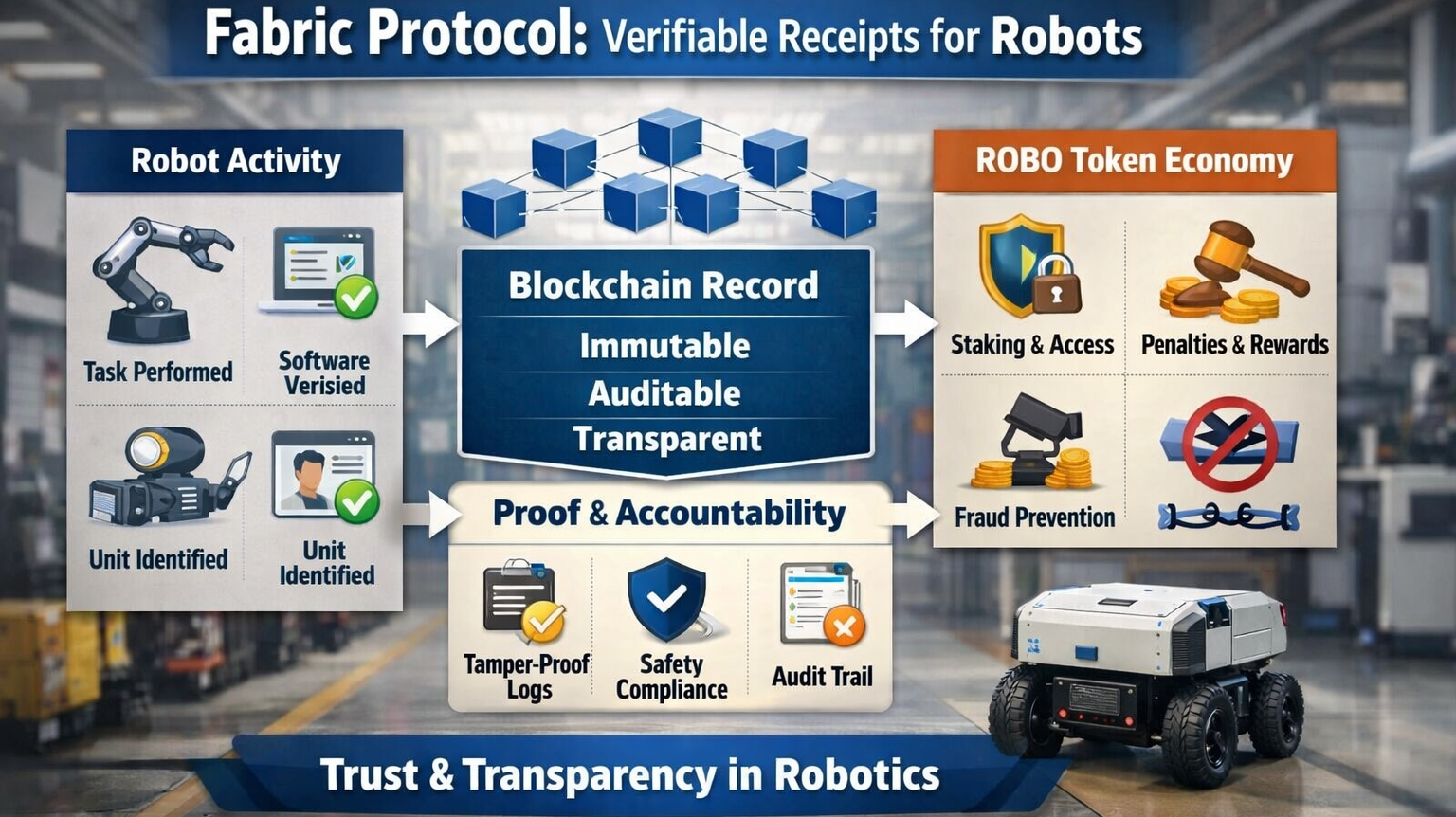

Protokół Fabric opiera się na idei, że roboty powinny tworzyć zapisy, które mogą być później sprawdzane przez strony, które nie ufają sobie automatycznie. Pomyśl o tym jako o próbie ustandaryzowania tożsamości i odpowiedzialności dla robotów, w taki sposób, w jaki nowoczesne systemy ustandaryzowują bezpieczeństwo dla użytkowników. Nacisk kładziony jest na obliczenia weryfikowalne i infrastrukturę, która traktuje działania robotów jak zdarzenia, które mogą być zaświadczane, kwestionowane i audytowane. Zamiast polegać na „zaufaj nam, nasza telemetria tak mówi”, podejście Fabric zmierza w kierunku wspólnych dowodów i publicznego śladu zatwierdzeń oraz polityk, które sprawiają, że post-incident analizy są mniej subiektywne.

W momencie otwarcia sieci takiej jak ta, otwierasz również drzwi do oszustw. Jeśli w „pracy robota” są pieniądze, ludzie będą próbowali to sfałszować — symulować zadania, odtwarzać dzienniki, fałszować czujniki lub tworzyć dobrze wyglądające raporty. Dlatego logika Fabric nieustannie wraca do sporów i egzekwowania. Sieć, która nie może karać za nieuczciwość, kończy na nagradzaniu najlepszych kłamców, a nie najlepszych operatorów. W robotyce jest to szczególnie niebezpieczne, ponieważ koszt niepowodzenia nie jest tylko finansowy; może być fizyczny.

ROBO wpisuje się w to jako coś więcej niż prosty token nagradzający. W projekcie takim jak Fabric, token sprawia, że uczestnictwo jest kosztowne w odpowiedni sposób: opłaty za korzystanie z sieci, wiązanie lub stakowanie, aby uzyskać dostęp, oraz kary, gdy zachowanie łamie zasady lub dowody nie spełniają wyzwań. Ta struktura ma znaczenie, ponieważ przekształca weryfikację z miłej idei w system ekonomiczny. Jeśli chcesz twierdzić, że robot wykonał pracę, powinieneś być gotowy poprzeć to twierdzenie czymś, co jest na szali.

Co czyni to interesującym, to kierunek zachęt. Zamiast płacić ludziom tylko za zgłaszanie aktywności, wartość systemu pochodzi z czynienia aktywności udowodnionymi. Jeśli Fabric stanie się użyteczny, prawdopodobnie dlatego, że zmniejsza „podatek od sporów” dotyczących robotyki — mniej czasu spędzonego na walce o dzienniki, więcej czasu na bezpieczne działanie na dużą skalę. A jeśli tak się stanie, ROBO staje się warstwą koordynacyjną, która łączy dostęp, zasady i odpowiedzialność w jedną wspólną

ramy