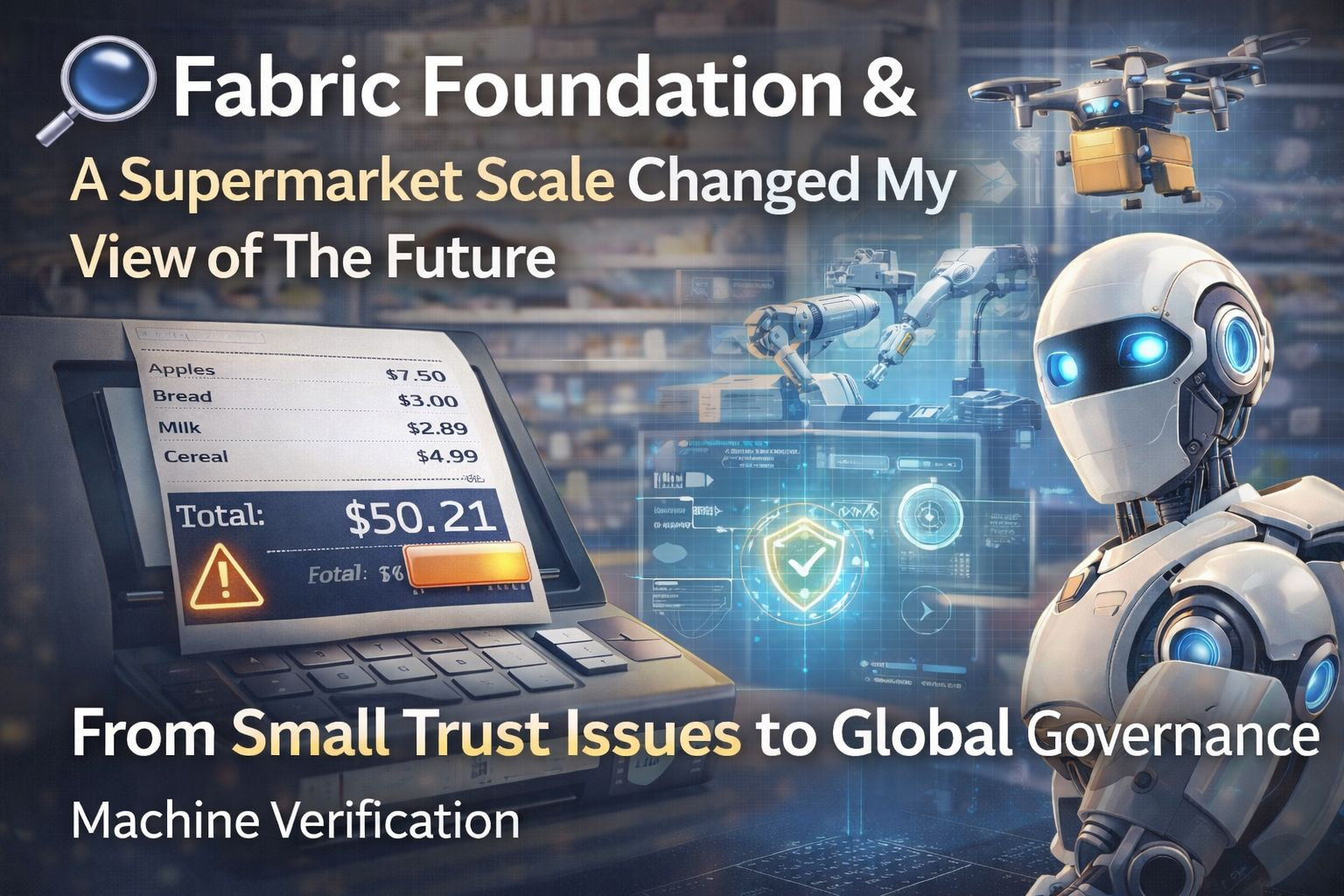

Zaczęło się od czegoś małego.

Położyłem torbę z jabłkami na wadze w supermarkecie.

Numer wydawał się błędny.

Zdjąłem torbę.

Położyłem ją z powrotem.

Wciąż źle.

Maszyna nie wyjaśniła się.

Nie uzasadniła obliczeń.

Po prostu wyświetliła numer — i oczekiwała zaufania.

W tej małej chwili zdałem sobie sprawę z czegoś większego.

Jeśli nie możemy zweryfikować prostej wagi…

jak zweryfikujemy inteligentne maszyny, które rządzą naszym światem?

🤖 Od wag spożywczych do systemów autonomicznych

Dziś systemy sztucznej inteligencji nie ograniczają się już do chatbotów i silników rekomendacyjnych.

Są to:

Pomoc chirurgom w salach operacyjnych

Zarządzanie flotami dronów dostawczych

Optymalizacja linii produkcyjnych w fabrykach

Kontrola sieci energetycznych

Przydział zasobów szpitalnych

Te systemy nie tylko obliczają liczby.

Podejmują decyzje.

I te decyzje mają konsekwencje.

Ale oto niekomfortowa prawda:

Większość tych systemów działa jak czarne pudła.

Mówią nam, by im zaufać.

A jednak rzadko mamy okazję je zweryfikować.

⚖️ Prawdziwym problemem nie jest sztuczna inteligencja. Chodzi o odpowiedzialność.

Gdy skala w supermarkecie jest nieprawidłowa, szkody są niewielkie.

Może kilka dodatkowych dolarów.

Ale co jeśli chirurg z wykorzystaniem sztucznej inteligencji wyda rekomendację?

Co gdy algorytm logistyczny priorytetowo wybiera drogi?

Co gdy system robotyczny kontroluje infrastrukturę?

Stawki stają się ogromne.

Bez odpowiedniej infrastruktury rządzącej ryzykujemy:

Nieprzejrzyste podejmowanie decyzji

Centralizowane sterowanie

Wyjścia niepodlegające weryfikacji

Koncentracja władzy ekonomicznej

Niezgodność między motywacjami maszyn a wartościami ludzkimi

Samego zaufania nie wystarcza.

Weryfikacja musi rosnąć wraz z inteligencją.

🧠 Wkraczamy do Fundacji Fabric

Fundacja Fabric pracuje nad czymś, o czym większość ludzi nie myśli — ale z czasem będzie na tym zależało.

Skupia się na budowaniu:

Obserwowalne zachowanie maszyn

Przejrzyste ramy rządzenia

Otwarta, trwała infrastruktura

Systemy koordynacji zdecentralizowanej

W prostych słowach:

Fabric ma na celu stać się warstwą weryfikacyjną dla inteligentnych maszyn.

Nie po to, by je zastąpić.

Nie po to, by je kontrolować.

Ale aby zapewnić, że ich działania pozostaną zgodne, audytowalne i podlegające kontroli.

🌍 Od małych kwestii zaufania do globalnego rządzenia

Skala w supermarkecie nie była tylko uszkodzonym urządzeniem.

To był przedsmak.

Sztuczna inteligencja opuszcza świat cyfrowy i wkracza do świata fizycznego.

A nasze instytucje — prawne, finansowe, gospodarcze — nigdy nie zostały zaprojektowane z myślą o udziału maszyn.

Jeśli inteligentne systemy zaczną działać jako uczestnicy gospodarki, decydenci i autonomiczni operatorzy, potrzebujemy nowych torów.

Tory rządzące.

Tory ekonomiczne.

Tory weryfikacji.

To właśnie ta warstwa, którą Fabric przygotowuje do budowy.

🔐 Przyszłość będzie wymagała weryfikacji

Przechodzimy od:

„Zaufaj maszynie.“

Do:

„Dowód dla maszyny.“

Przyszłość nie zostanie określona przez to, jak inteligentna stanie się sztuczna inteligencja.

Zdefiniuje ją to, jak bardzo będziemy wymagali od niej odpowiedzialności.

Bo jeśli nie możemy zweryfikować skali…

Jak możemy zweryfikować chirurga napędzanego sztuczną inteligencją?

Flota dronów poruszających się po miastach?

Fabryka obsługiwana w całości przez autonomiczne systemy?

Skala zmieniła moje spojrzenie.

Przypomniało mi to, że niewielkie niedociągnięcia w zaufaniu ujawniają większe luki w infrastrukturze.

A prawdziwa przyszłoszczepionka nie będzie polegać na tym, kto zbuduje mądrzejsze maszyny.

Będzie zależeć od tego, kto wybuduje systemy rządzące wystarczająco silne, by je wspierać.

@Fabric Foundation #ROBO $ROBO