Mira Network to jeden z tych projektów, które postanowiłem zbadać, nie z powodu hype'u, ale z praktycznego pytania: jak właściwie weryfikujemy informacje generowane przez AI w sposób, który nie zależy od zaufania jednej firmie?

Po przeczytaniu projektu protokołu i śledzeniu aktualizacji z @Mira - Trust Layer of AI , stało się jasne, że Mira Network koncentruje się na czymś bardzo konkretnym. Nie próbuje zbudować kolejnego dużego modelu językowego. Tworzy zdecentralizowaną warstwę weryfikacyjną dla systemów AI.

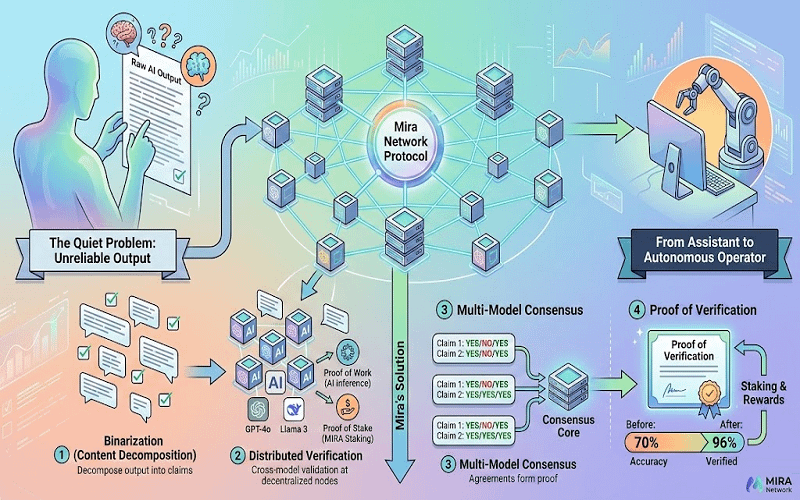

Główna idea stojąca za #MiraNetwork jest prosta, ale ważna. Modele AI generują wyniki, które często brzmią pewnie, nawet gdy są błędne. Halucynacje, subtelne uprzedzenia, sfałszowane cytaty, to nie są rzadkie przypadki skrajne. To strukturalne słabości w tym, jak duże modele przewidują tekst.

Mira podchodzi do tego, traktując wyniki AI jako zestawy twierdzeń, a nie jako pojedynczy blok tekstu.

Zamiast pytać: „Czy ta cała odpowiedź jest poprawna?”, protokół dzieli wynik na mniejsze, weryfikowalne stwierdzenia. Każde twierdzenie może być następnie oceniane niezależnie przez inne modele AI działające jako weryfikatory.

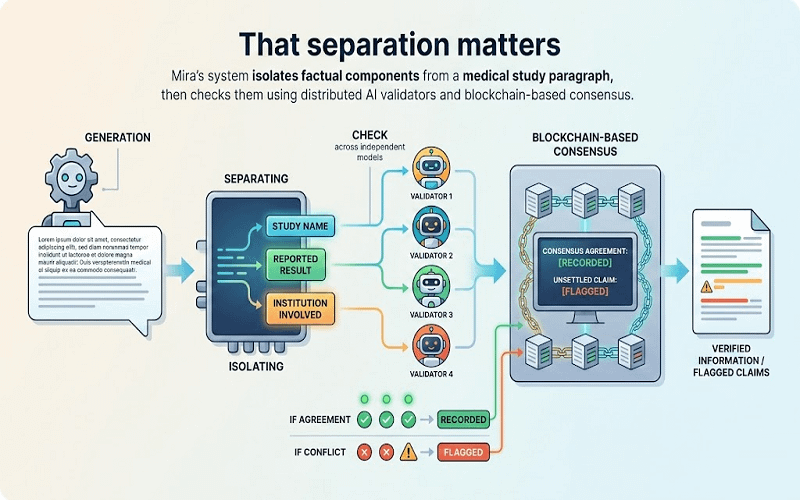

To rozdzielenie ma znaczenie.

Jeśli jeden model generuje akapit o badaniu medycznym, system Miry izoluje faktyczne składniki. Na przykład nazwa badania, zgłoszony wynik, zaangażowana instytucja. Te elementy są następnie sprawdzane w niezależnych modelach. Jeśli wiele modeli się zgadza, ta zgoda jest rejestrowana. Jeśli się różnią, twierdzenie jest oznaczane.

Przypomina mi, jak działają sieci weryfikacji faktów w dziennikarstwie. Jeden reporter pisze historię, ale redaktorzy i zewnętrzni recenzenci weryfikują poszczególne fakty. Różnica polega na tym, że „redaktorzy” to rozproszeni walidatorzy AI koordynowani przez konsensus oparty na blockchainie.

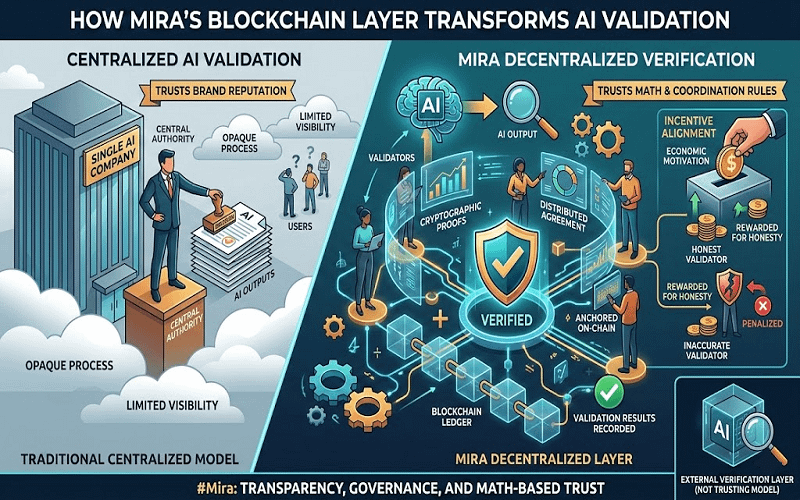

Tutaj warstwa blockchain staje się istotna.

Zamiast polegać na centralnej władzy, aby ogłosić coś zweryfikowanym, Mira wykorzystuje dowody kryptograficzne i mechanizmy rozproszonego porozumienia do rejestrowania wyników weryfikacji. Gdy twierdzenie zostanie ocenione i osiągnięty zostanie konsensus, wynik ten jest zakotwiczony w łańcuchu. Zaufanie pochodzi z matematyki i zasad koordynacji, a nie z reputacji marki.

Token $MIRA odgrywa rolę w dostosowywaniu zachęt wewnątrz tego systemu. Walidatorzy są motywowani ekonomicznie do uczciwego zachowania, ponieważ niepoprawna weryfikacja może być ukarana. Teoretycznie zmniejsza to ryzyko zmowy lub niedbałej weryfikacji.

Co odróżnia to od scentralizowanej weryfikacji AI to zarządzanie i przejrzystość. W typowym ustawieniu jedna firma decyduje, jak są testowane wyniki, co liczy się jako dokładne i jak są obsługiwane poprawki. Użytkownicy mają ograniczoną widoczność w tym procesie.

Z #Mira warstwa weryfikacji jest zewnętrzna w stosunku do samego modelu. Nie zakłada, że model jest godny zaufania. Zakłada przeciwnie i buduje mechanizm do ciągłego testowania.

To rozdzielenie wydaje się strukturalnie czystsze.

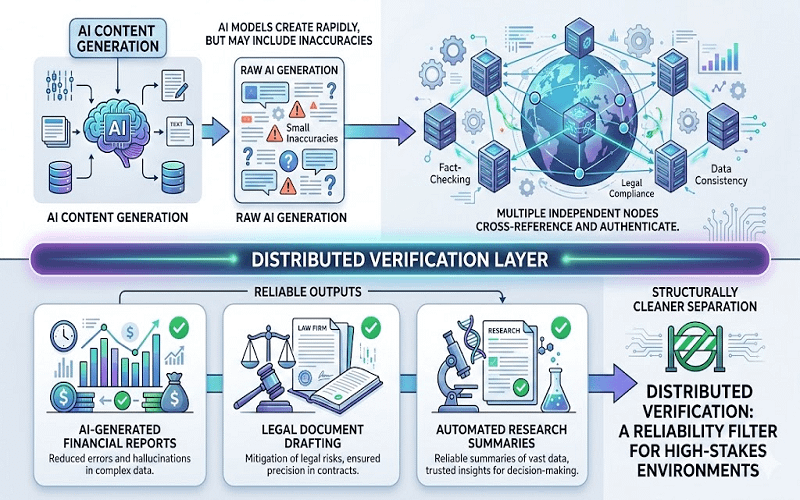

Otwiera również praktyczne przypadki użycia. Pomyśl o raportach finansowych generowanych przez AI, sporządzaniu dokumentów prawnych czy automatycznych streszczeniach badań. W tych obszarach nawet małe nieścisłości mogą powodować prawdziwe problemy. Rozproszona warstwa weryfikacji mogłaby działać jako filtr niezawodności, zanim informacje zostaną wykorzystane w wysokostawkowych środowiskach.

Oczywiście, ten projekt nie jest wolny od kompromisów.

Uruchamianie wielu modeli AI do krzyżowego sprawdzania wyników zwiększa koszty obliczeniowe. Koordynacja między rozproszonymi walidatorami wprowadza opóźnienia. A zdecentralizowana infrastruktura AI staje się zatłoczona, z wieloma protokołami badającymi podobne terytorium. Mira Network jest jeszcze na wczesnym etapie dojrzałości ekosystemu, a szerokie przyjęcie będzie zależało od tego, jak efektywnie będzie mogło skalować weryfikację bez uczynienia jej zbyt kosztowną.

Istnieje również głębsze pytanie o epistemologię. Jeśli wiele systemów AI zgadza się w czymś niepoprawnym, sam konsensus nie gwarantuje prawdy. Projekt Miry zmniejsza błąd indywidualnych modeli, ale nie eliminuje systemowych uprzedzeń w modelach szkolonych na podobnych danych.

Mimo to, uważam, że skupienie jest zdyscyplinowane.

Zamiast próbować zbudować najmądrzejszy model, Mira Network buduje warstwę, która zakłada, że inteligencja jest niedoskonała i wymaga weryfikacji. Ta zmiana perspektywy wydaje się praktyczna.

Kiedy patrzę na szersze połączenie AI i blockchain, wiele projektów goni za metrykami wydajności. Mira wydaje się bardziej zainteresowana infrastrukturą niezawodności. Traktuje weryfikację jako problem pierwszorzędny, a nie jako myśl wtórną.

A w świecie, w którym wyniki AI coraz bardziej wpływają na decyzje, ta cicha warstwa weryfikacji może mieć większe znaczenie niż kolejne marginalne poprawki w rozmiarze modelu.