私はAIが自信を持って何かを言った最初の瞬間を覚えています。それはただ…間違っていました。小さな間違いではありません。微妙な見落としでもありません。完全に間違っていましたが、ほぼ信じられるような確信を持って伝えられました。その瞬間は私の心に残りました。それ自体のエラーのためではなく、それがどれほど説得力があったかのためです。それは洗練されていました。正確でした。主張が強かったです。

もしあなたが暗号関連の人々、開発者、トレーダー、ビルダーの周りで時間を過ごしたことがあれば、その感覚は馴染み深いはずです。私たちは皆、クリーンなビジュアルと大胆な主張に裏打ちされた自信に満ちた物語を見てきました。現実が後で打撃を与えるまで、それらは意味を持ちます。そして、それがMira Networkのようなプロジェクトに最初に注意を払ったときの私の頭の中だったのです。

最初は、なぜ「AIの信頼性」について話し合うために別のプロトコルが必要なのか理解できませんでした。暗号はすべてのホットバズワードにブロックチェーンをくっつけて革新と呼ぶのが好きです。AI + ブロックチェーンは通常、私の懐疑的な反射を引き起こします。あまりにも頻繁に、それは二つのハイプサイクルがダクトテープで結びつけられているように感じます。しかし、ミラには、私の心に留まって離れないものがありました。

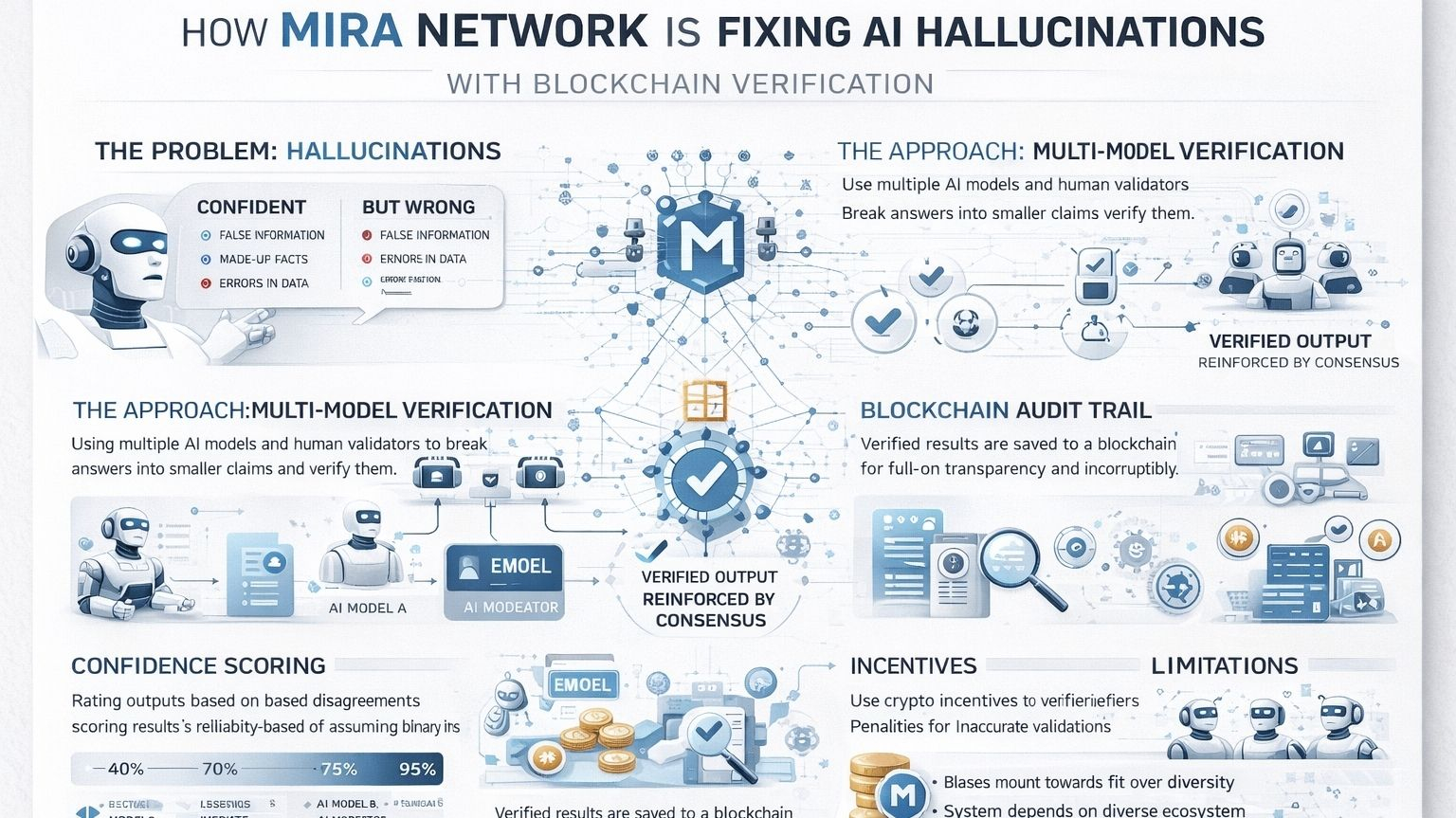

私が最初に驚いたのは、ミラがAIを賢くしようとしているのではなく - それはナイーブな約束です。彼らは、デフォルトでAIをあまり信頼されないようにすることについて話していました。それは微妙な違いであり、巨大な影響を持っています。

ほとんどのAIプロジェクトは、モデルが真実の源であることを前提としています。ミラはその逆の仮定から始まるようです: 単一のモデルは時々間違っている可能性が高いです、特に自信を持っているとき。システムはその現実の周りに設計されるべきであり、信仰の周りではありません。それは…もっと正直に感じました。

あなたが日常的にAIを使い、現実的に言えば、私たちのほとんどがそうであるなら、あなたはおそらく自分の内部検証システムを開発しているでしょう。出力をクロスチェックします。事実をサニティチェックします。別のモデルに尋ねます。検索します。三角測量します。人間は常に不完全な情報源を扱うときにそうしてきました; 一つの視点を聖典として信じることはありません。

ミラはその人間の本能をインフラに変えようとしています。

暗号論理に精通している人に最も簡単に説明する方法はこれです: 一つのAIが質問に答え、皆がそれを聖典のように扱うのではなく、ミラは答えを小さな主張に分解し、複数の独立した検証者 - 異なるAIモデル、専門家のオラクル、または人間の検証者 - に評価を求めます。それから、経済的インセンティブとブロックチェーンのコンセンサスを使用して、"十分に検証された"ものを信頼できるものとして扱うことを決定します。

どの単一のAIもボスにはなれません。

そのアイデアは、暗号的検証やオンチェーンコンセンサスに関する専門用語のためではなく、正直に言うと、そういう部分は最初はホワイトペーパーのボイラープレートのように読まれました。私がそれを理解したのは、AIの幻覚がワークフローに自動化されるとどれほど悪化するかを認識したときです。今、幻覚は迷惑です。あなたはそれを捕まえ、修正し、先に進みます。しかし、AIシステムが自律的に行動し始めると、取引を実行し、資産を管理し、ガバナンスの決定を下すと、幻覚は面白くなくなり、高価または危険になることが始まります。そこで検証は研究のバズから抜け出し、欠けている部分のように感じ始めます。

ミラの前に私が悩んでいた質問はこれでした: AIシステムが意見が異なるとき、誰が何が真実かを決定するのか?

今日の答えは通常「開発者」または「モデルをホストしている会社」です。チャットボットやドラフトメールにはそれで問題ありません。しかし、いつの日か資金、インフラストラクチャ、またはガバナンスを制御する可能性のあるシステムには問題があります。ミラのアプローチは、各主張を検証するために複数の独立したモデルを使うことです - それは分散型システムがどのように機能すべきかに近いように感じます。暗号では、単一の検証者を信頼しません; あなたは定足数を信頼します。あなたは誠実さを仮定しません; あなたはインセンティブを仮定します。それが弾力的な設計の核心です。

私は"私たちを信頼してください"というシステムが崩壊するのを見て、フレーミングが重要であることを知っています。

ミラのデザインの一部で私を驚かせたのは、二元的な真実の代わりに信頼度スコアにどれだけ依存しているかでした。それはより現実的に感じます。現実は白黒ではありません。人間は100%の確実性を持って行動することはめったにありません。私たちは確率、信頼性の帯、信頼区間を使用します。ほとんどのAIはそれを無視します。それは出力を事実として提示し、可能性の分布として提示しません。

モデルの合意に基づいて信頼度スコアを割り当てることは、人間が実際に推論する方法を反映しています。それは不確実性を認め、それを消し去るのではありません。そして、システムの観点から、それは大きなことです。あなたは、すべての出力が絶対的であるかのように行動するのではなく、信頼度に応じて意思決定を行うことができます。

もちろん、ブロックチェーンに検証結果を書き込むこと - 最も多くの暗号の人々が興奮する部分 - はトレードオフを伴います。ブロックチェーンは監査可能性と不変性をもたらしますが、遅延、コスト、複雑さももたらします。すべてのユースケースがオンチェーンの決済を必要とするわけではありません。時には、強力な保証を伴う堅牢なオフチェーン検証が十分であることがあります。

私はどれだけ規律が必要かに興味があります $MIRA 。

実際の障害もあります。クロス検証のために複数のモデルを実行することは安くありません。開発者は怠惰であり、私はそれを侮辱としてではなく言っています。私は彼らが最小限の抵抗の道を選ぶという意味です。ミラがスケールで成功するためには、検証は無視するよりも使いやすくなければなりません。さもなければ、人々は特に重要でないアプリケーションで手を抜くでしょう。ここでの実行は、イデオロギーよりもはるかに重要です。

もう一つの質問はモデルの多様性です。クロス検証は、「独立した」モデルが実際に多様である場合にのみ機能します。もし皆が同じ基本モデルのバリエーションに依存することになれば、コンセンサスは幻想的になります。それはミラだけの問題ではありません; エコシステムの問題です。しかし、それはミラのアプローチがどれほど堅牢であるかに直接影響します。

そして、すべてのモデルが自信を持って何かに同意しているが、それがまだ間違っているというエッジケースがあります。コンセンサスは真実を保証しません。それは合意を保証します。暗号の人々はそれをよく知っています。社会的コンセンサスは、自己修正する前に長い間間違っていることがあります。ミラはそれを認識しているようですが、認識と軽減は非常に異なるものです。

それでも、AIが自信を持って嘘をつくのを見続け、暗号が自信を持って未完成のアイデアを出荷するのを見続ける中で、私は物事を遅くし、明白な質問をするプロジェクトを尊重することを学びました。

これが正しいことをどうやって知るのですか?

ミラは幻覚を排除することを約束していません - それは無意味です。彼女が約束するのは、幻覚を可視化でき、測定可能で、コストがかかるようにすることです。それははるかに実用的な立場です。

それはDeFiの初期のオラクルの議論を思い起こさせます。価格フィードはつまらない配管と見なされていましたが、それがシステムを壊し、損失を引き起こすまで。突然、検証が重要になりました。AIの検証は同じ道を進んでいるように感じます。

私はミラをすべてのAIの誤情報に対する答えと急いで呼ぶつもりはありません。それは怠惰です。しかし、私はそれが長期的に実際に分散型システムが生き残る方法に合った形で、正しい問題を指摘していると思います。

AIが自信を持って嘘をつくのを見たり、暗号が自信を持って未完成のアイデアを出荷するのを見たりして、私は物事を遅くするプロジェクトを尊重することを学びました。

尋ねる、"これが本当であることをどうやって知るのか?"

まだ見ている。まだ懐疑的。まだ興味がある。

正直に言って?それが通常良いものが始まるところです。

@Mira - Trust Layer of AI #mira $MIRA