Non mi aspettavo che la parte più reale del whitepaper ROBO si sentisse stranamente vicina alla vita d'ufficio 😂

Sono tornata a leggere il whitepaper e questa volta continuavo a pensare a qualcosa di divertente. Sotto tutto il linguaggio della robotica e il design dei protocolli, questa cosa quasi si legge come le HR per le macchine. Sto scherzando 😅 Ascoltami. Non il tipo noioso da corporate. Intendo la struttura reale di cui ogni sistema di lavoro ha bisogno una volta che le prestazioni iniziano a contare. Chi ha fatto il lavoro? Il lavoro era abbastanza buono? È stato svolto in modo coerente? Qualcuno può contestarlo? Cosa succede se il risultato è scarso? Chi viene premiato per un lavoro ben fatto e chi è ritenuto responsabile se le cose vanno male??

All'inizio, sembrava un concetto abbastanza basilare. Ma più ci pensavo, più sentivo che questo potrebbe essere uno dei punti più intelligenti dell'intera idea di ROBO.

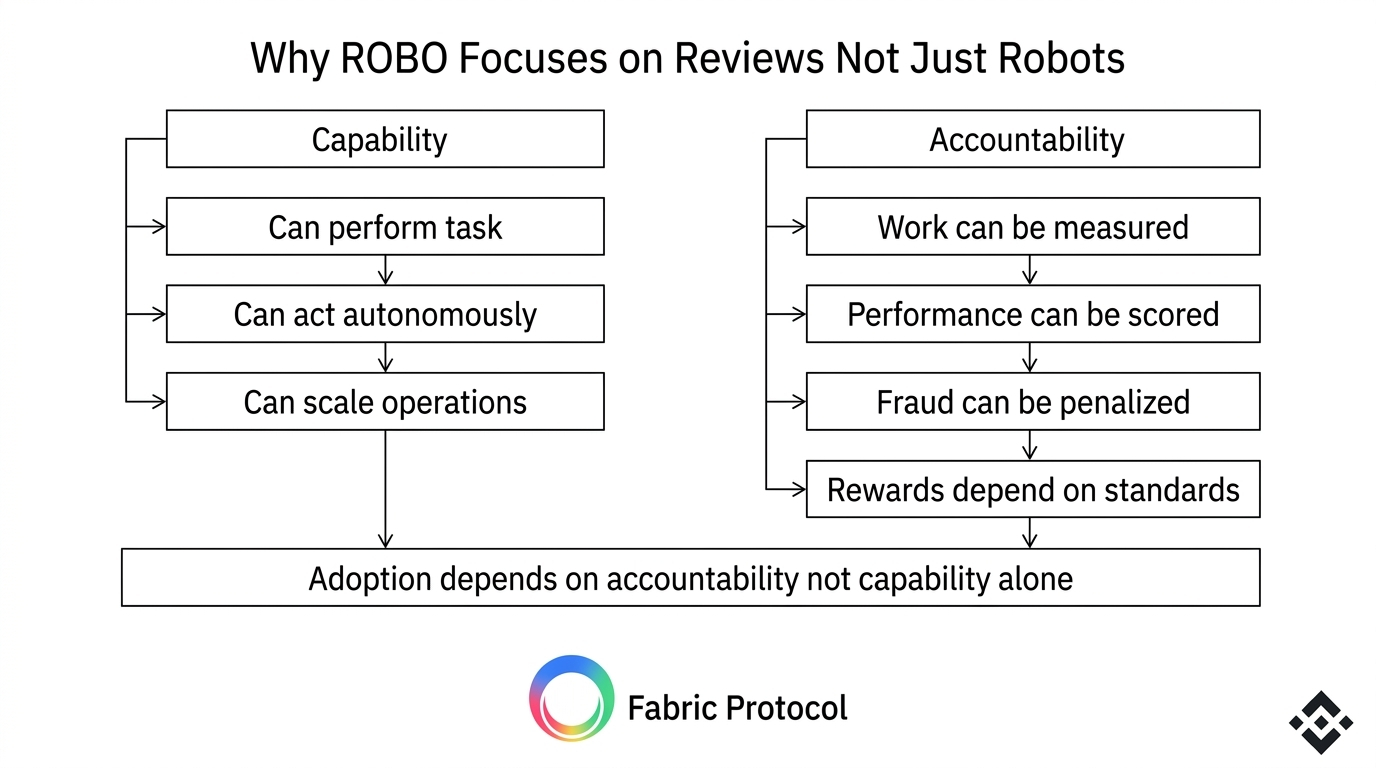

La maggior parte delle persone parla ancora di AI e robotica come se l'unica cosa che contasse fosse la capacità. Ma diciamolo chiaramente. Non è tutto ciò che conta. Ciò che conta realmente è: il sistema può pensare meglio? Può muoversi meglio? Può automatizzare più compiti? Certo, questo è importante. Ma nella vita reale, nessuno paga solo per la capacità. Le persone pagano per prestazioni affidabili. Se una macchina deve svolgere un lavoro utile in magazzini, servizi logistici o infrastrutture, la vera domanda diventa brutalmente pratica. Come sai se il lavoro è stato effettivamente svolto bene??🤐👀

È qui che Fabric ha iniziato a avere senso per me.🥳

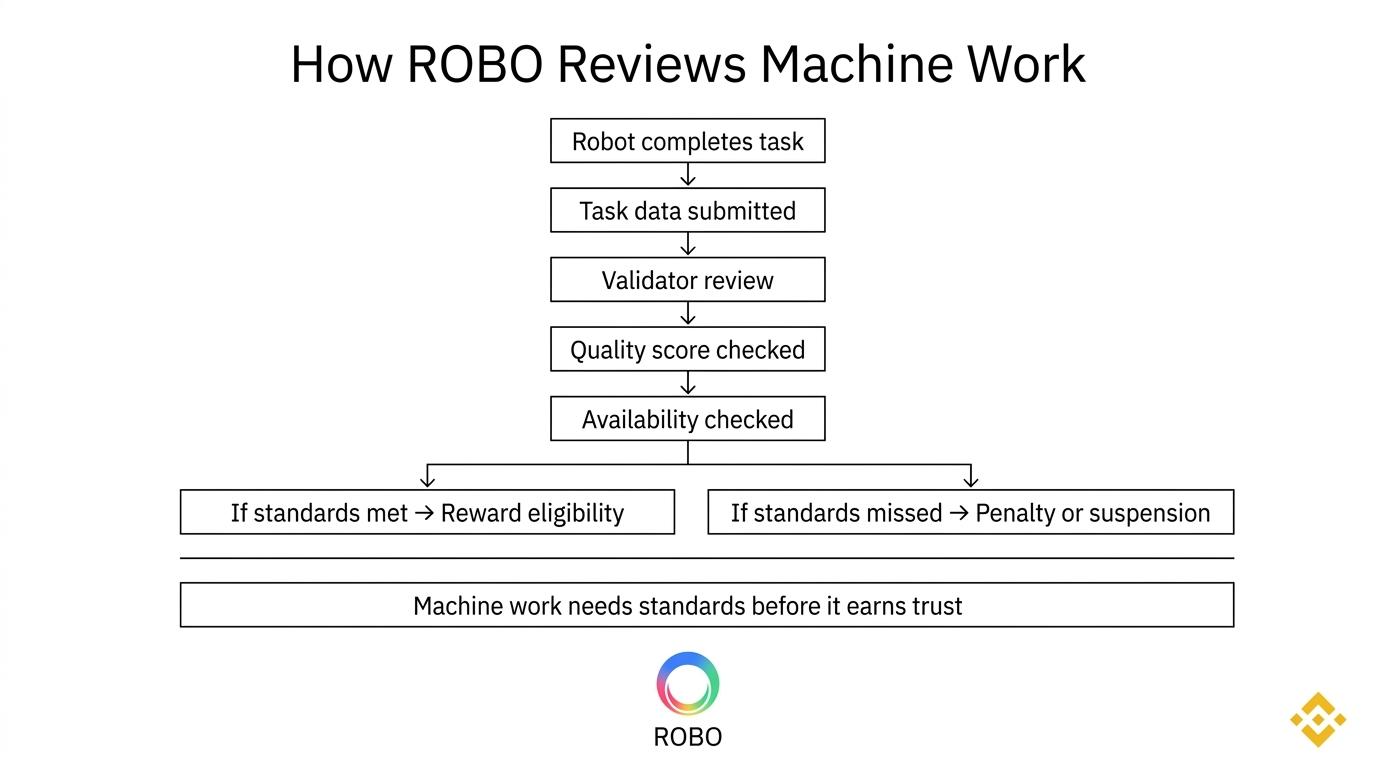

Il whitepaper non sta solo costruendo una storia attorno alla partecipazione dei robot. Sta cercando di costruire uno strato di responsabilità attorno al lavoro robotico. Ciò significa che il lavoro delle macchine non è trattato come magia. È trattato come qualcosa che deve essere misurato, valutato, messo in discussione e applicato. Onestamente, sono un po' sorpreso che più persone non si stiano concentrando su questo perché sembra molto più concreto rispetto alla solita proposta sul futuro dei robot.

E c'è già un contesto reale per cui questo è importante. Secondo la Federazione Internazionale di Robotica, ora ci sono più di 4 milioni di robot industriali operanti in tutto il mondo. Quel numero continua a crescere mentre l'automazione si approfondisce nella produzione e nella logistica. Quindi questa non è più una questione di fantascienza lontana. Le macchine sono già parte dei sistemi di produzione. Il problema è che la maggior parte di esse non vive ancora all'interno di framework economici aperti che possano valutare il loro lavoro come viene valutato il lavoro umano. Quel problema è esattamente dove ROBO interviene per colmare il divario.

Il whitepaper ha smesso di sembrare una proposta di token per me e ha iniziato a sembrare un sistema di valutazione delle prestazioni per le macchine in fase di bozza.

Quella frase continuava a rimbalzare nella mia testa.

La ragione è semplice. Fabric non dice solo che i robot possono svolgere compiti e essere pagati. Aggiunge standard. Stabilisce requisiti operativi. Utilizza obbligazioni di lavoro. Introduce validatori. Definisce punteggi di contributo. Crea penalità per frodi e inaffidabilità. Il protocollo sta cercando di rispondere alle domande fastidiose ma necessarie che ogni sistema di lavoro reale alla fine affronta.

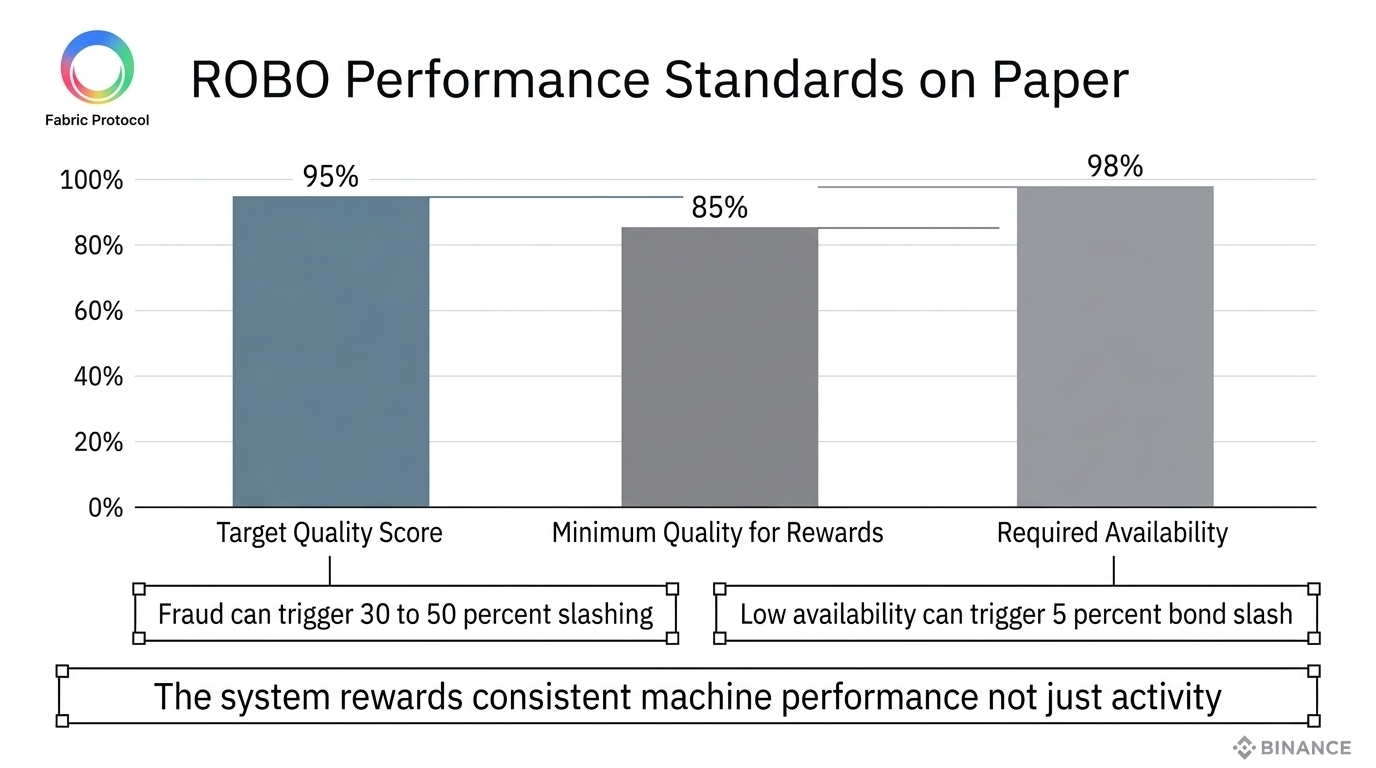

I dettagli qui sono davvero importanti. Il whitepaper utilizza un punteggio di qualità target di 0.95 nel suo design di emissione adattivo e limita gli aggiustamenti al 5 percento per epoca come una sorta di interruttore di emergenza. Stabilisce anche un'aspettativa di disponibilità rigida del 98 percento su un'epoca di 30 giorni e un piano di qualità dell'85 percento per l'idoneità al premio. Se viene rilevata una frode provata, il sistema può ridurre dal 30 al 50 percento della quota di compiti designata. Non è una tokenomics decorativa. È un framework che dice che le prestazioni hanno conseguenze.

E sì, so quanto possa sembrare divertente. Potremmo davvero dirigerci verso un futuro in cui i robot vengono valutati prima di alcuni manager. 😭 Ma scherzi a parte, questa parte del documento ha reso l'intero progetto più serio per me. Non più sicuro. Non garantito. Solo più serio.

Perché nella vita reale ogni mercato del lavoro si basa su più che solo abilità. Si basa sulla verifica. Una persona può avere talento e perdere fiducia se i risultati non sono coerenti. La stessa logica si applica alle macchine. Un robot può sembrare impressionante in una demo e risultare comunque economicamente inutile se non può fornire prestazioni stabili in condizioni disordinate. È qui che Fabric sta cercando di inserirsi. Non nel momento dell'invenzione. Ma nel momento della responsabilità.🤯

Qui è anche dove il progetto tocca qualcosa di più grande della robotica. Inizia a sembrare un problema di design del mercato. Se le economie delle macchine future esistono, allora avranno bisogno di standard per ciò che conta come buon lavoro. Avranno bisogno di sistemi per le controversie. Avranno bisogno di modi per separare il reale contributo dall'attività fittizia. Avranno bisogno di incentivi che premiano la qualità, non solo la partecipazione. Il whitepaper comprende questo meglio di molti progetti di token AI.

Quello che mi piace qui è il rifiuto di premiare la passività. Il modello di prova di contributo di Fabric è costruito attorno al lavoro effettivo. Completamento dei compiti. Dati. Calcolo. Validazione. Sviluppo delle abilità. Il documento si sforza di dire che gli stessi detentori di token possono finire con risultati diversi perché i premi sono legati al contributo misurabile, non solo alla proprietà del token. Questa è un'idea più sana rispetto ai design pigri di hold and earn che il crypto ama riciclare.

Tuttavia, non sono qui a essere ottimista senza riserve. L'intera questione dipende dal fatto che il lavoro delle macchine possa effettivamente essere misurato bene in ambienti reali. Questa è la parte difficile. Scrivere soglie in un whitepaper è facile. Costruire standard giusti e resistenti alla manipolazione per le prestazioni nel mondo fisico è difficile. Davvero difficile. Un robot può completare un compito male. Un validatore può perdere contesto. Un utente può riportare erroneamente la qualità. Gli operatori possono ottimizzare per la metrica anziché per il risultato reale. Abbiamo visto questo accadere nei sistemi umani da sempre. Certo, può succedere anche nei sistemi delle macchine.💻

Quel rischio è importante perché una volta che la misurazione diventa rumorosa, l'intera struttura diventa instabile. I premi diventano meno significativi. Le riduzioni diventano meno eque. I punteggi di contributo diventano più facili da manipolare. A quel punto, la rete smette di comportarsi come un sistema di responsabilità e inizia a comportarsi come una burocrazia costruita su segnali imperfetti. Questo è probabilmente il più grande rischio di esecuzione dell'intero modello ROBO, secondo me.🤖

Allo stesso tempo, rispetto il fatto che il documento non evita l'argomento. Non agisce come se la fiducia nella robotica possa essere risolta con buone vibrazioni. Cerca di creare incentivi e penalità che rendano il comportamento scorretto costoso. Questo da solo lo mette già avanti a molti progetti che usano il linguaggio dell'AI senza toccare le questioni economiche più difficili sottostanti.

Penso anche che questo aspetto sia importante per il futuro. Se la robotica continua ad espandersi, i veri vincitori potrebbero non essere solo i team che costruiscono macchine capaci. Potrebbero essere quelli che costruiscono sistemi per valutare le prestazioni delle macchine in un modo che aziende, regolatori e utenti possano effettivamente fidarsi. Suona meno affascinante rispetto alle demo dei robot. Ma i mercati di solito premiano l'affidabilità molto prima di premiare la narrativa.

Quindi sì, sto ridendo un po' perché questa idea è finita per sembrare stranamente familiare. La parte più interessante del whitepaper di ROBO potrebbe non essere affatto il futuro dei robot. Potrebbe essere il tentativo silenzioso di costruire le regole per chi ottiene una buona valutazione e chi viene messo in discussione.

Robot intelligenti attireranno attenzione. I robot che continuano a superare le valutazioni potrebbero essere quelli che vengono effettivamente adottati. Proprio come noi, i creatori che continuano a guadagnare buoni punti stanno effettivamente ricevendo premi nelle campagne di creatorpad. 😁🤪😂

@Fabric Foundation #ROBO $ROBO