Nelle conversazioni sui grandi modelli di intelligenza artificiale ultimamente, un tema continua a emergere: l'affidabilità. Le persone notano che anche i sistemi più avanzati talvolta producono risposte che sembrano sicure ma sono sbagliate, inconsistenti o influenzate da pregiudizi invisibili. Queste “allucinazioni” e output instabili non sono solo stranezze. Riflettono sfide più profonde su come l'IA viene addestrata e valutata.

Oggi, la maggior parte dei servizi di intelligenza artificiale valida la qualità dietro le quinte utilizzando benchmark interni o loop di feedback di esperti controllati da un'unica organizzazione. Quel tipo di controllo centrale può aiutare a migliorare i modelli, ma non offre prove trasparenti che ogni risposta sia affidabile. Gli utenti sono lasciati a decidere a cosa credere basandosi sulla reputazione o sulla forza del marchio. È qui che progetti come Mira Network iniziano a sembrare interessanti.

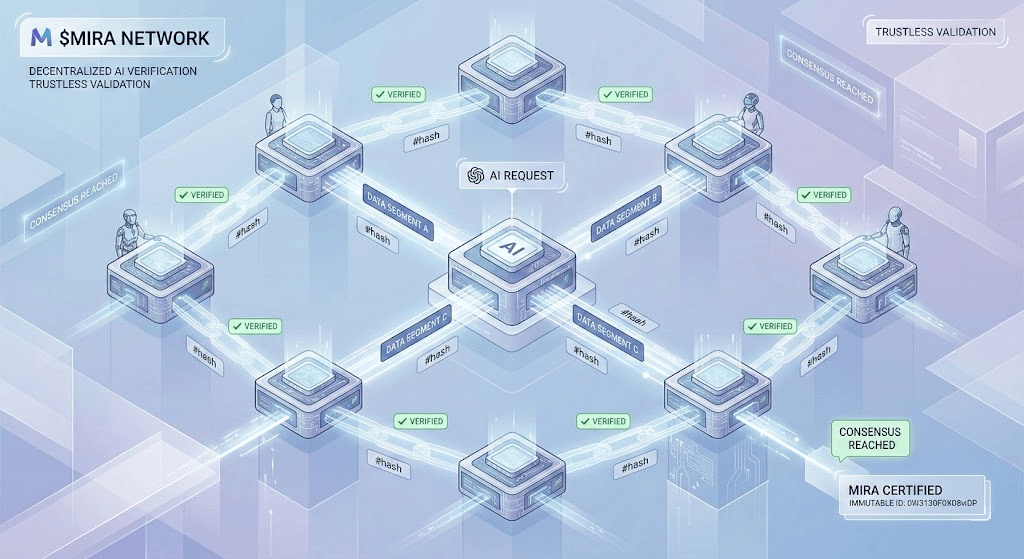

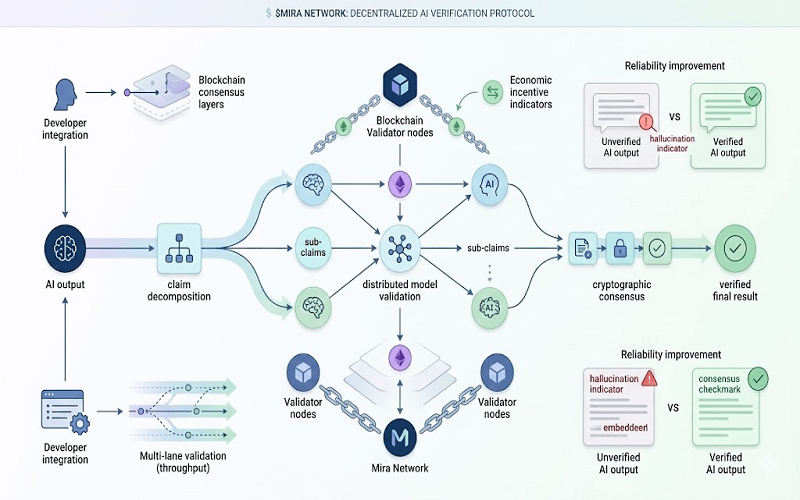

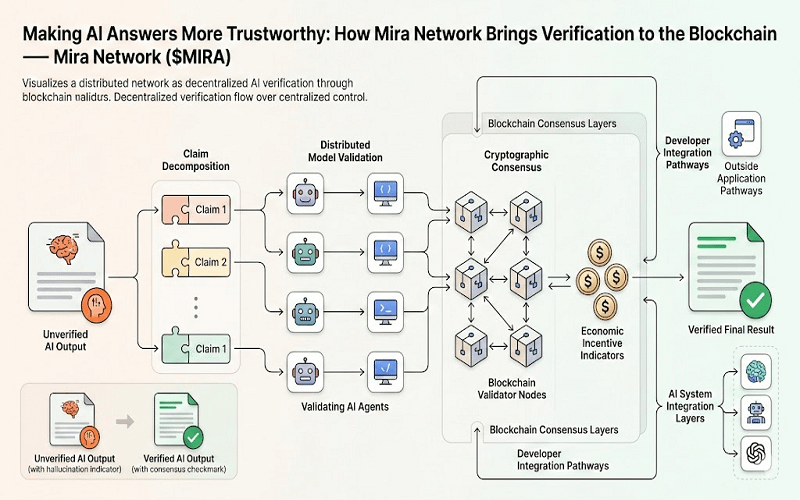

La Mira Network è un protocollo decentralizzato costruito con l'idea che gli output dell'AI dovrebbero essere verificabili da più agenti indipendenti piuttosto che assunti come corretti perché provengono da un sistema ben noto. Il pensiero fondamentale è semplice: suddividere risposte complesse dell'AI in affermazioni più piccole, controllare ciascuna affermazione separatamente e utilizzare un consenso trasparente per determinare se le affermazioni sono valide.

Invece di affidarsi esclusivamente ai metriche interne di un sistema, l'approccio di Mira assemble un network di validatori. Ogni validatore valuta parti di una risposta AI in modo indipendente. Il protocollo utilizza quindi il consenso blockchain per concordare quali affermazioni sono supportate da prove e quali sono discutibili. In sostanza, questo crea uno strato di fiducia aperto che si affianca ai modelli AI esistenti.

Questa idea è importante perché i sistemi di verifica centralizzati hanno delle limitazioni. Quando un'autorità controlla i contenuti, gli utenti devono fidarsi dei metodi e degli incentivi di quell'autorità. Un sistema decentralizzato, almeno in teoria, diffonde quella fiducia tra molti partecipanti. Le decisioni non sono il risultato di una scatola nera all'interno di un'unica azienda. Provengono da un accordo collettivo tra validatori diversi.

Ciò che rende unica l'architettura di Mira è come affetta e controlla i contenuti. Grandi risposte vengono scomposte in singole asserzioni. Ogni asserzione diventa una piccola unità che agenti indipendenti possono valutare più rapidamente e in modo più coerente. Pensa a questo come a suddividere un lungo articolo di ricerca in affermazioni di dimensioni ridotte e chiedere a un panel di esperti di dare un sì o un no su ciascuna.

Questo approccio di verifica distribuita è registrato su una blockchain. Le prove crittografiche di ogni passaggio di validazione sono memorizzate in un modo che chiunque può auditare in seguito. Ciò significa che non ottieni solo un verdetto finale. Ottieni un registro di chi ha contribuito, come hanno valutato ogni affermazione e quali prove hanno sostenuto la loro conclusione. In un mondo in cui la fiducia è spesso assunta piuttosto che mostrata, questo registro può essere significativo.

Tecnicamente, non è banale. Coordinare molti validatori e raggiungere un consenso su una rete decentralizzata richiede un design attento. È qui che gioca un ruolo l'aspetto blockchain. Fornisce un registro immutabile e un meccanismo decentralizzato per aggregare voti e valutazioni. Il livello crittografico garantisce che nessuno possa facilmente manomettere la storia di validazione senza che tutti se ne accorgano.

Una delle motivazioni dietro questo design è ridurre la dipendenza dai controlli di qualità AI centralizzati. I grandi fornitori di AI possono e creano sistemi di valutazione interni, ma questi sistemi sono spesso opachi. Non vedi come è stata controllata una risposta o chi l'ha approvata. Possono utilizzare valutatori umani, benchmark automatizzati o una combinazione. Ma il processo è controllato internamente. Il modello di Mira cerca di cambiare questa dinamica aprendo la verifica a molti attori e rendendo il loro lavoro visibile.

Inevitabilmente, le persone vogliono sapere come questo tipo di controllo decentralizzato aiuti nella pratica. Ci sono diversi potenziali vantaggi che sembrano basati su fondamenta solide piuttosto che su un'esagerazione.

In primo luogo, la verifica distribuita può migliorare la fiducia. Se più validatori indipendenti raggiungono la stessa conclusione su un'affermazione, un utente può sentirsi più sicuro che non sia un caso isolato o il risultato di una singola prospettiva. Questo non garantisce la perfezione, ma distribuisce la responsabilità per l'accuratezza.

In secondo luogo, un registro trasparente delle validazioni significa che i ricercatori e gli sviluppatori possono studiare con quale frequenza le affermazioni si dimostrano valide o falliscono. Nel tempo, quei dati potrebbero aiutare a identificare problemi sistematici in certi tipi di output dell'AI, che si tratti di argomenti specifici, modelli di formulazione o comportamenti del modello.

In terzo luogo, c'è un livello di incentivo. I partecipanti che contribuiscono a un lavoro di validazione prezioso potrebbero essere ricompensati in token come $MIRA . Questo fornisce un motivo economico semplice per le persone di impegnarsi e condividere le proprie valutazioni. Gli incentivi non risolvono tutti i problemi, ma aiutano ad allineare l'impegno con i risultati nei sistemi decentralizzati.

A differenza dei servizi di valutazione centralizzati, uno strato decentralizzato non richiede agli utenti di fidarsi di un'unica azienda. Invece, gli utenti si fidano di processi trasparenti e della partecipazione della comunità. Questo si allinea di più con l'etica dei sistemi aperti e dà alle persone più spazio per mettere in discussione o verificare i risultati in modo indipendente.

È utile mettere tutto questo in contesto. La verifica decentralizzata non è una soluzione magica che elimina ogni problema di affidabilità. Aggiunge un altro livello di scrutinio, sì, ma non sostituisce un buon design del modello o dati di addestramento di qualità. Completa queste cose. Se un modello genera output difettosi, i controlli decentralizzati possono evidenziare e quantificare quel difetto. Ma non possono rendere il modello originale intrinsecamente migliore da soli.

Ci sono limitazioni realistiche a questo approccio. Per prima cosa, scomporre e validare ogni affermazione dell'AI su larga scala consuma risorse computazionali. La verifica distribuita significa che molti agenti devono eseguire controlli su parti di una risposta. Questo può richiedere tempo ed energia, soprattutto man mano che le risposte diventano più lunghe o complesse.

Il coordinamento è un'altra sfida. Ottenere che più validatori indipendenti valutino la stessa affermazione senza conflitti e raggiungere poi un consenso non è semplice. Il protocollo deve gestire le controversie, segnali contrastanti e validatori che potrebbero agire in modo errato, sia per errore che deliberatamente. Progettare meccanismi robusti per gestire queste situazioni richiede ingegneria attenta e governance della comunità.

La competizione tra progetti di infrastruttura AI decentralizzati complica anche il quadro. La Mira Network non è sola nell'esplorare come aggiungere trasparenza e responsabilità agli output dell'AI. Un ecosistema affollato significa che le idee evolvono rapidamente, il che è positivo, ma significa anche che nessun singolo approccio è garantito per diventare dominante. Gli utenti e gli sviluppatori probabilmente sperimenteranno con diversi strati di verifica, metodi di consenso e strutture di incentivo.

Vale anche la pena notare che questo ecosistema è ancora agli inizi. Non vedrai ancora un mondo in cui ogni risposta AI che ricevi è pre‑verificata da una rete decentralizzata prima di raggiungerti. L'adozione richiede tempo e l'integrazione con i fornitori di AI mainstream non è automatica. Gli sviluppatori devono costruire ponti tra modelli di linguaggio di grandi dimensioni e strati di verifica come quelli proposti da #MiraNetwork . Questo richiede sia lavoro tecnico che consenso della comunità.

Tenendo presente questo, è utile pensare alla verifica decentralizzata non come a un sostituto del controllo qualità attuale, ma come a uno strumento aggiuntivo. È un modo per dare agli utenti maggiore visibilità su perché una risposta è considerata affidabile o meno. È un modo per diffondere la fiducia tra molti contributori invece di concentrarla in un unico luogo.

Un altro beneficio pratico risiede nella ricerca e nella trasparenza. Poiché i passaggi di verifica sono registrati e auditabili, le persone possono studiare i modelli nel tempo. Possono porsi domande come: quali affermazioni tendono a essere segnalate più spesso? Certi argomenti portano a più disaccordi tra i validatori? Modelli come questi potrebbero informare futuri miglioramenti sia nella generazione che nella valutazione dell'AI.

Considera anche che un registro di verifica trasparente potrebbe aiutare in contesti educativi o ambienti professionali dove le prove contano. Se stai prendendo decisioni basate sull'output dell'AI in un articolo di ricerca o in un'analisi aziendale, avere un percorso di validazione auditabile potrebbe essere rassicurante.

Allo stesso tempo, è giusto rimanere con i piedi per terra riguardo alle aspettative. La validazione decentralizzata non sarà perfetta. Non eliminerà ogni errore o pregiudizio. Non sostituirà il ragionamento umano ponderato. Ma può creare un ambiente più aperto in cui la responsabilità per la correttezza è meno un processo privato e più un processo pubblico.

Progetti come @Mira - Trust Layer of AI sollevano domande che contano per il futuro dell'AI e della blockchain insieme. Ci ricordano che l'affidabilità non è solo una sfida tecnica ma una sfida di fiducia.

Quando pensiamo a come le persone interagiranno con sistemi AI sempre più potenti, aggiungere strati che rendono le uscite più verificabili sembra un passo riflessivo piuttosto che un'affermazione stravagante.

Quel tipo di pensiero attento potrebbe essere esattamente ciò di cui lo spazio ha bisogno mentre matura. #mira