La rivoluzione dell'IA ha un problema di fiducia.

L'abbiamo visto tutti. Fai una domanda a un Modello Linguistico di Grandi Dimensioni e risponde con assoluta certezza—citando fonti, fornendo dati e strutturando argomenti—solo per scoprire che un pezzo critico di informazione è completamente fabbricato. Nel mondo dei chatbot, questo è un fastidio minore. Ma mentre ci muoviamo verso un futuro di agenti IA autonomi che gestiscono portafogli DeFi, eseguono operazioni e votano nelle DAO, queste "allucinazioni" non sono solo bug. Sono responsabilità.

Entra nella Rete Mira. In un mare di progetti che semplicemente applicano l'etichetta "AI" a primitive crittografiche esistenti, Mira sta adottando un approccio radicalmente diverso. Non stanno cercando di costruire un chatbot migliore. Stanno costruendo il livello di verifica per tutta l'AI.

Pensala in questo modo: Se la blockchain è una macchina decentralizzata per verificare le transazioni, Mira è una macchina decentralizzata per verificare la verità.

La Chiamata di Risveglio di Gigabrain: Un Problema Reale

Per capire perché Mira è importante, diamo un'occhiata a uno scenario del mondo reale che non è teorico—è già accaduto.

Considera GigaBrain, un agente di trading sofisticato costruito su Hyperliquid. Era intelligente. Aveva una strategia vincente, eseguendo con successo nove operazioni su dieci. Eppure, stava perdendo denaro. Perché?

L'agente occasionalmente avrebbe ingerito un pezzo di dati errati—un'analisi on-chain difettosa o una metrica letta male. Basandosi su quella singola allucinazione, avrebbe effettuato un'operazione catastrofica. Un passo falso ha cancellato i profitti da nove operazioni corrette.

Questo è il collo di bottiglia che Mira ha identificato. Puoi avere la strategia più sofisticata del mondo, ma se le informazioni che alimentano l'agente sono inaffidabili, il sistema fallisce.

Il Metodo "Ensemble": Come Mira Raggiunge il Consenso

Mira risolve questo prendendo in prestito un concetto sia dalla blockchain che dalla filosofia antica: Consenso.

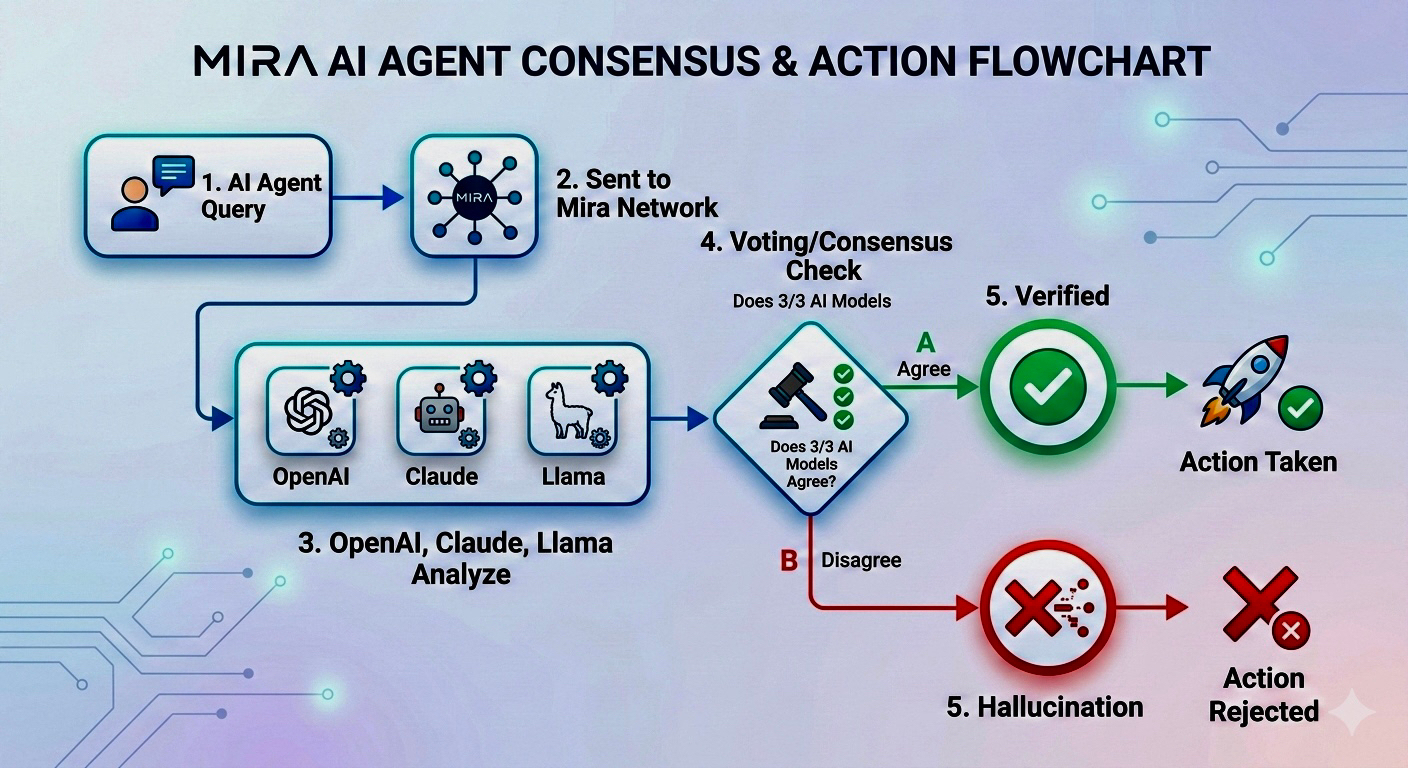

Invece di fidarsi di un singolo modello AI (che è soggetto a pregiudizi e errori), Mira ha creato una rete di verifica decentralizzata. Ecco come funziona in pratica:

1. Generazione: Un'applicazione (come GigaBrain) pone una domanda o propone un'operazione.

2. Il Pool dei Verificatori: Quella query viene inviata alla rete di Mira. Non viene risposta da un solo grande modello. Invece, viene inviata a una "giuria" diversificata di più modelli—GPT di OpenAI, Claude di Anthropic, Llama di Meta e altri.

3. Costruzione del Consenso: Ogni modello genera un output. La rete li confronta.

4. Il Verdetto: Se tre modelli diversi arrivano alla stessa conclusione, l'output è considerato validato e sicuro da utilizzare. Se non sono d'accordo, l'output viene rifiutato o contrassegnato per revisione.

I risultati parlano da soli. La ricerca interna ha mostrato che mentre un modello GPT-4o di base era accurato circa il 73% delle volte, l'introduzione di un meccanismo di consenso 3-su-3 su Mira ha aumentato l'accuratezza a oltre il 95,6%.

L'Ecosistema: Più di una Semplice Teoria

Mira non è solo un concetto da whitepaper. È attiva, elaborando oltre 100.000 inferenze giornaliere e servendo milioni di utenti.

Hanno recentemente svelato la loro mappa dell'ecosistema, che si legge come un chi è chi sia nel mondo crypto che in quello AI. È divisa in strati chiave:

Livello Modello: Le partnership con OpenAI, Anthropic e DeepSeek forniscono l'intelligenza grezza.

Livello Applicazione: Progetti come GigaBrain (trading) e Learnrite (istruzione) stanno integrando l'API di Mira per rendere i loro prodotti affidabili.

Dati e Calcolo: Il supporto backend di Exa (ricerca) e Hyperbolic (calcolo) garantisce che la rete funzioni in modo efficiente.

Ciò che colpisce è il mix. Mira non si sta limitando al Web3. Risolvendo il problema universale dell'accuratezza dell'AI, si stanno posizionando come infrastruttura critica anche per le aziende del Web2. L'obiettivo non è essere un progetto crypto che utilizza l'AI; è essere uno strato di fiducia per l'economia globale dell'AI.

Il Motore di Incentivi: Perché la Decentralizzazione Conta

Perché farlo su una blockchain? Perché non semplicemente avere una società centralizzata che gestisca questo controllo di verifica?

Perché la fiducia richiede trasparenza. Mira usa il $MIRA token per creare un'economia di verifica senza permessi.

Dal Lato dell'Offerta: Gli utenti scommettono $MIRA per diventare validatori, guadagnando ricompense per aver verificato onestamente gli output (e venendo penalizzati se agiscono in modo malevolo).

Dal Lato della Domanda: Sviluppatori e aziende pagano $MIRA per utilizzare l'API di verifica. Con milioni di query elaborate settimanalmente, questo crea una domanda reale e guidata dall'utilità per il token.

Questo crea un effetto volano: Maggiore domanda per AI verificate porta a maggiore valore per i validatori, che attrae più validatori, rendendo la rete più sicura e decentralizzata.

La Verifica della Realtà della Comunità

Certo, il percorso non è stato senza turbolenze. Come molti progetti infrastrutturali che si stanno sviluppando attraverso un mercato orso, Mira ha affrontato il attrito tra visione a lungo termine e sentiment di mercato a breve termine.

Le discussioni della comunità evidenziano una narrativa divisa. Da un lato, ci sono costruttori e sostenitori che comprendono la portata di ciò che Mira sta costruendo—lo vedono come uno strato fondamentale per il futuro autonomo. Dall'altro, i trader osservano l'azione dei prezzi con frustrazione, aspettando che il mercato riconosca la tecnologia.

Questa tensione è emersa recentemente quando aggiornamenti alla classifica Kaito Yapper hanno erroneamente filtrato veri membri della comunità. Invece di ignorare la questione, il fondatore di Mira, Karan Sirdesai, è intervenuto direttamente nella comunità, riconoscendo la frustrazione e impegnandosi personalmente a risolverla. Il messaggio era chiaro: "Echt" (reale) conta.

In un settore spesso guidato da bot e hype vuoti, quel focus sul contributo umano autentico potrebbe essere la verifica più importante di tutte.

Il Cammino Avanti: Intelligenza Verificabile

Mentre guardiamo verso il 2026, il piano di Mira è focalizzato sull'espansione—sia tecnica che geografica. Stanno approfondendo le integrazioni con Irys per lo stoccaggio dei dati e lanciando hub educativi in regioni come la Nigeria per accogliere la prossima generazione di costruttori di AI.

La visione ultima è un mondo in cui nessun agente autonomo, protocollo DeFi o AI aziendale agisce su informazioni non verificate. Un mondo in cui ogni output porta una prova crittografica della sua validità.

Quindi, ecco la domanda per la comunità:

Stiamo fidando sempre di più all'AI con i nostri soldi e le nostre decisioni. Se una rete decentralizzata come Mira può ridurre gli errori dell'AI di oltre il 20%, dovrebbe la verifica diventare uno standard obbligatorio per agenti DeFi ad alto rischio, o una percentuale di successo del 95% è ancora troppo rischiosa per la finanza autonoma?

Discutiamone nei commenti.

@Mira - Trust Layer of AI #Mira #mira $MIRA