Sono le 5:00 del mattino, sono al mio terzo caffè e sto fissando un nodo che sembra perfetto sulla carta ma è stato appena segnalato dal verificatore di Fabric per segnali di replay. C'è qualcosa di stranamente soddisfacente in questo—come finalmente vedere la crepa in un pezzo di marmo lucido. Conferma che non stavi solo sendo cinico; le bandiere rosse erano reali.

Dopo aver vissuto abbastanza di questi cicli, ti rendi conto che la frode nei network di robot non avviene di solito all'interno del robot stesso— è nel layer di prova. Quando i log sono legati ai premi, quei log diventano una merce. E ovunque ci sia una merce, qualcuno cercherà di falsificarla.

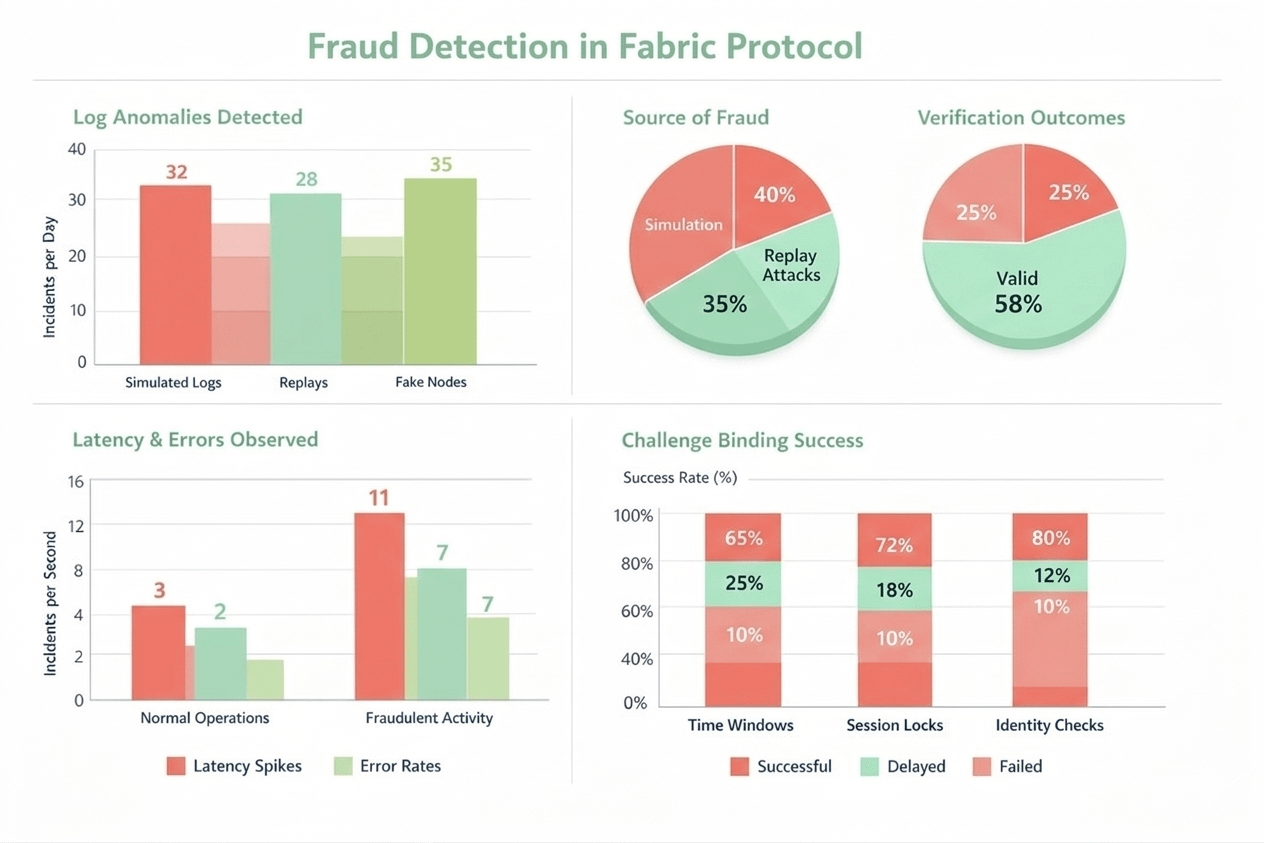

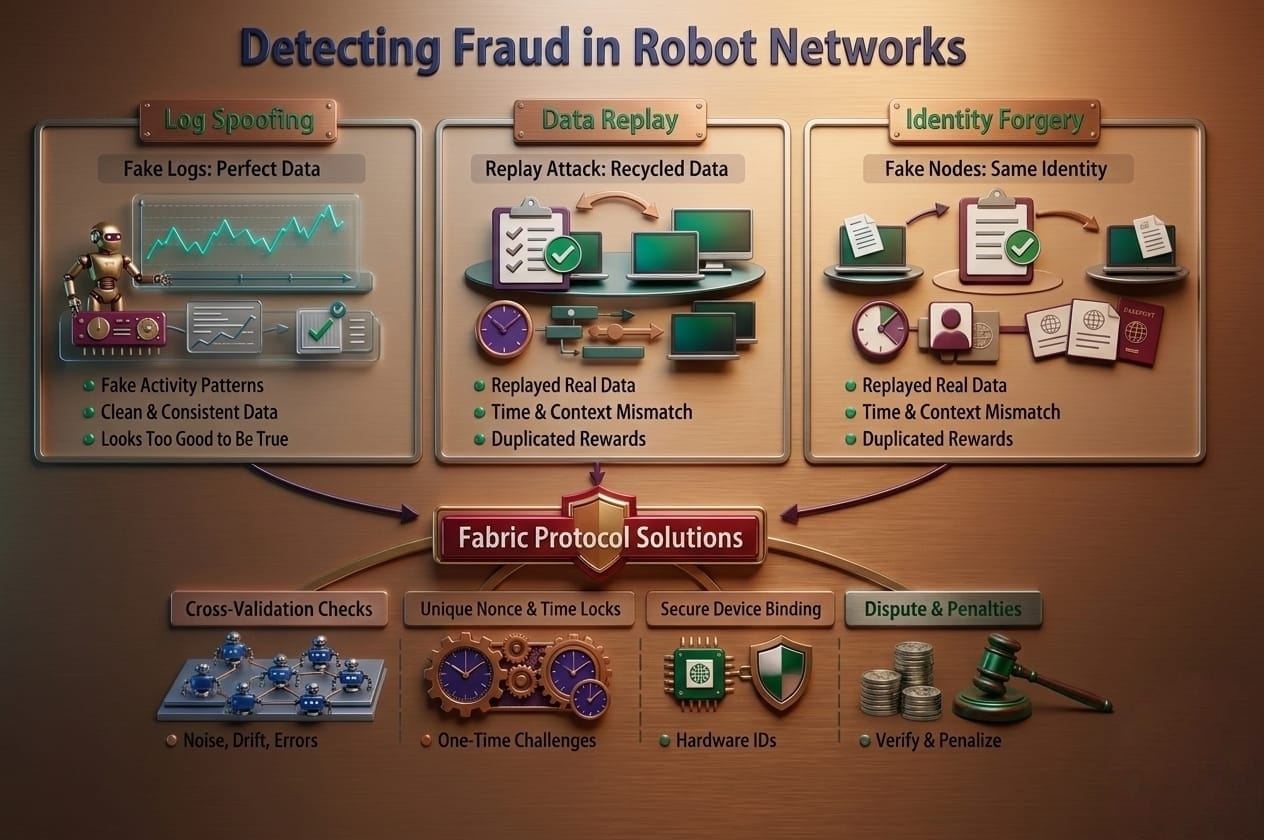

La simulazione dei log è la mossa più antica del libro. I trasgressori scrivono una sequenza che appare esattamente come un umano pensa che un robot dovrebbe agire: cadenza costante, "naturali" errori minori e latenza bellissima.

Ma le operazioni del mondo reale sono disordinate. Hanno perdita di pacchetti, deragliamenti temporali e spazi vuoti strani che non hanno senso su un foglio di calcolo. Penso che Fabric sia sulla strada giusta perché si adatta a quella disordinarietà. Usa controlli incrociati—corrispondendo i log delle attività con le tracce di esecuzione e i vincoli fisici—per garantire che i dati non potessero essere "pre-cucinati" in uno script.

Gli attacchi di replay sono ancora più fastidiosi perché i dati sono tecnicamente "reali." È una traccia valida di ieri, riprodotta oggi sotto un nuovo ID per raddoppiare le ricompense. Se non blocchi i dati a un contesto specifico, è pericoloso.

Fabric gestisce questo costringendo ogni prova a legarsi a una sfida una tantum. Aggiungi una finestra temporale rigorosa e vincoli di sessione, oppure lasci la porta aperta per il replay.

Niente di tutto ciò ha importanza se l'identità del dispositivo è "morbida." Se puoi attivare mille nodi virtuali e fornire loro lo stesso flusso, la rete collassa. Ecco perché l'attestazione a livello hardware a cui Fabric fa riferimento—utilizzando elementi sicuri o contatori monotoni—è così vitale. Devi rendere la clonazione di un'identità più costosa della ricompensa stessa.

La lezione più dolorosa che ho imparato? Non premiare i log "puliti". I veri robot sopravvivono gestendo i fallimenti, non evitandoli. Se un sistema paga per la lisciatura, gli operatori passeranno tutto il loro tempo a lucidare la maschera della frode. Dovremmo premiare il "rumore onesto."

La fiducia non dovrebbe derivare dalle affermazioni di un progetto; deriva dai vincoli che costruiscono. Quando la prova è bloccata nel tempo, nell'identità e negli audit randomizzati, il mercato è finalmente costretto a pagare per il lavoro reale.

La domanda è: quando accadrà la prossima corsa all'oro, avremo la pazienza di rispettare questi vincoli, o inizieremo a credere di nuovo nelle curve "perfette"?

@Fabric Foundation #ROBO $ROBO