@Mira - Trust Layer of AI #Mira $MIRA

Mira Network affronta un problema che molti di noi sentono ma pochi sistemi risolvono bene: l'IA può essere brillante un momento e inaffidabile il successivo. I modelli inventano dettagli, amplificano pregiudizi nascosti o semplicemente sbagliano i fatti — e quando quegli errori influenzano decisioni nel mondo reale, le conseguenze possono essere gravi. Ciò che questo progetto cerca di fare è semplice da descrivere e incredibilmente difficile da eseguire: non trattare una risposta dell'IA come una verità finale. Scomponila nei piccoli pezzi verificabili che puoi effettivamente controllare e lascia che le decisioni seguano solo quando quei pezzi portano prove.

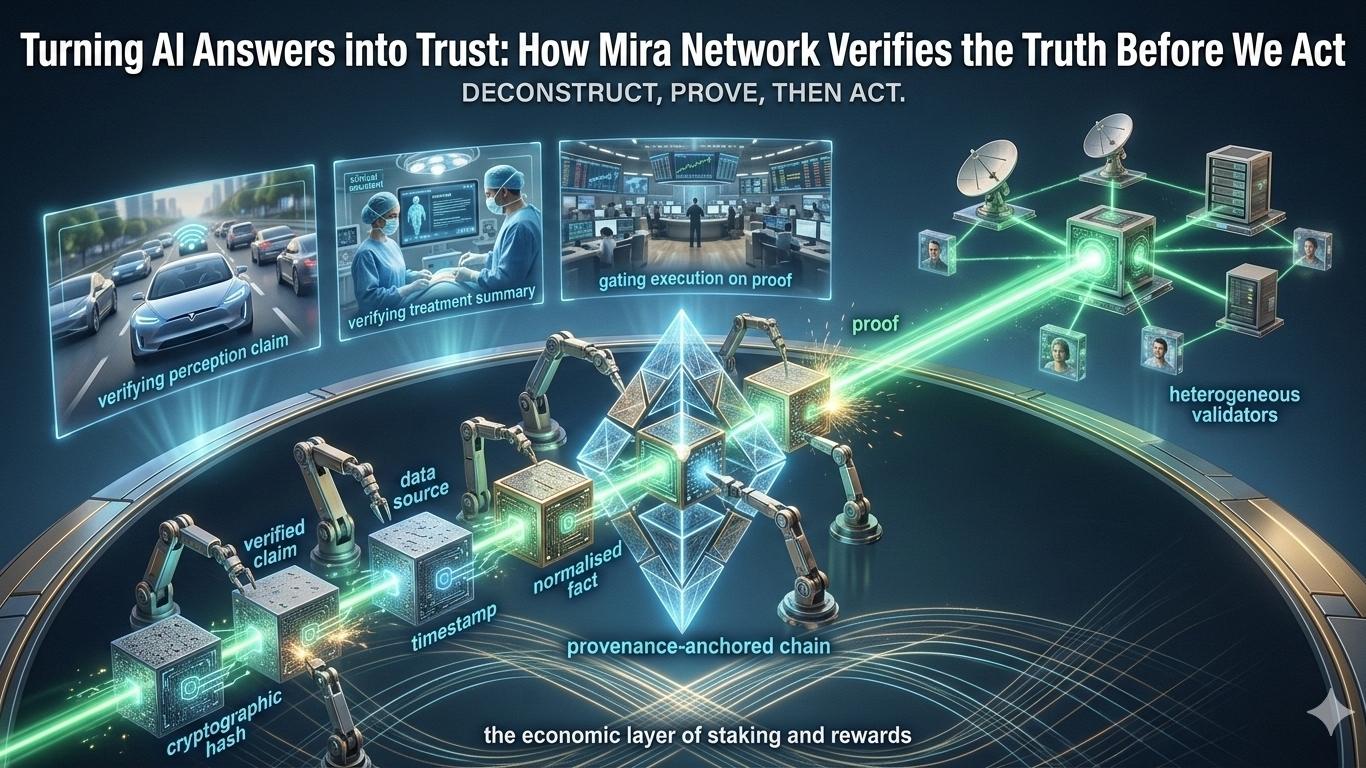

Immagina la risposta di un'IA come una lunga catena di affermazioni. Invece di accettare l'intera catena, il sistema la suddivide in affermazioni di dimensioni ridotte: piccole dichiarazioni che possono essere cercate, verificate e validate da sole. Ogni affermazione è accompagnata da provenienza: da dove proviene la prova, quando è stata acquisita e come è stata normalizzata affinché diversi validatori leggano la stessa cosa. Quella normalizzazione è cruciale. Il linguaggio libero è scivoloso; trasformare un'idea in un fatto canonico rende possibile per molti diversi controllori eseguire lo stesso test e confrontare i risultati.

La verifica è un lavoro retribuito in questo mondo. Quando un'app o un agente ha bisogno di fiducia, pubblica un lavoro di verifica abbinato a una piccola tassa. Validator indipendenti — un gruppo deliberatamente misto di altri modelli, sistemi potenziati da recupero e a volte revisori umani — si occupano di quei lavori. Scommettono token per partecipare, il che dà loro un interesse: controlli onesti guadagnano ricompense, mentre comportamenti dimostrabilmente disonesti o pigri rischiano di perdere la scommessa. Poiché molti validatori agiscono sulla stessa affermazione, il sistema raggiunge un giudizio collettivo piuttosto che fare affidamento su una singola fonte. Se i validatori non sono d'accordo, si attivano strati di risoluzione delle controversie: controlli automatizzati più approfonditi, compiti di recupero più lunghi o giudizio umano per affermazioni particolarmente complesse.

Una volta che un'affermazione supera la verifica, la sua attestazione è ancorata in modo immutabile in modo che i sistemi downstream possano richiedere una prova crittografica prima di agire. Un'auto a guida autonoma, ad esempio, potrebbe rifiutarsi di cambiare corsia a meno che un'affermazione di percezione sulla strada non venga verificata; un assistente clinico potrebbe etichettare un trattamento suggerito con una traccia verificabile che mostra quali fonti di prova e validatori lo hanno supportato. Quell'ancoraggio trasforma gli output dei modelli effimeri in mattoni di costruzione auditabili di cui puoi fidarti — o almeno interrogare — prima di lasciarli fare qualcosa di significativo.

Questa architettura abbraccia deliberatamente la diversità. I validatori sono eterogenei di proposito perché modelli e persone diversi commettono errori diversi. Se un gruppo di modelli simili allucina lo stesso schema, un insieme di validatori diversificato è meno probabile che ripeta lo stesso errore. Lo strato economico — staking, slashing e ricompense — è la colla che allinea gli incentivi, ma introduce anche nuove domande: quanto dovrebbero essere grandi le obbligazioni, quale peso hanno le prestazioni passate e l'esperienza nel dominio, e come evitare che attori facoltosi sfruttino il sistema? La governance deve essere abbastanza agile da regolare quei controlli man mano che la rete cresce.

Ci sono casi d'uso ovvi e potenti. Nel settore sanitario, ad esempio, uno strato di verifica può costringere i riassunti dell'IA e le raccomandazioni diagnostiche a fare riferimento a prove concrete e controlli confermati da esseri umani prima di influenzare le cure. In finanza e DeFi, la logica di trading o di regolamento che dipende da segnali in linguaggio naturale può bloccare l'esecuzione su prove, riducendo il rischio di costosi errori di automazione. I robot e gli agenti autonomi possono ottenere un pipeline di percezione-azione più sicura rifiutando di agire fino a quando le affermazioni critiche sul loro ambiente non sono verificate. Anche le piattaforme di contenuti possono trarne vantaggio: invece di attaccare un'etichetta “può essere imprecisa” a un post, potrebbero allegare una prova che i fatti chiave sono stati controllati, come e da chi.

Nessuna di queste è una soluzione miracolosa. La verifica dipende dalla qualità delle prove: se i validatori citano le stesse fonti compromesse, hai comunque un risultato fragile. C'è anche una tensione tra trasparenza e privacy: i regolatori potrebbero richiedere registri favorevoli agli auditor che rivelano più di quanto alcuni validatori o utenti vogliano divulgare. Costi e velocità sono vincoli pratici; verificare ogni singolo token di testo sarebbe uno spreco, quindi devono emergere politiche sensate su cosa viene controllato e quando. La cosa più importante è che un sistema economico apre la porta a nuovi attacchi: collusione tra validatori, cartelli di staking o cattura della reputazione sono rischi reali che devono essere affrontati con difese stratificate e scelte di parametri accurate.

Ci sono modi interessanti e centrati sull'uomo per spingere ulteriormente l'idea. Pensa a reputazioni specializzate invece di punteggi standardizzati: un validatore può essere altamente affidabile per le affermazioni scientifiche ma non per notizie locali, e i sistemi possono pesare le reputazioni per dominio. Puoi immaginare mercati per la credibilità dei validatori, dove le prestazioni sono tokenizzate e i segnali di prezzo aiutano i consumatori a scegliere il livello di certezza che vogliono acquistare. Per affermazioni sensibili, le prove a conoscenza zero potrebbero consentire ai validatori di dimostrare di aver controllato dati privati senza rivelarli. E per decisioni ad alto rischio, corsie ibride che combinano controlli automatizzati rapidi con finalizzatori umani offrono un percorso pragmatico da seguire.

Nel profondo, questo approccio cambia il modo in cui pensiamo alla fiducia nell'IA. Ci allontana dall'idea che i modelli debbano essere perfetti e ci porta verso una nozione più modesta e pragmatica: lasciare che i modelli facciano ciò che sanno fare meglio, ma richiedere una traccia verificabile prima che il sistema agisca sui loro output. Quel cambiamento riformula l'affidabilità come un problema sociale ed economico tanto quanto tecnico: un mercato per la verità dove incentivi, governance ed esperienze diverse devono confluire. Se queste parti possono essere ingegnerizzate bene, otteniamo non solo automazione più affidabile ma anche un nuovo strato di responsabilità per i modi in cui l'IA influisce sulle decisioni nella società.