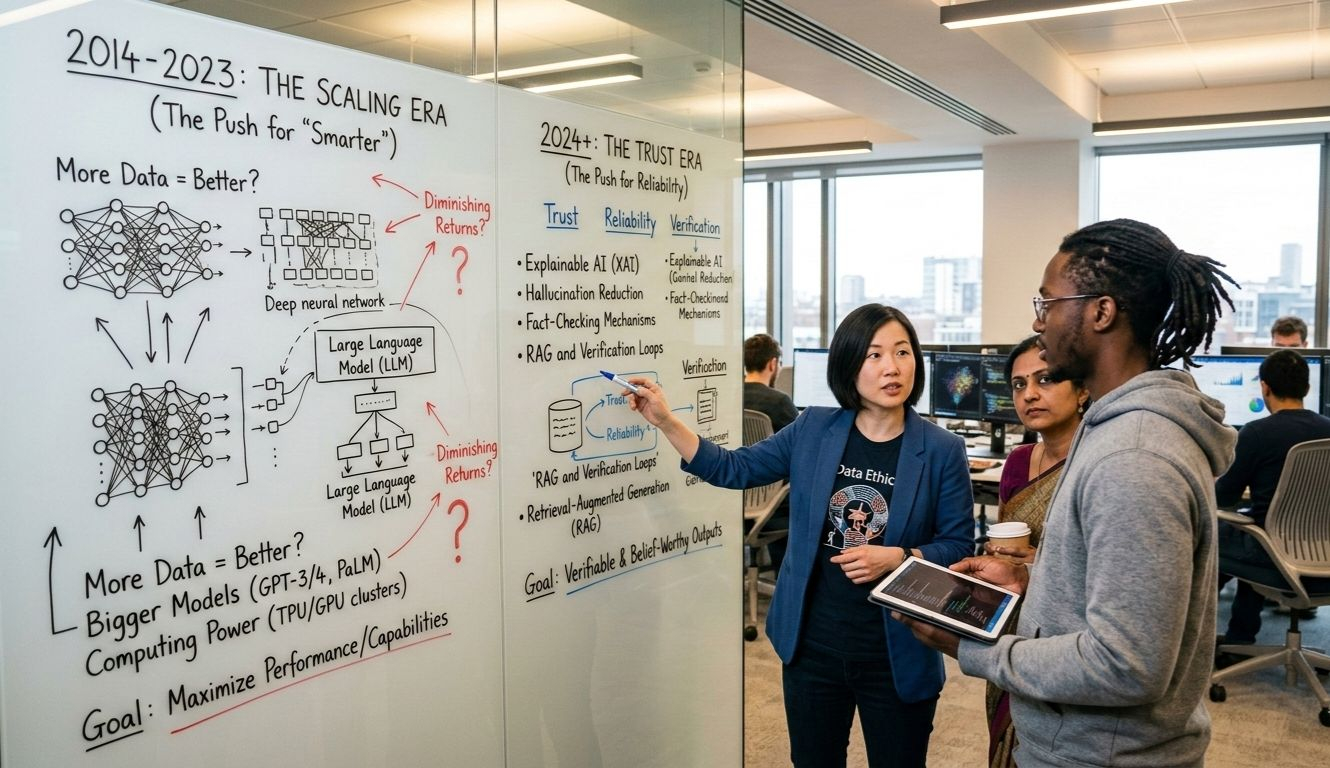

L'intelligenza artificiale ha fatto molta strada solo negli ultimi dieci anni. Siamo passati da semplici chatbot a IA in grado di gestire compiti complicati, cose che pensavamo potessero fare solo le persone. La maggior parte dei grandi salti nell'IA è avvenuta perché i ricercatori hanno continuato a costruire modelli più grandi, fornendo loro più dati e lanciando maggiore potenza di calcolo sul problema. Per un po', tutti presumevano che la prossima grande scoperta sarebbe arrivata dal rendere questi modelli ancora più intelligenti.

Ma ora, le cose stanno cambiando. Molti ricercatori stanno cominciando a pensare che il vero cambiamento non riguardi la creazione di un'IA "più intelligente". Si tratta di costruire sistemi di cui possiamo effettivamente fidarci, IA che sia affidabile e le cui risposte puoi controllare e credere.

L'accuratezza è sempre stata un punto critico per l'IA moderna. Anche i migliori modelli non conoscono realmente i fatti, sono solo molto bravi a indovinare ciò che sembra giusto, basandosi su schemi nei dati. A volte, ciò significa che l'IA fornisce informazioni completamente sbagliate o addirittura inventate. Questo è ciò che le persone chiamano “allucinazione dell'IA”. Forse inventa statistiche, fa riferimento a ricerche che non sono mai esistite o ti dà i numeri sbagliati sulla storia o sul denaro. Se stai solo chiacchierando, quegli errori potrebbero non sembrare un grosso problema. Ma in aree serie come finanza, medicina, diritto o tecnologia a guida autonoma, quegli errori possono diventare pericolosi rapidamente.

Quindi, qual è la soluzione? Le aziende tecnologiche continuano a cercare di risolvere il problema costruendo modelli più grandi e avanzati. La logica è: se il sistema diventa più intelligente, gli errori svaniranno. Certo, le prestazioni sono migliorate. Ma le allucinazioni si verificano ancora. Perché? Perché alla fine della giornata, questi modelli sono costruiti per prevedere il linguaggio, non per controllare i fatti. Semplicemente renderli più grandi non li renderà più affidabili.

Qui entra in gioco una nuova idea: intelligenza verificabile. Invece di avere un modello IA che “sa tutto”, questi sistemi aggiungono uno strato che controlla e verifica ciò che l'IA produce, un po' come un controllore di fatti integrato. L'obiettivo è assicurarsi che qualsiasi informazione proveniente dall'IA sia effettivamente solida prima che qualcuno si affidi ad essa.

Un progetto che opera con questa idea è Mira Network. Il loro protocollo prende l'output dell'IA & lo passa attraverso un processo di verifica decentralizzato. Quindi, invece di fidarsi di un grande modello, Mira scompone tutto; ogni risposta viene divisa in affermazioni più piccole & poi un gruppo di modelli IA indipendenti controlla quelle affermazioni. Se la maggior parte di essi concorda, l'informazione viene verificata.

Funziona un po' come i blockchain validano le transazioni invece di un'autorità centrale che dice cosa è vero, si ottiene consenso da una rete di partecipanti indipendenti. Mira porta quell'idea nell'IA assicurandosi che le risposte siano testate & confermate prima che qualcuno le accetti come fatti.

Man mano che l'IA diventa una parte sempre più grande della vita quotidiana, analizzando i mercati, aiutando con le scelte mediche, automatizzando la ricerca, gestendo il servizio clienti, la capacità di fidarsi delle sue risposte diventa sempre più importante. In futuro, vedremo agenti IA gestire anche questioni più complesse da soli. In quelle situazioni, è necessario sapere che le informazioni siano corrette. I sistemi di verifica come Mira aiutano a ridurre i rischi e a rendere le decisioni automatizzate qualcosa di cui ci si può effettivamente fidare.

Per anni, l'IA si è concentrata sul rendere le macchine più intelligenti. Ma ora, la vera sfida è la fiducia. Forse invece di chiedere: “Quanto potenti possiamo rendere questi modelli?”, dovremmo chiederci: “Quanto è affidabile la loro output?”. Progetti come Mira Network suggeriscono che il futuro dell'IA non riguarda solo l'intelligenza, ma consiste nel trasformare previsioni incerte in informazioni solide come una roccia. Se questo approccio continua a progredire, la prossima rivoluzione dell'IA non riguarderà macchine più intelligenti, ma macchine le cui risposte puoi finalmente credere.