Chiunque trascorra del tempo utilizzando i moderni sistemi di IA alla fine nota un modello strano. Le risposte spesso suonano sicure, ben strutturate e riflessive. Eppure a volte sono semplicemente sbagliate. Questi errori sono comunemente chiamati allucinazioni dell'IA, dove un modello genera informazioni che suonano plausibili ma non hanno alcuna base fattuale.

Il problema non riguarda solo l'accuratezza. Si tratta di fiducia. Man mano che l'IA diventa più coinvolta nella ricerca, nel processo decisionale e nella raccolta di informazioni quotidiane, la domanda diventa semplice: come verifichiamo ciò che un sistema di IA dice?

Questa è la domanda che il progetto dietro @Mira - Trust Layer of AI sta cercando di affrontare da un'angolazione diversa.

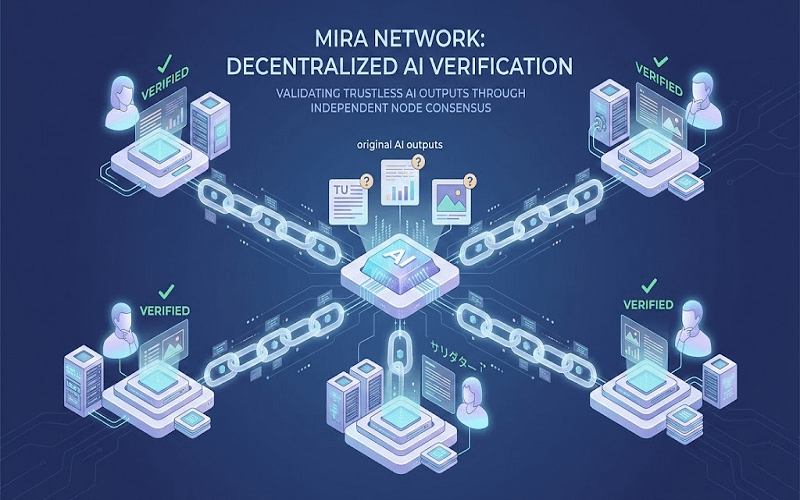

Mira Network è progettato come uno strato di verifica per le uscite dell'IA piuttosto che un altro modello di IA che cerca di produrre risposte migliori. Invece di concentrarsi solo sulla generazione, il sistema si concentra sulla verifica. L'idea è semplice. Quando un'IA produce una risposta, Mira cerca di verificare se le dichiarazioni all'interno di quella risposta possono effettivamente essere supportate.

Il sistema funziona separando un pezzo di output dell'IA in affermazioni fattuali più piccole. Un paragrafo scritto da un modello può contenere diverse dichiarazioni, ognuna delle quali può essere esaminata indipendentemente. Invece di accettare l'intera risposta come un'unità unica, Mira la suddivide in parti che possono essere testate.

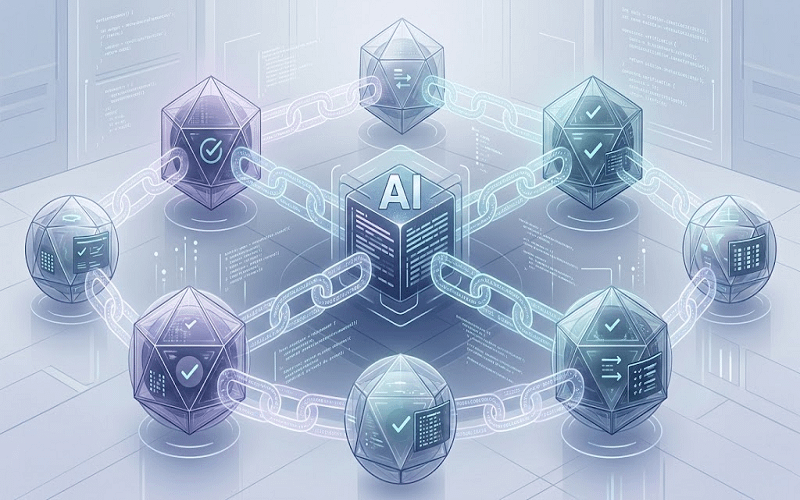

Una volta estratte quelle affermazioni, vengono valutate da più modelli AI indipendenti. Ogni modello agisce come un revisore che esamina la stessa dichiarazione dalla propria prospettiva. Se diversi modelli concordano che un'affermazione è coerente con le informazioni note, il sistema aumenta la fiducia in quell'affermazione. Se appare disaccordo, l'affermazione viene contrassegnata come incerta o potenzialmente errata.

Questo processo di verifica distribuito è centrale per come #MiraNetwork affronta l'affidabilità dell'IA. L'obiettivo non è assumere che un singolo modello sia perfettamente accurato, ma trattare i modelli come partecipanti a un processo di valutazione collettiva.

La tecnologia blockchain gioca un ruolo diverso qui. Invece di generare conoscenza, aiuta a registrare e coordinare il processo di verifica. Quando diversi validatori eseguono modelli e controllano le affermazioni, i loro risultati possono essere registrati tramite consenso blockchain. Le prove crittografiche consentono ad altri di confermare che la verifica sia effettivamente avvenuta e non sia stata alterata successivamente.

Questo è il punto in cui il token $MIRA entra nel sistema. È legato alla struttura economica che incoraggia i partecipanti a eseguire compiti di verifica e contribuire con risorse computazionali. In teoria, una rete di validatori indipendenti può controllare le uscite dell'IA in modo trasparente e tracciabile.

Il potenziale beneficio di questo approccio è semplice. Le risposte dell'IA potrebbero eventualmente arrivare con una forma di storia di verifica. Anziché fidarsi di un modello solo perché sembra sicuro, gli utenti potrebbero vedere se più valutatori concordano con le affermazioni sottostanti.

Allo stesso tempo, il sistema non risolve ogni problema. I modelli di verifica possono ancora ereditare pregiudizi dai loro dati di addestramento. Alcune affermazioni possono essere difficili da valutare automaticamente, specialmente se dipendono da interpretazioni o conoscenze incomplete. E eseguire più controlli su sistemi distribuiti aggiunge costi e complessità.

Anche con queste limitazioni, l'idea dietro #Mira è interessante perché tratta le uscite dell'IA più come ipotesi scientifiche che come risposte definitive. Invece di fidarsi della prima risposta, la rete cerca di costruire un processo per verificarla. In un mondo in cui l'IA produce più informazioni che mai, quel tipo di secondo parere potrebbe diventare sempre più prezioso.