La narrativa dell'IA del 2025 è dominata da un'ossessione pericolosa: la ricerca della scala a scapito della certezza. Ogni sviluppatore e investitore sembra fissato su più parametri, finestre di contesto più ampie e inferenze più rapide. Ma per quelli di noi che operano nel mondo ad alto rischio della finanza decentralizzata e della governance automatizzata, la velocità è una responsabilità quando l'output è meramente una "previsione". Questa è l'origine della "Tassa di Allucinazione"—il massiccio rischio finanziario e operativo sostenuto quando l'IA non verificata prende decisioni senza supervisione umana. Quando l'Intelligenza Artificiale fa previsioni che sembrano certe, diventa pericolosa, specialmente quando viene utilizzata per analizzare contratti o eseguire operazioni.

Mira Network non è solo un altro progetto che costruisce sull'hype dell'IA; sta costruendo l'infrastruttura che rende quell'hype sicuro per il capitale. Il problema fondamentale è che i modelli di IA attuali sono "monolitici". Quando un modello genera una strategia di trading o un'analisi di contratto, all'utente viene presentato un output da prendere o lasciare. Se il modello "hallucina" un fatto o calcola erroneamente un rischio, non c'è alcun segnale interno per avvisare l'utente. Il sistema sembra pulito, sicuro e perfettamente strutturato, eppure può essere fondamentalmente sbagliato. Questo divario tra fiducia e correttezza è dove la fiducia istituzionale va a morire.

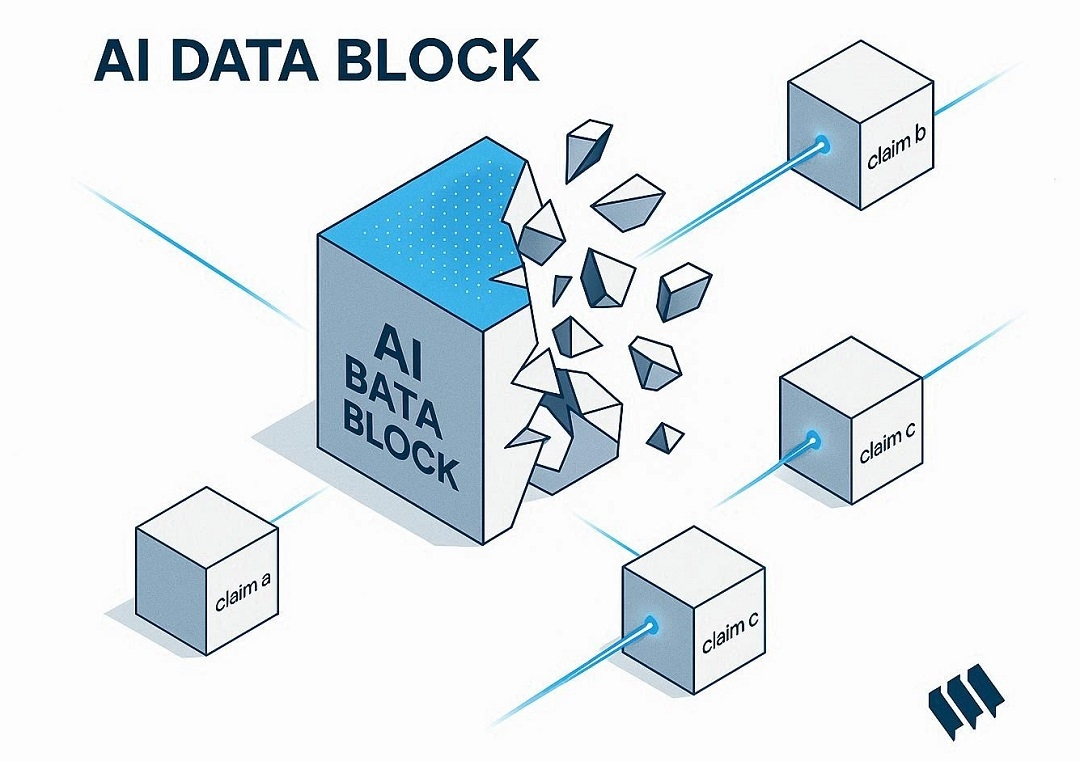

La soluzione di Mira è elegante tanto quanto rigorosa: non accettare semplicemente; verifica. Invece di trattare l'output dell'IA come un blocco unico, il protocollo lo scompone in affermazioni discrete e verificabili in modo indipendente. Questi frammenti vengono poi distribuiti su una rete decentralizzata di nodi validatori indipendenti. Questi non sono solo modelli ridondanti; sono entità diverse—che vanno da modelli puri di IA a partecipanti ibridi umani-IA—ognuna operante senza sapere cosa stiano valutando gli altri.

Il motore che guida questa verifica non è solo codice; sono incentivi economici. Mira utilizza un meccanismo ibrido di Proof-of-Work e Proof-of-Stake per garantire che ogni affermazione sia difesa dal capitale. Il token $MIRA, con una fornitura fissa di un miliardo di token principalmente sulle catene Base e BNB, funge da collaterale per questa verità. I validatori devono mettere in stake $MIRA

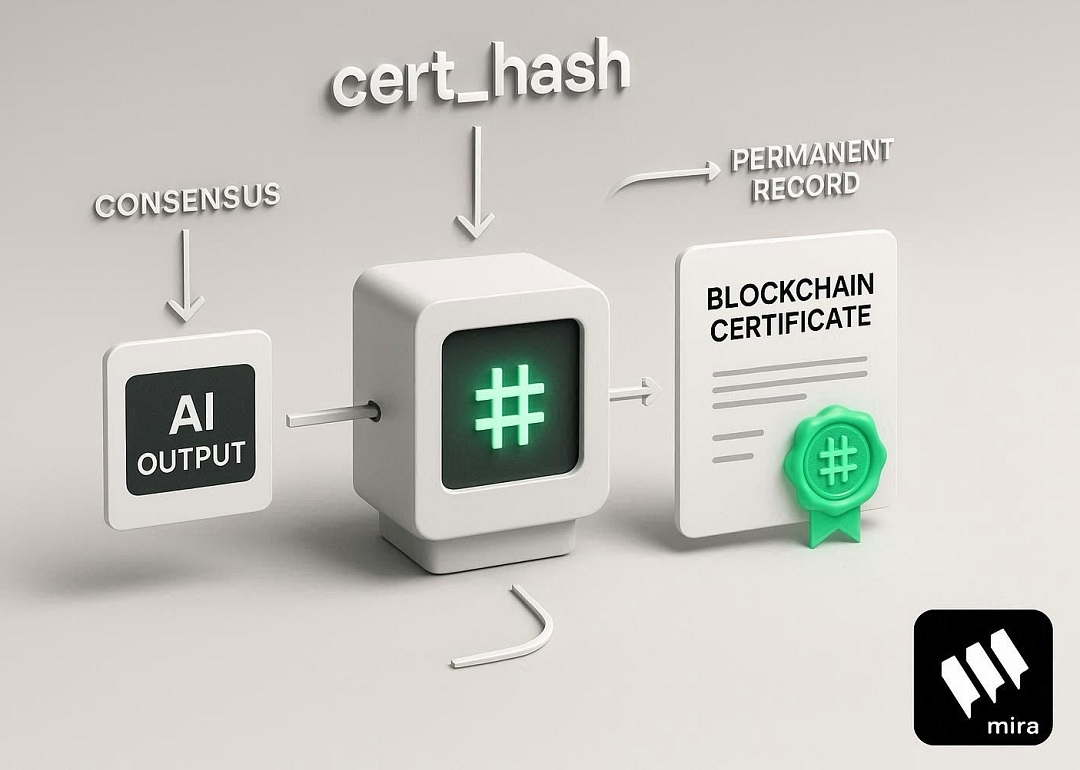

Per uno sviluppatore, il prodotto finale di Mira è il cert_hash. Questo certificato crittografico ancorato un output specifico a un giro di consenso specifico sulla blockchain. È il record auditabile che i regolatori, gli auditor e le DAO possono risalire per vedere esattamente come è stata difesa una decisione. Tuttavia, esiste una sfida critica di integrazione: la tensione tra latenza e integrità. Molti sviluppatori erroneamente danno priorità alla risposta API "200 OK" rispetto al certificato di verifica finale. Ma in un sistema finanziario, un badge "verificato" che si attiva prima che il cert_hash venga restituito non è altro che un badge di latenza.

Il mercato ha già segnalato l'importanza di questo strato. Con un round di finanziamento seed da 9 milioni di dollari da pesi massimi come Framework Ventures e Bitkraft Ventures, e la sua selezione per il Binance HODLer Airdrop a settembre 2025, Mira sta rapidamente diventando lo "Strato di Fiducia" dell'IA. Inoltre, un programma di sovvenzioni per sviluppatori da 10 milioni di dollari dimostra che stanno costruendo un ecosistema, non solo un prodotto. Che si tratti di alimentare Klok—il loro chatbot IA verificato—o di gestire strategie DeFi complesse on-chain, l'obiettivo rimane lo stesso: spostare gli agenti IA da strumenti che supervisioniamo a sistemi di cui possiamo fidarci in modo comprovato. L'era della fede cieca nell'IA è finita; è iniziata l'era dell'autonomia verificata.

@Mira - Trust Layer of AI $MIRA #Mira #mira #bnb