C'è una tensione silenziosa che emerge all'incrocio tra robotica e intelligenza artificiale. Le macchine stanno diventando più capaci, più autonome e più integrate negli ambienti quotidiani, eppure i sistemi che governano come queste macchine prendono decisioni rimangono sorprendentemente fragili. Un robot che interagisce con il mondo fisico non può semplicemente fare affidamento su output probabilistici da una rete neurale. Quando le macchine spostano oggetti, assistono gli esseri umani o coordinano con altre macchine, il costo di una decisione errata diventa tangibile. Una misinterpretazione non è più solo una frase difettosa in una risposta di chatbot. Può tradursi in errore fisico, danno economico o persino rischi per la sicurezza.

È qui che la sfida strutturale inizia a apparire. I moderni sistemi AI sono potenti ma fondamentalmente opachi. I loro output sono generati attraverso inferenza statistica piuttosto che ragionamento verificabile. Allo stesso tempo, la robotica sta lentamente passando da macchine isolate a sistemi connessi che condividono dati, collaborano ed evolvono attraverso input distribuiti. Nel momento in cui questi due domini convergono, emerge un problema più profondo: chi verifica la macchina?

L'infrastruttura tecnologica tradizionale risolve questo attraverso un controllo centralizzato. Le aziende costruiscono piattaforme proprietarie che controllano lo stack software, gestiscono gli aggiornamenti dei dispositivi, validano le computazioni e impongono regole su come le macchine si comportano. Questo approccio funziona, ma concentra l'autorità. Limita anche l'interoperabilità e crea un sistema in cui la fiducia scorre attraverso istituzioni piuttosto che meccanismi trasparenti.

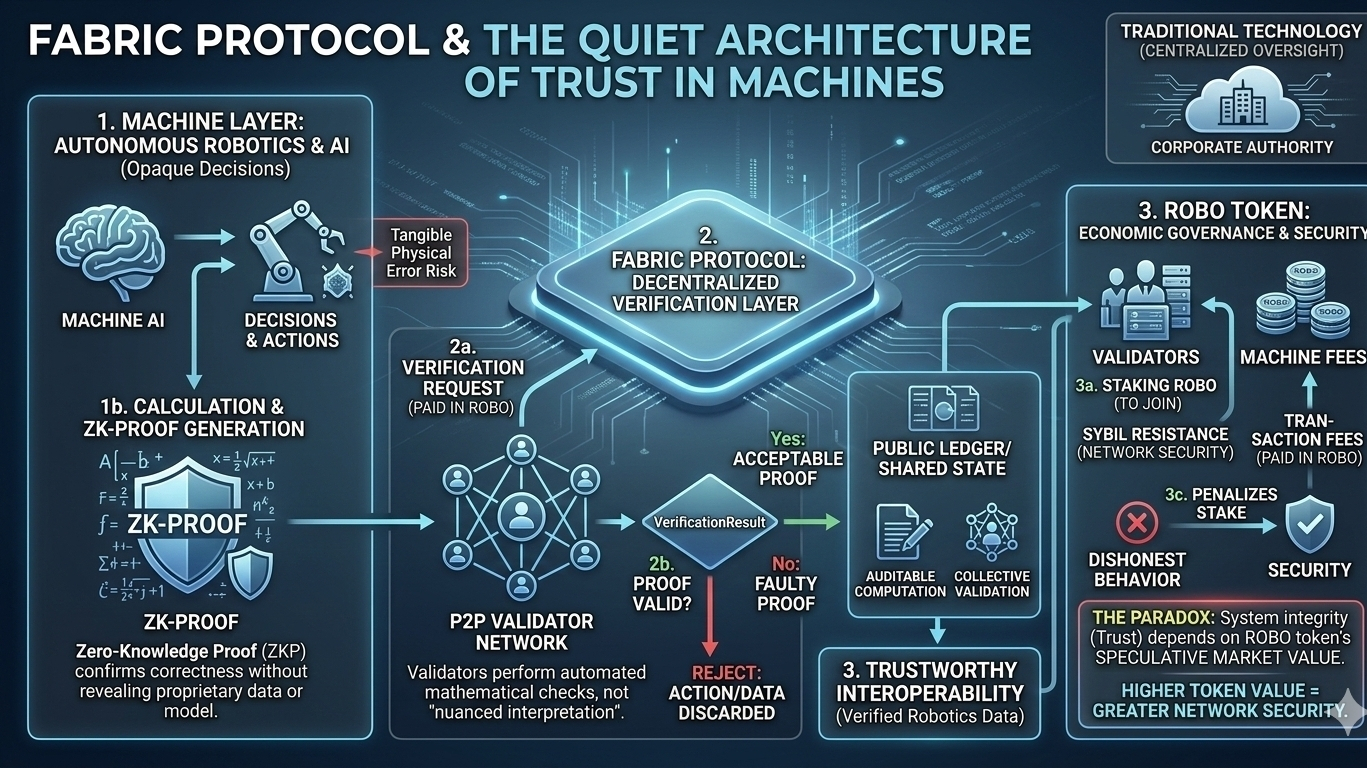

Il Fabric Protocol emerge come un tentativo di ripensare questa architettura. Invece di assumere che la fiducia debba originare da un'autorità centrale, il protocollo propone una rete aperta in cui l'attività delle macchine, i dati e la computazione possono essere verificati e coordinati attraverso un libro mastro condiviso. L'ambizione non è semplicemente connettere i robot, ma creare una struttura in cui le azioni e il ragionamento delle macchine possano essere convalidate attraverso una rete decentralizzata.

A livello tecnico, il protocollo funziona come uno strato di coordinamento che si trova tra i sistemi robotici, gli agenti AI e l'infrastruttura blockchain. I robot e gli agenti software generano dati, eseguono compiti e producono output computazionali. Piuttosto che accettare questi output come risultati opachi, la rete li scompone in unità verificabili che possono essere controllate tra partecipanti indipendenti. I validatori osservano, confermano e registrano questi risultati su un libro mastro pubblico, consentendo al sistema più ampio di trattare il risultato come verificato piuttosto che assunto.

Questo design introduce un diverso tipo di infrastruttura per la robotica. Invece di macchine che agiscono all'interno di ecosistemi isolati, operano all'interno di uno strato di coordinamento verificabile. I dati scorrono attraverso la rete, la computazione diventa verificabile e i processi decisionali possono essere validati collettivamente piuttosto che fidarsi ciecamente.

Ciò che rende questo approccio interessante è che tratta la robotica non solo come hardware, ma come un problema di sistema distribuito. Una volta che i robot collaborano con agenti AI e servizi cloud, diventano parte di una rete computazionale più ampia. Il Fabric Protocol riconosce efficacemente questa realtà e tenta di fornire l'infrastruttura mancante per la verifica e il coordinamento.

Ma il successo di un tale sistema dipende da qualcosa di più fragile della tecnologia: la fiducia all'interno dello strato di validazione.

In una rete di verifica decentralizzata, i validatori diventano le entità responsabili di confermare se gli output delle macchine sono legittimi. Il loro ruolo non è banale. Devono valutare dati complessi, interpretare prove computazionali e determinare collettivamente se i risultati devono essere accettati nello stato condiviso della rete. Questa responsabilità introduce una tensione sottile ma critica.

Se i validatori si concentrano tra un piccolo gruppo di attori, il sistema rischia di deviare verso la stessa centralizzazione che l'infrastruttura decentralizzata cerca di evitare. Un insieme ristretto di validatori può essere più facile da coordinare e più efficiente operativamente, ma indebolisce la promessa fondamentale della verifica distribuita. Il libro mastro potrebbe ancora esistere, ma le assunzioni di fiducia crollano silenziosamente di nuovo in un cerchio più ristretto di autorità.

D'altra parte, espandere la rete di validatori introduce le proprie difficoltà. Un gruppo più grande aumenta la resilienza e la diversità della verifica, ma solleva anche domande sulla competenza e la responsabilità. I dati della robotica possono essere complessi. Gli output AI possono richiedere un'interpretazione sfumata. Un sistema che si basa su molti validatori indipendenti deve garantire che quei validatori possiedano sia la capacità tecnica che gli incentivi economici per eseguire una verifica accurata.

Questa dinamica porta a una sfida più profonda: la responsabilità all'interno dei sistemi di verifica decentralizzati.

Nell'infrastruttura tradizionale, se un sistema robotico fallisce, di solito c'è una chiara catena di responsabilità. Un'azienda ha costruito l'hardware, sviluppato il software e distribuito il sistema. La responsabilità e il controllo scorrono attraverso organizzazioni identificabili. I sistemi decentralizzati complicano questa struttura. Quando la verifica è distribuita attraverso una rete di validatori indipendenti, la responsabilità diventa più diffusa.

Il Fabric Protocol tenta di affrontare questo allineando il comportamento dei validatori con incentivi economici. I partecipanti scommettono valore all'interno della rete e rischiano penalità se convalidano risultati scorretti o disonesti. Il token ROBO esiste principalmente all'interno di questo framework di coordinamento, consentendo staking, partecipazione e allineamento a livello di rete. Funziona meno come un asset speculativo e più come un meccanismo che lega i partecipanti all'integrità del sistema.

Tuttavia, l'allineamento degli incentivi non garantisce automaticamente un comportamento corretto. I sistemi economici possono incoraggiare l'onestà, ma non possono sostituire completamente il giudizio. I validatori devono ancora interpretare gli output generati dalle macchine e determinare se riflettono un calcolo accurato o un ragionamento fallace. La rete si basa quindi su una combinazione di pressione economica e metodi di verifica tecnica per mantenere l'integrità.

L'implicazione più ampia è che il Fabric Protocol sta cercando di costruire qualcosa di raramente discusso nella robotica: uno strato di governance per il comportamento delle macchine.

Man mano che i robot diventano più capaci e gli agenti AI iniziano a operare autonomamente, le società chiederanno inevitabilmente chi controlla le regole che governano questi sistemi. Un'infrastruttura decentralizzata introduce la possibilità che queste regole possano emergere attraverso il consenso della rete piuttosto che attraverso decisioni aziendali centralizzate. Questa idea ha implicazioni istituzionali significative.

I governi, le industrie e gli sviluppatori potrebbero trovarsi ad interagire con uno strato di verifica aperto che registra l'attività delle macchine e coordina la validazione computazionale tra attori indipendenti. Una tale struttura potrebbe aumentare la trasparenza e la resilienza, ma sfida anche i tradizionali quadri normativi che si basano su un controllo centralizzato.

Tuttavia, esiste un compromesso strutturale inevitabile incorporato in questa architettura.

Gli strati di verifica introducono inevitabilmente attriti. Ogni volta che un'azione della macchina o un output computazionale deve essere convalidato attraverso una rete distribuita, la latenza aumenta. I sistemi che danno priorità alla verifica spesso sacrificano la velocità. Nella robotica, dove il processo decisionale in tempo reale può essere critico, questo compromesso diventa particolarmente significativo.

Il Fabric Protocol opera quindi in un delicato equilibrio tra sicurezza ed efficienza. Troppa verifica e il sistema rischia di rallentare l'interazione delle macchine. Troppo poca e l'infrastruttura inizia a somigliare ai sistemi opachi che è stata progettata per migliorare.

Questa tensione riflette una domanda più ampia sul futuro dell'infrastruttura AI decentralizzata. Man mano che le macchine diventano più autonome e interconnesse, le società avranno bisogno di meccanismi per garantire che le loro decisioni possano essere fidate. Gli strati di verifica come il Fabric Protocol rappresentano una possibile direzione, dove la fiducia emerge da una coordinazione distribuita piuttosto che da un'autorità centralizzata.

Rimane incerto se tali sistemi possano scalare mantenendo sia l'efficienza che la responsabilità.

Ciò che è chiaro è che la robotica e l'AI si stanno gradualmente trasformando da tecnologie isolate in infrastrutture condivise. E una volta che le macchine iniziano a operare all'interno di reti aperte di verifica e governance, la domanda potrebbe non essere più quanto siano intelligenti, ma come la loro intelligenza sia collettivamente fidata.

@Fabric Foundation #ROBO $ROBO