Dopo aver trascorso del tempo a leggere le note tecniche e seguendo @Mira - Trust Layer of AI , ho cominciato a vedere Mira meno come un altro progetto blockchain e più come un tentativo di risolvere qualcosa con cui l'IA fatica ancora: l'affidabilità.

La maggior parte dei grandi modelli di intelligenza artificiale sono impressionanti, ma non sono affidabili in un senso stretto. Generano risposte che sembrano corrette anche quando non lo sono. Allucinazioni, pregiudizi sottili, eccessiva fiducia: questi non sono casi rari. Sono effetti collaterali strutturali di come funzionano i modelli probabilistici.

Mira Network affronta questo da un'angolazione diversa. Invece di cercare di costruire un modello unico più intelligente, si concentra sulla verifica di ciò che producono i sistemi di IA.

Quella distinzione è importante.

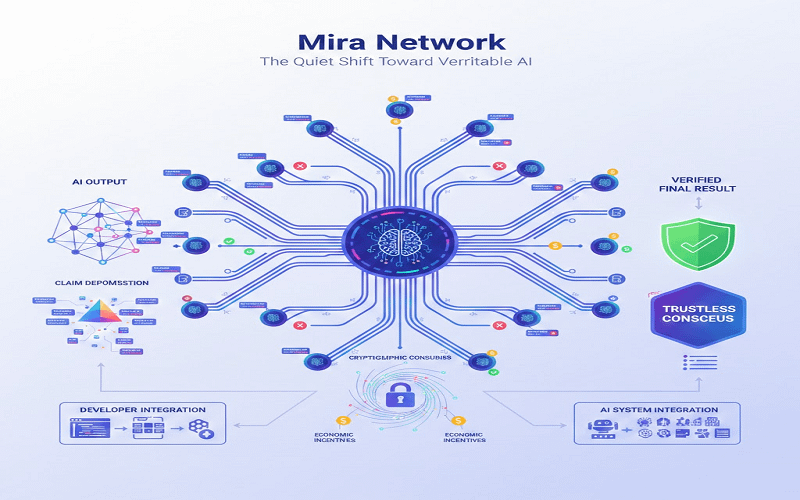

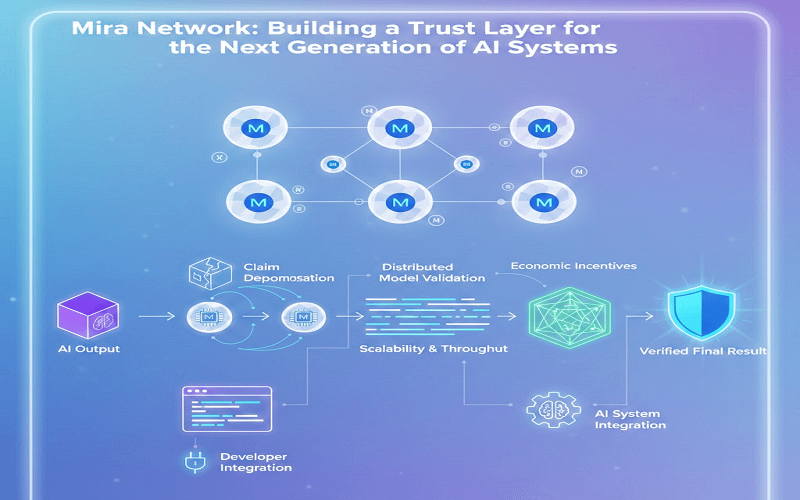

L'idea centrale dietro #MiraNetwork è piuttosto semplice: suddividere un output dell'IA in affermazioni più piccole, quindi convalidare quelle affermazioni attraverso modelli indipendenti. Invece di fidarsi del punteggio di fiducia di un sistema, la rete crea uno strato di verifica sopra l'IA.

Mi ricorda come funziona il fact-checking nel giornalismo. Una fonte non è sufficiente. Si incrocia. Si confronta. Si cerca coerenza tra punti di vista indipendenti. Mira formalizza quel processo per le informazioni generate dalle macchine.

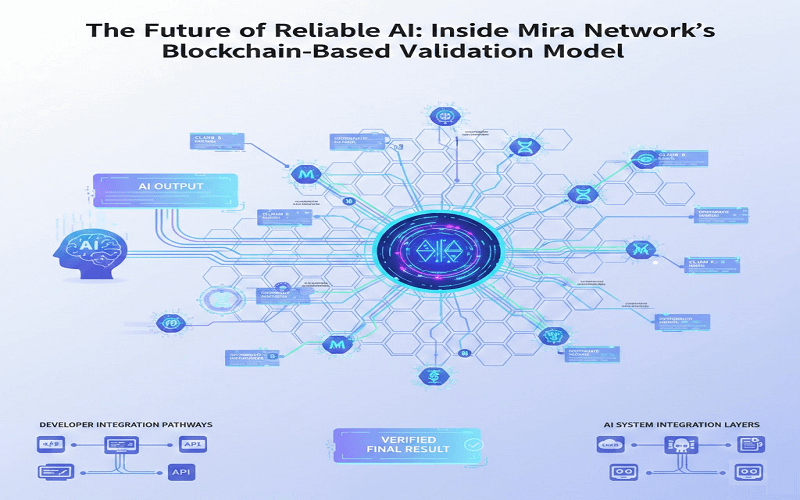

Quando un'IA produce una risposta, il protocollo di Mira la scompone in dichiarazioni verificabili. Queste dichiarazioni vengono poi valutate da più validatori di IA indipendenti. Le loro valutazioni vengono registrate e aggregate utilizzando un consenso basato su blockchain. Il risultato non è solo “il modello dice che è giusto”, ma “un insieme distribuito di modelli è giunto a questa conclusione.”

Questo è un cambiamento sottile ma importante.

La validazione tradizionale dell'IA è centralizzata. Un'azienda addestra un modello, esegue test interni e pubblica benchmark. La fiducia è riposta nell'organizzazione. Con Mira, la validazione è esternalizzata. Il processo di verifica è distribuito e il consenso è registrato crittograficamente. Lo strato blockchain garantisce che i registri di validazione non possano essere alterati dopo il fatto.

Quindi, invece di fidarsi di un unico fornitore, gli utenti si affidano a un meccanismo di verifica trasparente.

Il token, $MIRA , gioca un ruolo pratico qui. Allinea gli incentivi all'interno della rete. I validatori sono economicamente motivati a fornire valutazioni accurate perché la validazione disonesta o di bassa qualità può essere penalizzata. In teoria, questo scoraggia comportamenti negligenti e incoraggia una valutazione attenta degli output dell'IA.

Non si tratta di hype o velocità. Si tratta di responsabilità.

Ciò che trovo interessante è che Mira non sta cercando di competere direttamente con gli sviluppatori di modelli. Si sta posizionando come infrastruttura — uno strato di fiducia che può trovarsi sotto le applicazioni. Pensalo come un filtro di affidabilità che può essere integrato nei sistemi di IA esistenti. Se l'IA diventa più integrata nella finanza, nella sanità, nella ricerca o nei sistemi decisionali automatizzati, la verifica sarà più importante della creatività grezza.

Certo, ci sono compromessi.

La verifica distribuita aumenta il costo computazionale. Eseguire più modelli per convalidare ogni output è più pesante che fidarsi di uno. Il coordinamento tra i validatori introduce complessità. E lo spazio più ampio dell'infrastruttura dell'IA decentralizzata sta diventando affollato, il che significa che Mira deve differenziarsi attraverso l'esecuzione, non la narrazione.

C'è anche la realtà che l'ecosistema è ancora nelle fasi iniziali. Gli strumenti per sviluppatori, i percorsi di integrazione e l'adozione nel mondo reale richiedono tempo. Gli strati di verifica sono utili solo se le applicazioni scelgono di utilizzarli.

Tuttavia, la logica strutturale ha senso per me.

I sistemi di IA generano probabilità. I sistemi blockchain generano consenso. Mira cerca di combinare quelle due proprietà intelligenza probabilistica e verifica deterministica in un unico flusso di lavoro.

Questo sembra un approccio solido a un problema reale.

#Mira non sta cercando di sostituire i modelli di IA. Sta cercando di renderli responsabili in modo decentralizzato. E in uno spazio dove la fiducia è spesso implicita piuttosto che dimostrata, costruire una verifica esplicita nell'architettura sembra una direzione ragionevole.

Quando mi allontano dai dettagli tecnici, sembra meno un'innovazione appariscente e più uno strato necessario di cui l'IA potrebbe aver bisogno silenziosamente mentre cresce.