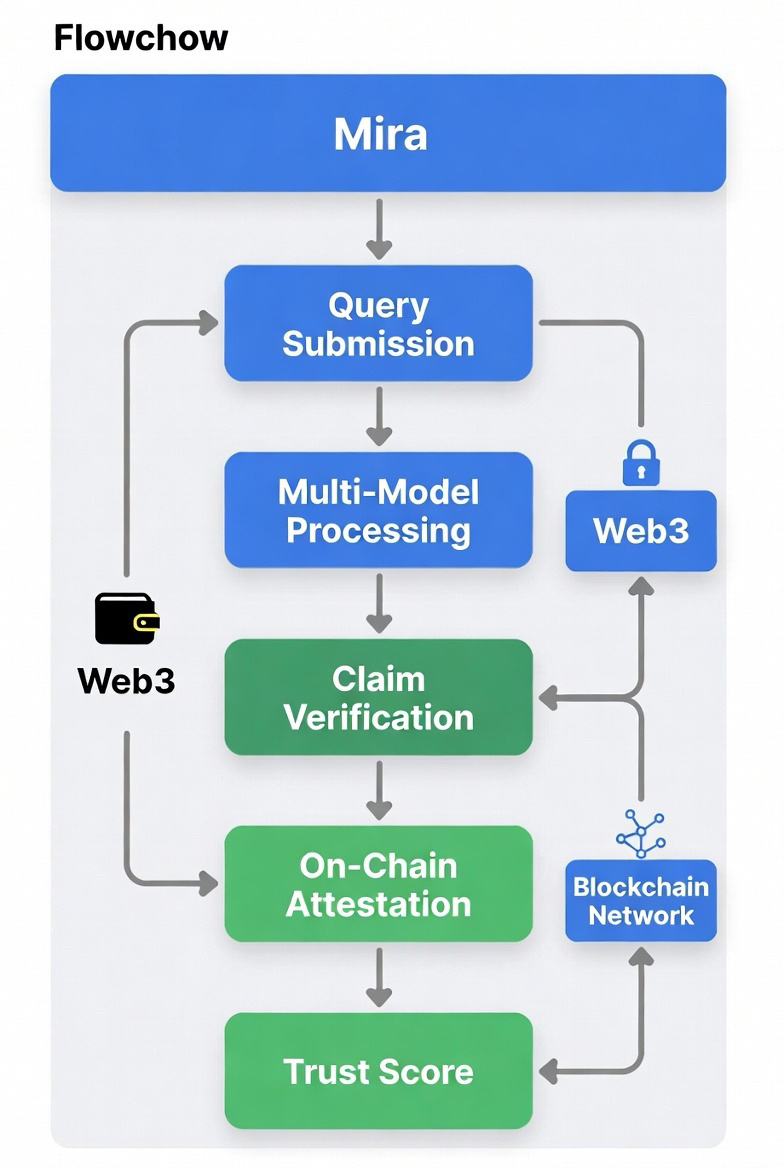

Un problema silenzioso ma importante è sorto man mano che i sistemi di intelligenza artificiale diventano più frequenti e potenti: come possiamo fidarci di ciò che ci dicono? Come possiamo sapere che la risposta è accurata? Per affrontare questo, il progetto blockchain Mira, che ha la sua sede a Zug, in Svizzera, sta sviluppando un "livello di fiducia" decentralizzato che verificherà i risultati dei modelli linguistici attuali attraverso un consenso trasparente on-chain piuttosto che competere con essi.

Quadro chiave: Da indagine a risultato confermato

Invio di query:

Attraverso l'API di Mira, un utente, qualsiasi sviluppatore software o applicazione invia un prompt o una query (ad esempio, "Analizza questo grafico e analizza la struttura di mercato?" o "Questa notizia è accurata?").

Sequenza di Elaborazione Attraverso i Modelli:

Mira instrada la query a un insieme diversificato di modelli AI indipendenti che operano su nodi diversi nella rete. Questi modelli sono modelli open-source, LLM di terze parti o verificatori focalizzati e non sono sotto il controllo di Mira. La diversità è l'obiettivo; nessun modello specifico o azienda può controllare il risultato.

Estrazione di Affermazioni Atomiche e Controllo Incrociato:

Ogni modello scom pone la propria risposta in brevi "affermazioni" verificabili (come "L'articolo evidenzia la fonte X nella data Y"). Per la verifica incrociata, queste affermazioni vengono quindi disperse nuovamente in tutta la rete. Altri modelli valutano la solidità logica, la coerenza e il supporto fattuale di ciascuna affermazione.

Accordo Decentralizzato:

Un meccanismo di consenso leggero è utilizzato dai nodi per arrivare a un accordo. Un'attestazione crittografica è fornita per le affermazioni che ottengono un consenso di maggioranza. Le affermazioni che sono contestate o hanno poco consenso vengono contrassegnate o ignorate. L'intero processo è permanentemente documentato on-chain.

Risultati Finalizzati & Punteggio di Fiducia:

Attraverso l'API di Mira, un utente, qualsiasi sviluppatore software o applicazione invia un prompt o una query (ad esempio, "Analizza questo grafico e analizza la struttura di mercato?" o "Questa notizia è accurata?"). Mira utilizza l'affidabilità storica dei nodi, la diversità dei modelli e la forza del consenso per determinare un Punteggio di Fiducia in tempo reale (0–100). La risposta verificata viene inviata all'utente insieme a una prova verificabile (zk-proof o radice di Merkle) che chiunque può audire in un secondo momento.

Il Ruolo del $MIRA Token

Staking & Operazione Node – I partecipanti mettono in stake il token per far funzionare i nodi per il processo di verifica. La partecipazione onesta è premiata, mentre la partecipazione disonesta comporta la riduzione dello stake.

Strato di Pagamento – I partecipanti pagano piccole commissioni ai nodi per eseguire i lavori di verifica. Il pagamento viene effettuato sotto forma di token.

Governance – I detentori del token votano per decidere gli aggiornamenti del protocollo, le regole per l'inclusione nel modello, i parametri di slashing e la struttura delle commissioni.

Sicurezza Economica – L'offerta totale del token è fissata a 1 miliardo di token.

Perché Mira è Importante?

La maggior parte dei progetti AI insegue modelli più grandi o inferenze più veloci. Mira si concentra sul problema noioso ma essenziale della fiducia e della verificabilità. In un futuro in cui l'AI genera documenti legali, report finanziari, notizie, consigli medici o segnali di trading, uno strato decentralizzato e verificabile che dimostra “questo output è stato controllato da oltre 20 modelli indipendenti e l'85% ha concordato” potrebbe diventare un'infrastruttura fondamentale — simile a come HTTPS è diventato non negoziabile per la sicurezza web.

Mira è ancora in fase iniziale (testnet attiva, mainnet in arrivo), ma la sua architettura è deliberatamente ristretta e focalizzata: risolvere la fiducia, nient'altro. Per chiunque sia preoccupato per l'affidabilità dell'AI in Web3, finanza, giornalismo o governance, Mira rappresenta un passo pragmatico verso un mondo in cui non dobbiamo fidarci ciecamente dell'AI a scatola nera.