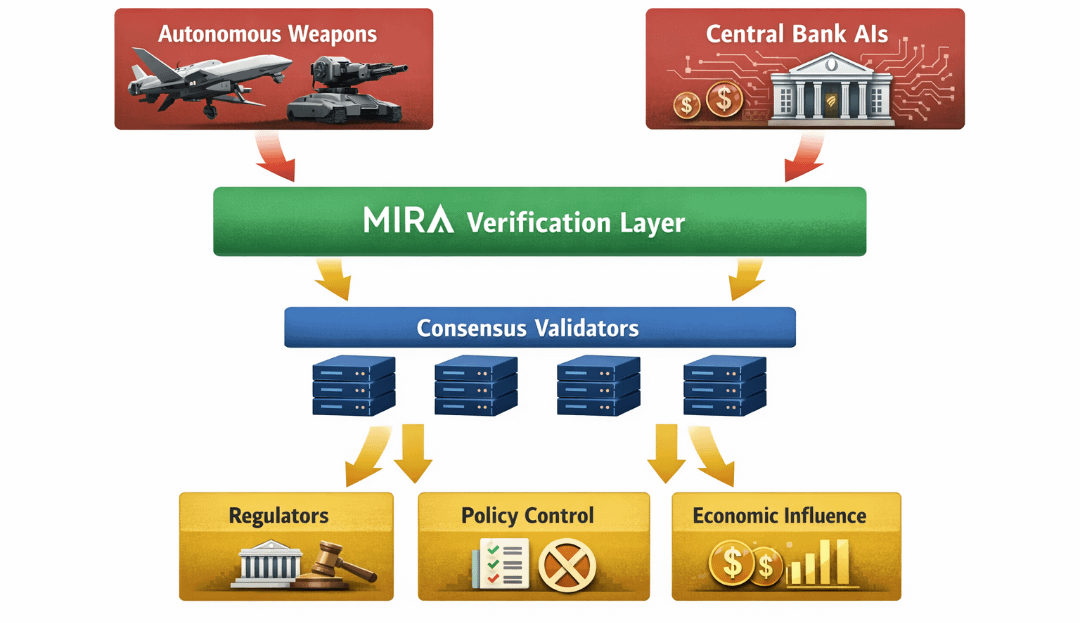

Se $MIRA diventasse il livello di verifica predefinito per le armi autonome e le IA delle banche centrali, i validatori di consenso sostituirebbero silenziosamente i regolatori come i veri centri di potere?

Il mese scorso, stavo trasferendo fondi attraverso la mia app bancaria quando lo schermo si è bloccato per tre secondi su un banner di “valutazione del rischio in elaborazione”. L'importo non era cambiato. Il destinatario era stato salvato. Ma quando l'interfaccia utente si è aggiornata, il tasso di cambio era leggermente cambiato, e è comparsa una piccola tassa di conformità che non era stata anticipata. Nessun avviso. Nessuna spiegazione. Solo una decisione del backend a cui non ho mai acconsentito esplicitamente. Il sistema si è mosso per primo; io ho reagito dopo.

Non era frode. Non era nemmeno malfunzionamento. Era qualcosa di più silenzioso — una asimmetria strutturale. L'IA dell'istituzione ha emesso un giudizio di conformità, applicandolo in tempo reale, e il contratto tra noi è stato effettivamente riscritto a metà esecuzione. Non potevo auditare il modello. Non potevo vedere i parametri. Non potevo contestare la decisione in quel momento. Il potere non sembrava abusivo. Sembrava invisibile.

Quella silenziosa disallineamento sta diventando il sistema operativo della moderna governance digitale. I sistemi autonomi valutano il rischio, approvano prestiti, limitano contenuti, segnalano transazioni e presto — potenzialmente guideranno la politica monetaria e la targeting militare. I regolatori che supervisionano questi sistemi operano ancora in cicli: audit trimestrali, revisioni annuali, enforcement reattivo. Ma i sistemi di IA agiscono in millisecondi. La supervisione è diventata periodica; l'esecuzione è continua. Il risultato è un divario di responsabilità abbastanza ampio da nascondere cambiamenti di potere strutturali.

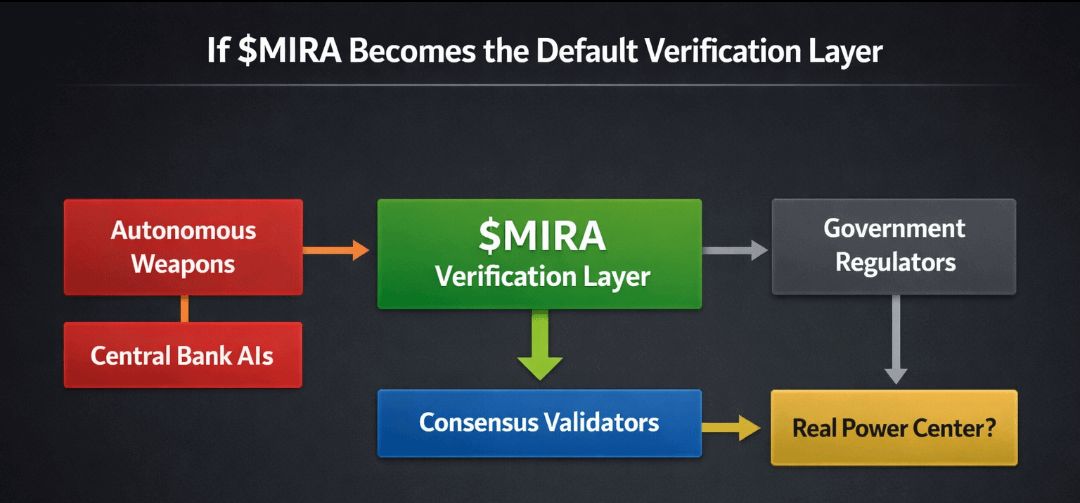

Ho pensato a questo come a un problema di autorità temporale. Chiunque convalidi decisioni in tempo reale, alla velocità di esecuzione, governa efficacemente i risultati. I regolatori tradizionali convalidano ex post — dopo l'azione. Ma i sistemi di IA che gestiscono programmi di liquidità delle banche centrali o armi autonome non possono aspettare una revisione post-fatto. Richiedono validazione sincronizzata. Chi fornisce quel livello diventa il vero punto di strozzatura.

Ethereum, Solana, Avalanche — ogni ecosistema ha affrontato l'esecuzione e la verifica in modo diverso. Ethereum ha ottimizzato per la neutralità credibile, accettando latenza e costi più elevati per preservare la decentralizzazione. Solana ha spinto verso un'esecuzione ad alta capacità, comprimendo il tempo tra decisione e finalità. Avalanche ha sperimentato il consenso probabilistico per accelerare l'accordo. Ma in tutti e tre i casi, la validazione garantisce principalmente le transizioni finanziarie. L'argomento è i token, non le decisioni politiche o i risultati cinetici.

Ora immagina che l'oggetto della validazione non sia solo un trasferimento di token — ma una decisione dell'IA: un'iniezione di liquidità della banca centrale, una bandiera di sanzioni, un'autorizzazione al targeting delle armi. Il validatore non sta più confermando matematica; sta confermando logica di governance. Questo è uno strato qualitativamente diverso di potere.

Ecco il modello mentale che lo ha riformulato per me: le istituzioni moderne stanno diventando aerei, ma i regolatori continuano a operare come investigatori del traffico aereo. Analizzano le scatole nere dopo gli incidenti. Quello che potremmo perdere è la necessità di una rete di co-piloti in tempo reale — uno strato indipendente che verifica ogni manovra prima che venga eseguita. Non controllando l'aereo, ma confermando crittograficamente che il pilota automatico segua vincoli pre-commessi.

Solo dopo aver riflettuto su quella metafora un protocollo come MIRA inizia a avere senso strutturale.

Se $MIRA diventasse il livello di verifica predefinito per i sistemi d'arma autonomi e le IA delle banche centrali, non "sostituirebbe" i regolatori in un senso cerimoniale. Sposterebbe l'autorità temporale. I suoi validatori confermerebbero se un'azione dell'IA aderisca a prove di politica predefinite prima della finalità dell'esecuzione. Il regolatore potrebbe ancora definire le regole. Ma la rete di validatori le farebbe rispettare alla velocità della macchina.

Il meccanismo è importante qui.

Architettonicamente, un tale sistema richiederebbe tre strati:

1. Livello di Codifica della Politica — dove i vincoli normativi vengono formalizzati in logica verificabile.

2. Livello di Interfaccia di Esecuzione — dove i sistemi autonomi presentano azioni previste come prove.

3. Livello di Verifica del Consenso — dove i validatori distribuiti attestano la conformità prima che l'azione si finalizzi.

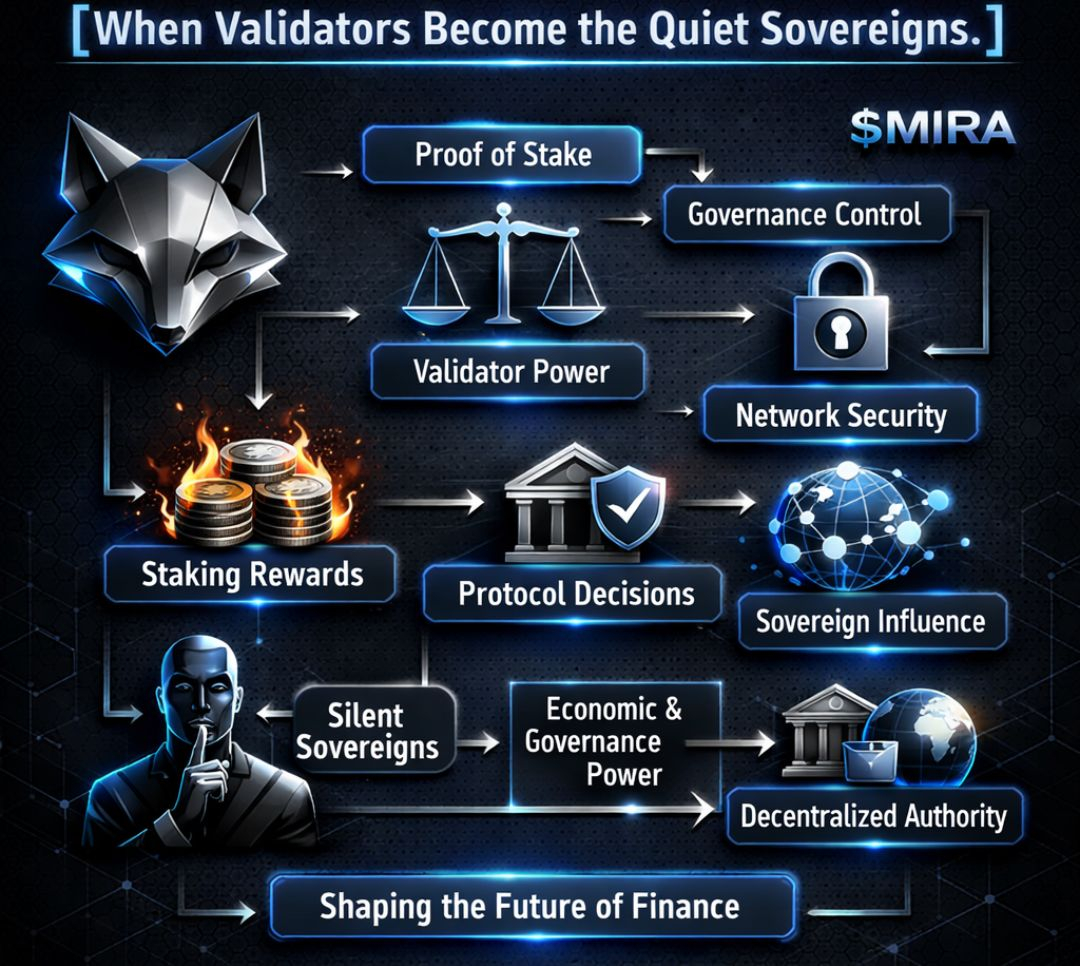

In questo modello, MIRA non è un token applicativo; è la partecipazione che garantisce l'integrità della verifica. I validatori bloccano $MIRA per partecipare all'attestazione delle decisioni dell'IA. Se colludono o approvano azioni non conformi, la loro partecipazione è soggetta a slashing. Questo crea un firewall economico attorno alla logica di governance.

Le dinamiche di esecuzione diventano interessanti. Invece che i regolatori auditare i log mesi dopo, ogni azione AI ad alto rischio porterebbe una ricevuta crittografica: prova di conformità alla politica verificata da un insieme di validatori distribuiti. Il livello di dati richiederebbe probabilmente prove concise — potenzialmente costruzioni a conoscenza zero — per evitare di esporre parametri sensibili del modello pur dimostrando l'aderenza ai vincoli.

Il ciclo di incentivazione è stretto.

Sistema autonomo → presenta prova d'azione → i validatori attestano → l'azione viene eseguita → i validatori guadagnano commissioni MIRA → la partecipazione rimane a rischio per attestazioni fraudolente.

La cattura di valore emerge dalla domanda di verifica. Se le banche centrali, i contraenti della difesa o gli operatori sovrani di IA richiedono attestazioni di conformità credibili, devono pagare le spese di verifica in $MIRA. Più l'amministrazione guidata dall'IA si espande, maggiore è la domanda strutturale per la larghezza di banda di validazione.

La governance all'interno di MIRA stessa diventa paradossale. Se i validatori stanno imponendo vincoli politici per attori sovrani, chi governa i validatori? Probabilmente un modello ibrido: governance ponderata dai token per aggiornamenti del protocollo, combinata con organi esterni di definizione degli standard che definiscono schemi di conformità. Il rischio è ovvio — cattura dei validatori da parte di potenti attori statali. Il contrappeso dovrebbe essere economico: partecipazione ampiamente distribuita e condizioni di slashing trasparenti.

Una semplice rappresentazione visiva chiarirebbe il cambiamento di potere:

Diagramma di Flusso: Governance IA con e senza Livello di Verifica

Colonna di Sinistra (Modello Tradizionale): Decisione IA → Esegui → Log Memorizzato → Audit Regolatorio (Ritardato)

Colonna di Destra (Modello MIRA): Decisione IA → Presenta Prova di Politica → Consenso dei Validatori → Esegui → Ricevuta di Conformità Immutabile

La rappresentazione visiva è importante perché illustra l'inversione temporale. Nel modello tradizionale, la validazione segue l'esecuzione. Nel modello MIRA, la validazione la precede. Quel singolo spostamento riassegna l'autorità effettiva.

Gli effetti di secondo ordine si propagano all'esterno.

Gli sviluppatori che costruiscono sistemi autonomi progettano per la provabilità fin dall'inizio. Le architetture dei modelli potrebbero essere vincolate per consentire prove di conformità, privilegiando componenti interpretabili rispetto a scatole nere opache. Questo potrebbe rallentare alcune forme di innovazione ma aumentare la fiducia sistemica.

Gli utenti — o cittadini — potrebbero iniziare a richiedere ricevute di conformità crittografiche come ci aspettiamo ora le serrature HTTPS nei browser. La fiducia si sposterebbe dalla reputazione istituzionale alla credibilità del gruppo di validatori. La domanda diventa: quale rete di validatori credi?

Ma i rischi sono sostanziali.

Se una piccola coalizione accumula abbastanza $MIRA partecipazione, potrebbe effettivamente porre il veto o approvare decisioni dell'IA su larga scala. Questo non è decentralizzazione; è oligarchia dei validatori. Inoltre, codificare la politica in prove rigide potrebbe congelare la governance adattiva. Le leggi evolvono. I casi limite emergono. I vincoli verificabili dalle macchine possono ritardare le sfumature politiche.

C'è anche una possibilità più oscura: gli stati potrebbero esternalizzare la responsabilità morale al livello di validazione. "La rete l'ha approvato" potrebbe diventare il nuovo scudo burocratico. La responsabilità si diffonde attraverso i nodi.

Eppure, la traiettoria strutturale sembra chiara. Man mano che i sistemi di IA accelerano il processo decisionale oltre la velocità di supervisione umana, i livelli di verifica in tempo reale diventano inevitabili. La domanda non è se tali livelli esisteranno, ma chi li controlla.

Se MIRA dovesse ancorare quel livello per i sistemi d'arma autonomi e le IA delle banche centrali, i validatori di consenso non sostituirebbero cerimonialmente i regolatori. Li sostituirebbero silenziosamente nell'unica dimensione che conta davvero: il momento prima che l'azione diventi irreversibile.

Il potere non migra con i titoli. Migra con il tempo. E chiunque convalidi per primo, governa per ultimo.