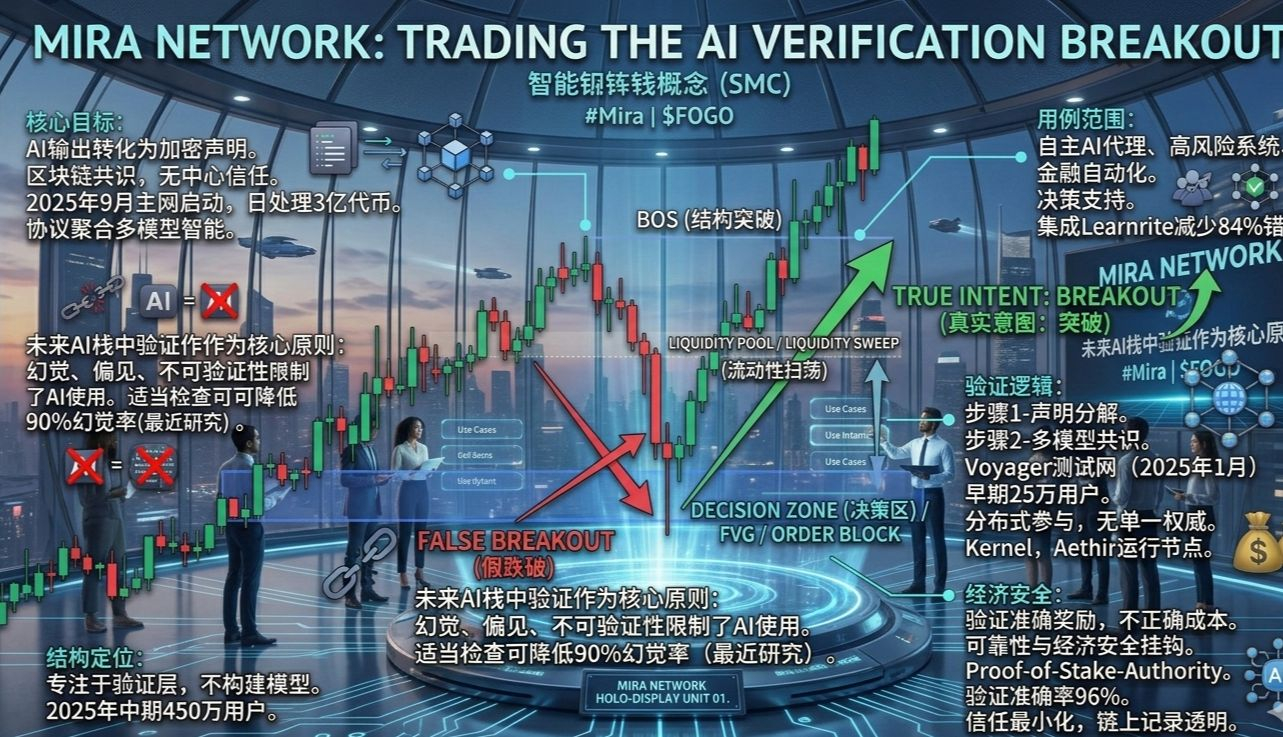

La rete Mira opera come un protocollo di verifica AI decentralizzato.

Trasforma l'output AI in dichiarazioni verificate crittograficamente.

Il lancio della mainnet è avvenuto a settembre 2025 e ora gestisce fino a 300 milioni di token al giorno.

Questa configurazione affronta le questioni chiave dei sistemi AI moderni.

Il problema

I modelli AI attuali generano frequentemente informazioni illusorie.

Possono generare risposte parziali.

L'output manca di verificabilità.

Questi difetti limitano il loro ruolo nelle applicazioni critiche.

Ricerche recenti mostrano che, con un adeguato controllo, il tasso di illusioni è diminuito del 90%.

Obiettivo principale

Mira trasforma l'output AI in dichiarazioni verificabili.

Utilizza un consenso basato su blockchain per la verifica.

Questo elimina la dipendenza dalla fiducia centralizzata.

Il protocollo raccoglie intelligenza collettiva da modelli diversi.

Entro gennaio 2026, i costruttori della comunità hanno sottolineato il loro ruolo infrastrutturale.

Funzionamento (Passo 1)

L'output dell'AI è suddiviso in singole dichiarazioni.

Ogni dichiarazione funge da unità di verifica.

Questo approccio riduce l'ambiguità nelle risposte complesse.

In pratica, il sistema Mira gestisce risposte complesse in modo efficiente.

Il controllo incrociato tra modelli garantisce maggiore accuratezza.

Funzionamento (Passo 2)

Le dichiarazioni sono distribuite a modelli AI indipendenti.

Ogni dichiarazione è verificata più volte.

I risultati vengono confrontati tramite meccanismi di consenso.

Il testnet Voyager di Mira inizia test su larga scala da gennaio 2025.

Oltre 250.000 utenti si sono uniti in anticipo.

Layer di consenso

Nessuna autorità unica controlla la verifica.

Si basa sulla partecipazione distribuita.

Gli incentivi economici guidano la partecipazione.

Processo di coordinamento blockchain.

Partner come Kernel e Aethir gestiscono nodi di verifica.

Modello economico

I partecipanti che verificano dichiarazioni accurate ricevono ricompense.

La verifica errata comporta costi economici.

Questo collega affidabilità e sicurezza economica.

Protegge la rete tramite Proof-of-Stake-Authority.

Il modello supporta la crescita continua dell'ecosistema.

Modello di sicurezza

Minimizzare la fiducia.

Il protocollo multi-modello costruisce la verifica.

Le registrazioni on-chain offrono trasparenza.

La logica di verifica rimane aperta.

Verifica che l'accuratezza dell'output raggiunga il 96%.

Tutti i casi d'uso

Adatto per agenti AI autonomi.

Supporta sistemi informatici ad alto rischio.

Automazione finanziaria assistita.

Supporto decisionale migliorato.

L'integrazione come Learnrite riduce gli errori del 84%.

Posizionamento strutturale

Mira evita di costruire modelli AI.

Si concentra sul layer di verifica.

Il modello genera output.

Verifica la conferma dell'integrità.

L'ecosistema raggiungerà 4,5 milioni di utenti entro metà 2025.