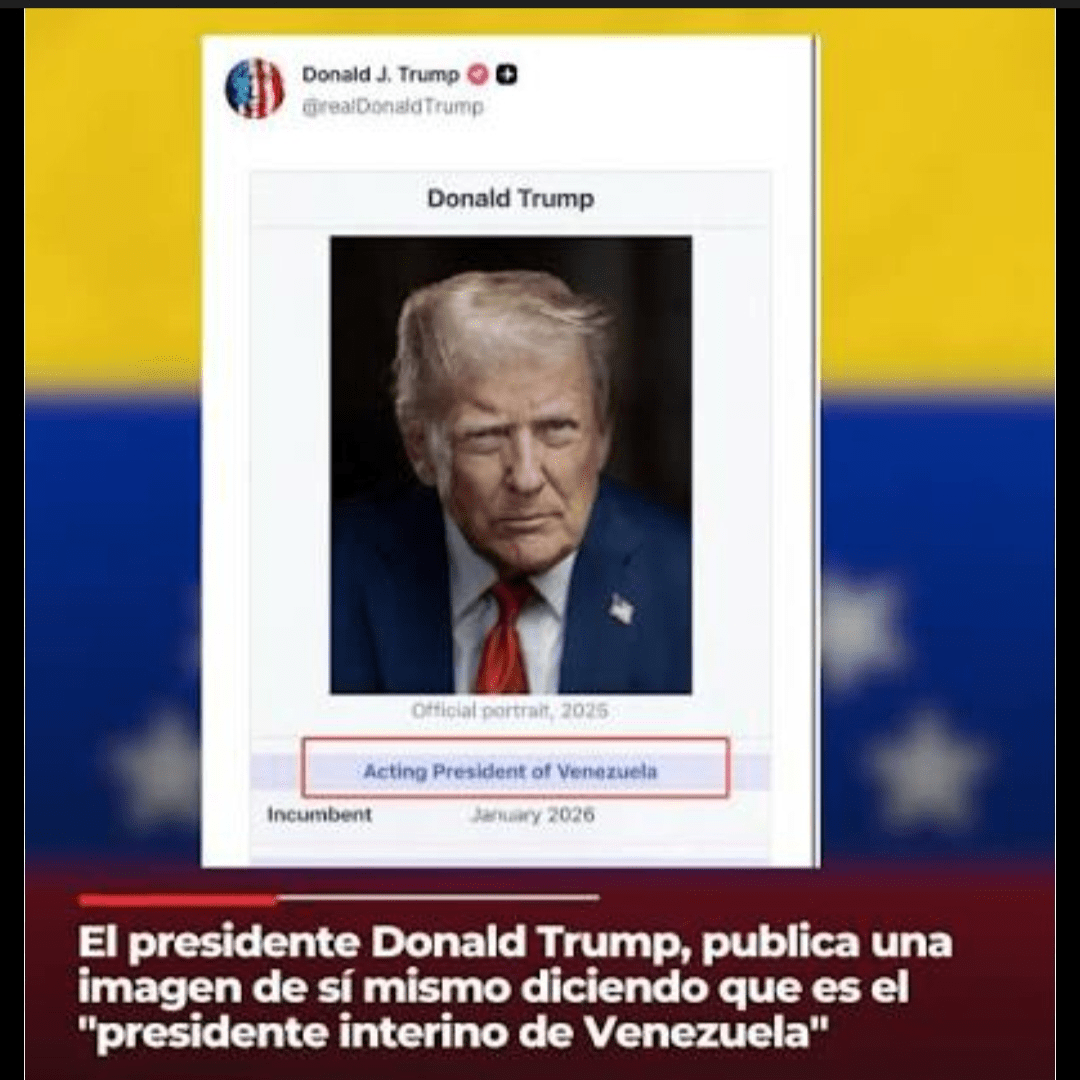

In den letzten Stunden hat ein mit künstlicher Intelligenz generiertes Bild die internationale Aufmerksamkeit erregt: Donald Trump wird in einer Veröffentlichung als "Interimspräsident von Venezuela" dargestellt.

Das digital bearbeitete Werk verbreitete sich rasch in sozialen Medien und löste Debatten über die Authentizität der Informationen und die Leichtigkeit, mit der die KI falsche Autoritätsfiguren erschaffen kann. Abgesehen vom medialen Impact spiegelt dieses Ereignis eine wachsende Herausforderung wider: Wie kann man legitime Inhalte von digital gefälschten Inhalten unterscheiden?

Die Verbreitung von KI-Tools, die extrem realistische Bilder und Texte erzeugen können, stellt eine kritische Herausforderung für Politik, Medien und die öffentliche Meinung dar.

Je zugänglicher die Technologie wird, desto mehr verschwimmt die Grenze zwischen Wahrheit und Fiktion, und die Manipulation von Informationen kann unmittelbare Auswirkungen auf die Wahrnehmung von Führungspersönlichkeiten und politischen Entscheidungen haben.

In diesem Kontext entstehen Protokolle wie Walrus, die darauf abzielen, Identitäten und Glaubwürdigkeit durch überprüfbare Tokens zu zertifizieren. Diese Systeme basierend auf $WAL ermöglichen eine dezentrale Überprüfung der Authentizität einer Veröffentlichung, Aussage oder Bildes und schaffen so ein zuverlässiges Fundament in einem digitalen Ökosystem, das von Informationen überflutet ist.

Tokens fungieren als digitale Zertifikate: Jede Ausgabe ist mit einer Identität oder Institution verknüpft und kann nicht verändert werden, ohne eine Spur zu hinterlassen.

Walrus und ähnliche Technologien werden als Lösung für ein Problem präsentiert, das die KI verschärft: den Verlust des Vertrauens in Informationen.

Zum Beispiel könnte ein Token, der mit einem überprüften Politiker oder Medium verknüpft ist, Benutzer vor manipuliertem oder künstlich generiertem Inhalt warnen und zwischen Fakten und digitalen Simulationen unterscheiden.

Dies schützt nicht nur die Reputation der Quellen, sondern trägt auch zu einem transparenteren und sichereren digitalen Umfeld bei.

Darüber hinaus kann die Integration dieser Protokolle die Überprüfung von Nachrichten und öffentlichen Persönlichkeiten überschreiten.

Organisationen, Fact-Checking-Agenturen und Medien könnten Tokens nutzen, um Dokumente, Veröffentlichungen und Qualifikationen zu zertifizieren, wodurch das Risiko von viralen Desinformationen und auf KI basierenden Reputationsschlägen reduziert wird.

Der Fall von Trump und die Viralität seiner fiktiven Selbstbehauptung ist ein klares Beispiel dafür, wie digitale Manipulation die Politik und die öffentliche Meinung beeinflussen kann.

Allerdings zeigt dies auch eine Chance: Werkzeuge wie Walrus bieten ein konkretes Mittel, um das Vertrauen wiederherzustellen, indem sie die Transparenz der Blockchain-Technologie mit der Identitätsprüfung und der digitalen Reputation verbinden.

In einer Welt, in der die Grenzen zwischen Realität und Fiktion immer verschwommener werden, eröffnet die Verbindung von Künstlicher Intelligenz und Token-Protokollen die Möglichkeit eines zukünftigen Informationsumfelds, das vertrauenswürdig, auditierbar und überprüfbar ist.

Die Frage ist nicht, ob die KI Politik und Kommunikation verändern wird, sondern ob wir über die richtigen Werkzeuge verfügen, um sicherzustellen, dass das, was wir sehen und teilen, echt ist. Je schwieriger wird es, diese Aspekte zu managen und ethisch zu handhaben.