Als ich zum ersten Mal den Ausdruck „verifizierte künstliche Intelligenz“ hörte, war meine Reaktion nicht die unmittelbare Aufregung, die normalerweise neue Ankündigungen von KI-Infrastrukturen umgibt, sondern ein stilleres Gefühl der Anerkennung, weil es etwas anerkennt, das Menschen, die eng mit maschinellen Lernsystemen arbeiten, schon lange wissen: dass die wirkliche Barriere für vertrauenswürdige KI nie die Erzeugung von Ausgaben war, sondern die Fähigkeit, nachzuweisen, dass diese Ausgaben auf eine zuverlässige, nachvollziehbare und überprüfbare Weise produziert wurden, anstatt aus einer Blackbox zu stammen, die niemand zuverlässig prüfen oder reproduzieren kann.

Jahrelang konzentrierte sich die Diskussion über künstliche Intelligenz auf Fähigkeit, Skalierung und Geschwindigkeit, was zur schnellen Bereitstellung zunehmend leistungsfähiger Modelle führte, die Texte, Codes, Bilder und Entscheidungen mit bemerkenswerter Flüssigkeit generieren können. Dennoch hat dieser Fortschritt auch eine grundlegende Schwäche offenbart, die unmöglich zu ignorieren ist, da diese Systeme beginnen, finanzielle Entscheidungen, Forschungsergebnisse und digitale Infrastrukturen zu beeinflussen, weil Benutzer oft gebeten werden, Ausgaben zu vertrauen, die sie nicht unabhängig überprüfen können, und Entwickler erwartet werden, Modelle zu verteidigen, deren Denkprozesse weitgehend intransparent bleiben.

Das traditionelle KI-Bereitstellungsmodell legt die Verantwortung für Vertrauen auf den Benutzer, was bedeutet, dass Einzelpersonen, Organisationen und Plattformen entscheiden müssen, ob sie den Output eines Systems glauben, ohne einen klaren Weg zu haben, die Integrität der Berechnung, die ihn erzeugt hat, zu überprüfen, und während diese Anordnung für risikoarme Aufgaben wie das Erzeugen von Marketingtexten oder das Zusammenfassen von Dokumenten funktionieren mag, wird sie schnell fragil, wenn KI beginnt, an Systemen teilzunehmen, in denen Genauigkeit, Rechenschaftspflicht und Transparenz keine optionalen Merkmale, sondern grundlegende Anforderungen sind.

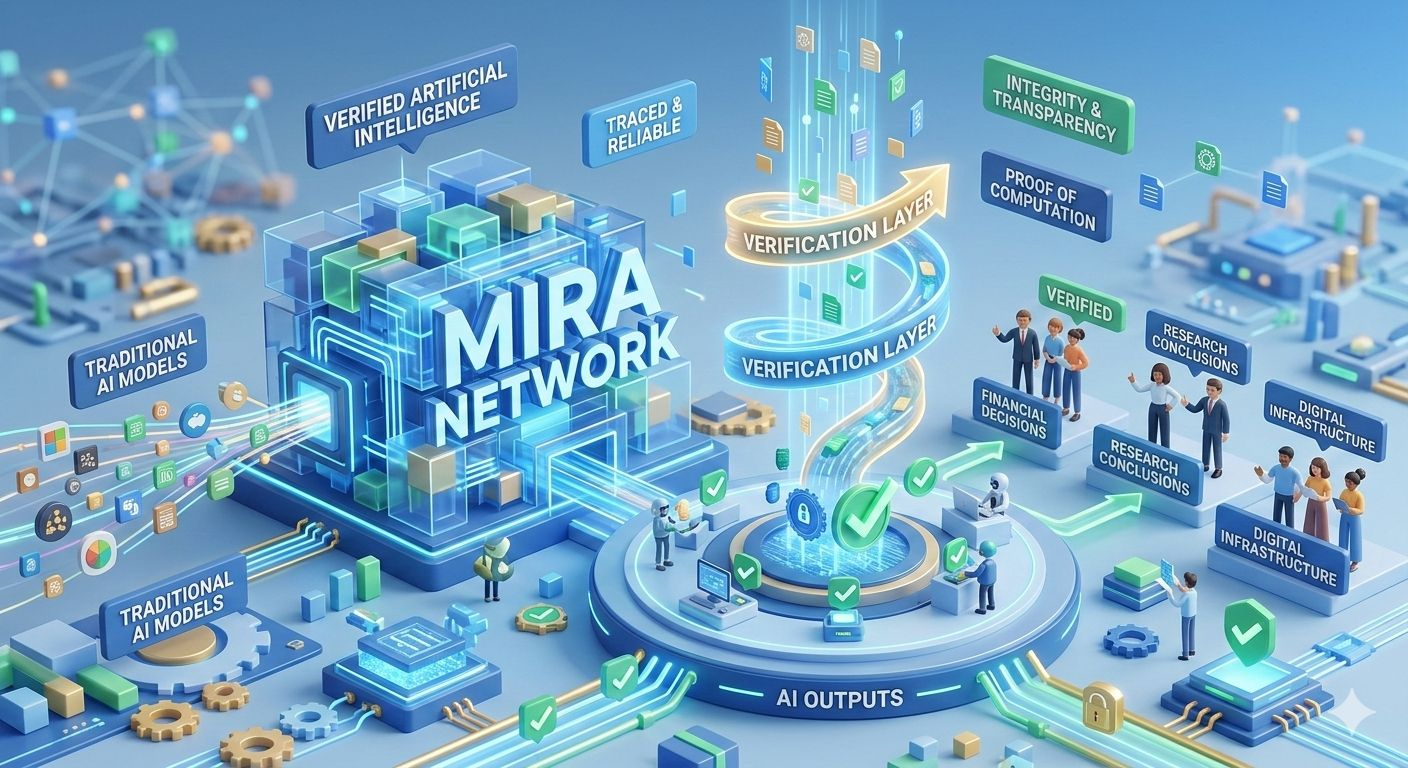

In diesem Kontext beginnt Mira Network wichtig zu werden, denn das Konzept dahinter besteht nicht einfach darin, eine weitere Plattform für künstliche Intelligenz zu schaffen oder im Wettlauf um größere Modelle zu konkurrieren, sondern vielmehr darin, eine Verifizierungsebene einzuführen, die es ermöglicht, dass KI-Ausgaben von kryptografischen oder rechnerischen Beweisen begleitet werden, dass der zugrunde liegende Prozess genau so ablief, wie behauptet, und damit KI von einem System, das lediglich Antworten produziert, in ein System transformiert wird, das die Integrität demonstrieren kann, wie diese Antworten produziert wurden.

Sobald die Diskussion von der Generierung zur Verifizierung wechselt, tauchen sofort eine neue Reihe von Infrastrukturfragen auf, denn die Erzeugung verifizierbarer KI-Ergebnisse erfordert mehr als nur ein Modell auf einem Server auszuführen und ein Ergebnis zurückzugeben, da es das Verfolgen rechnerischer Schritte, das Verankern von Beweisstrukturen, das Koordinieren von Verifizierungsprozessen über verteilte Teilnehmer hinweg und die Gewährleistung, dass die Kosten und die Latenz der Verifizierung praktisch genug bleiben, um reale Anwendungen zu unterstützen, beinhaltet, anstatt eine theoretische Garantie zu werden, die sich nur wenige Systeme leisten können.

Was aus dieser Architektur entsteht, ist nicht nur eine technische Verbesserung, sondern ein struktureller Wandel, wie künstliche Intelligenzsysteme in digitale Ökosysteme integriert werden, denn Verifizierung führt eine völlig neue Betriebsebene ein, die zwischen roher KI-Berechnung und Benutzerkonsum sitzt, und diese Ebene beginnt, Infrastruktur zu ähneln, genau wie Zahlungsabwickler, Cloud-Anbieter und Blockchain-Validatoren unsichtbare, aber wesentliche Komponenten moderner digitaler Dienste bilden.

Die Auswirkungen dieses Wandels werden klarer, wenn man bedenkt, wie Vertrauen derzeit in der KI-Branche funktioniert, wo Glaubwürdigkeit oft in einer Handvoll großer Organisationen konzentriert ist, deren Modelle weitgehend aufgrund von Markenreputation, Forschungsansehen oder Plattformdominanz akzeptiert werden, was bedeutet, dass Benutzer letztendlich Institutionen vertrauen, anstatt der verifizierbaren Integrität der Berechnung selbst, wodurch eine Abhängigkeitsstruktur entsteht, die nur so lange funktioniert, wie diese Institutionen sowohl kompetent als auch wohlwollend bleiben.

Ein Verifizierungsnetzwerk verändert diese Dynamik, indem es die Verantwortung für die Validierung über ein breiteres System von Teilnehmern verteilt, die unabhängig bestätigen können, dass eine bestimmte Modellausführung einer bestimmten Reihe von Regeln oder Berechnungen gefolgt ist, was das Vertrauen allmählich von einem institutionellen Versprechen in eine technische Eigenschaft verwandelt, die überprüft, reproduziert und validiert werden kann, unabhängig davon, welches Unternehmen ursprünglich das Ergebnis erzeugt hat.

Die Einführung von Verifizierung schafft jedoch auch eine neue Reihe von operationellen Überlegungen, die viele Beobachter unterschätzen, da die Verifizierung von KI-Ausgaben das Management von rechnerischen Beweisen, die Koordination von Validierern, die Aufrechterhaltung von Anreizstrukturen und die Gewährleistung der Resilienz der Verifizierungsebenen während Zeiten hoher Nachfrage oder feindlicher Aktivitäten erfordert, was bedeutet, dass die Zuverlässigkeit des Verifizierungsnetzwerks selbst ein kritischer Faktor dafür wird, ob das gesamte System in großem Maßstab funktionieren kann.

In diesem Sinne führt Mira Network nicht einfach ein Merkmal ein, das KI-Ausgaben leichter vertrauenswürdig macht, sondern legt stattdessen das Fundament für eine neue Klasse von Infrastrukturbetreibern, deren Rolle der von Finanzclearingstellen oder Blockchain-Validatoren ähnelt, da sie am Prozess der Bestätigung rechnerischer Integrität und der Aufrechterhaltung der Zuverlässigkeit eines Verifizierungsmarktplatzes teilnehmen, der zwischen KI-Produzenten und KI-Konsumenten steht.

Diese Entwicklung hat wichtige Marktimplikationen, denn sobald Verifizierung eine standardmäßige Erwartung für KI-Ausgaben wird, beginnt sich die Wettbewerbslandschaft von reiner Modellfähigkeit hin zur Qualität der Verifizierungspipeline zu verschieben, die diese Modelle umgibt, einschließlich Faktoren wie wie schnell Ergebnisse verifiziert werden können, wie transparent der Verifizierungsprozess ist, wie robust das Netzwerk während Zeiten intensiver Nutzung bleibt und wie widerstandsfähig das System gegen Manipulation oder Betrug ist.

Das Ergebnis ist, dass Anwendungen der künstlichen Intelligenz zunehmend nicht nur danach konkurrieren können, wie intelligent ihre Modelle erscheinen, sondern auch danach, wie zuverlässig sie beweisen können, dass Intelligenz korrekt ausgeführt wurde, was subtil, aber signifikant den Standard für das, was Benutzer erwarten, erhöht, wenn sie mit KI-gesteuerten Systemen interagieren, die Entscheidungen in der realen Welt oder finanzielle Aktivitäten beeinflussen.

Es gibt auch eine tiefere strategische Dimension dieser Evolution, denn verifizierte KI führt ein Modell von Rechenschaftspflicht ein, das traditionelle maschinelles Lernen-Plattformen Schwierigkeiten hatten zu bieten, da Entwickler und Organisationen sich nicht mehr ausschließlich auf die Autorität ihrer Infrastruktur verlassen können, sondern stattdessen sicherstellen müssen, dass ihre Systeme innerhalb von Rahmenwerken arbeiten, die unabhängiger Verifizierung und Überprüfung standhalten können.

Wenn dieses Modell erfolgreich ist, wird die langfristige Bedeutung von Netzwerken wie Mira nicht nur an der Anzahl der KI-Aufgaben gemessen, die durch ihre Infrastruktur verarbeitet werden, sondern daran, wie effektiv sie das Vertrauen in künstliche Intelligenz von einer sozialen Vereinbarung in einen überprüfbaren technischen Standard verwandeln, der zuverlässig arbeitet, selbst wenn die zugrunde liegenden Systeme komplexer, autonomer und tiefer im wirtschaftlichen und informationellen Gefüge des Internets verankert werden.

Was letztendlich zur Frage führt, die am wichtigsten ist, wenn man den Aufstieg der verifizierten künstlichen Intelligenz bewertet, denn der echte Test dieser Architektur wird nicht eintreten, wenn Systeme unter idealen Bedingungen arbeiten, sondern wenn die Nachfrage steigt, feindliche Akteure versuchen, Ausgaben zu manipulieren, und die wirtschaftlichen Anreize der Verifizierungsteilnehmer unter Druck gesetzt werden, da die langfristige Glaubwürdigkeit von verifizierter KI davon abhängen wird, ob Netzwerke wie Mira Integrität, Transparenz und Zuverlässigkeit genau dann aufrechterhalten können, wenn diese Qualitäten am schwierigsten zu garantieren sind.

@Mira - Trust Layer of AI #Mira $MIRA