Früher dachte ich, die Zuverlässigkeit von KI würde sich im Laufe der Zeit natürlich verbessern, indem man Modelle größer macht, ihnen mehr Daten zuführt, sie länger trainiert und das Halluzinationsproblem langsam verschwindet. Die Realität ist, dass es nicht wirklich so funktioniert. Modelle werden flüssiger, ja, aber Flüssigkeit ist nicht dasselbe wie Wahrheit. Das ist der Punkt, an dem das Mira-Netzwerk meine Aufmerksamkeit erregte.

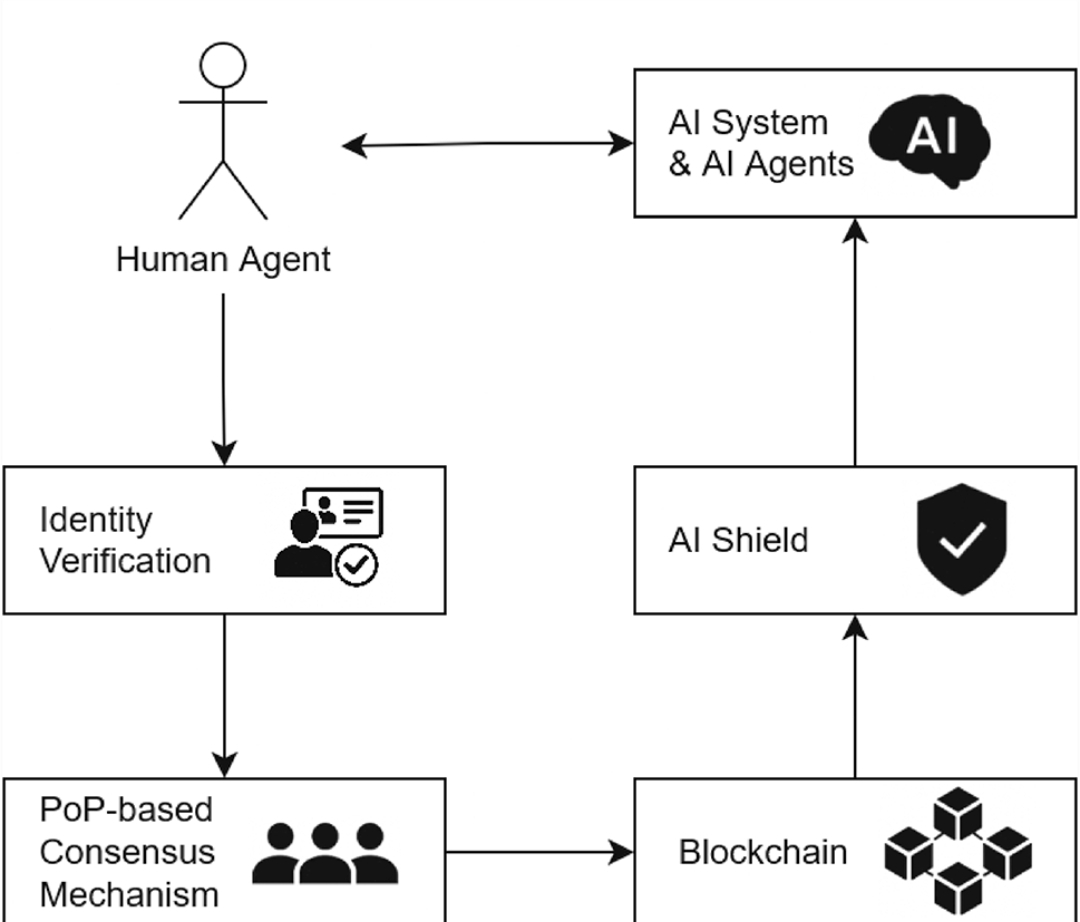

Mira versucht nicht, mit großen KI-Labors zu konkurrieren. Es ist kein weiteres Modell, das weniger Fehler verspricht. Es ist als dezentrale Verifizierungsschicht aufgebaut, die nach der Generierung von Ausgaben durch die KI und bevor wir entscheiden, ihr zu vertrauen, sitzt. Diese Platzierung ist wichtig. Anstatt ein Modell zu fragen, korrekt zu sein, zerlegt Mira seine Ausgaben in kleinere Ansprüche und verteilt diese Ansprüche auf unabhängige Validierer. Diese Validierer, die separate KI-Systeme sein können, bewerten jeden Anspruch und erreichen Konsens mithilfe von Blockchain-Koordination und wirtschaftlichen Anreizen.

Statt einer einzelnen, selbstbewussten Antwort verlässt man sich also auf verteilte Zustimmung. Das ist ein großer Wandel in der Art und Weise, wie wir über die Zuverlässigkeit von KI nachdenken. Das Blockchain-Ledger protokolliert Validierungsentscheidungen und die Anreizstruktur fördert ehrliche Bewertungen. Validatoren haben ein Interesse am Prozess, was bedeutet, dass Nachlässigkeit Konsequenzen hat. Wahrheit wird zu etwas, das durch Anreize durchgesetzt wird, nicht nur durch Reputation.

Was das jetzt relevant macht, ist der Aufstieg autonomer KI-Agenten. Solange Menschen die Ausgaben doppelt überprüfen, bleibt der Schaden durch Halluzinationen begrenzt. Aber sobald KI-Systeme anfangen, finanzielle Transaktionen auszuführen, Workflows zu genehmigen oder Forschung zu generieren, die für ernsthafte Entscheidungen verwendet wird, sinkt die Toleranz für Fehler. Sie benötigen Ausgaben, die prüfbar und verifizierbar sind, nicht nur überzeugend.

Mira geht davon aus, dass Halluzinationen passieren werden. Es entwirft sich um diese Tatsache, anstatt vorzugeben, dass sie verschwinden werden. Das fühlt sich realistisch an. Natürlich gibt es offene Fragen zur Skalierbarkeit, Latenz und Validatorenvielfalt. Komplexes Denken in atomare Ansprüche zu zerlegen ist nicht trivial und Kollusionsrisiken müssen sorgfältig verwaltet werden.

Die Richtung ist weiterhin klar. Intelligenz ohne Überprüfung skaliert nicht sicher. Mira positioniert sich als die Vertrauensinfrastruktur für KI, die probabilistische Ausgaben in konsensgestützte Informationen umwandelt. Es mag nicht auffällig sein, aber wenn KI weiterhin in kritische Systeme integriert wird, werden Überprüfungsebenen wie diese nicht optional sein, sie werden notwendig sein.