Vor einigen Tagen habe ich mit ein paar Freunden, die in großen Unternehmen an großen Modellen arbeiten, getrunken und wir sprachen über den aktuellen AI-Hype. Die heutige AI ähnelt tatsächlich sehr dem Internet von damals und wurde sogar auf das Niveau von Druckmaschinen und Dampfmaschinen gehoben, die die Zivilisation verändern. Aber wie sieht die Realität aus? Ideale sind verlockend, die Realität hingegen ist so mager, dass man denkt, man sollte „aufhören“. Alle sagen, dass AI Ärzte und Anwälte ersetzen wird, aber wenn es um riskante Entscheidungen geht, wer würde sein Leben einem Chatbot anvertrauen, der jederzeit ernsthaft Unsinn reden könnte? Dieses „himmlische Wohlstand“ ist greifbar, aber wegen dieser verdammten Illusionen und Verzerrungen ist AI immer noch in einer Spielzeugkiste aus kostengünstigen, fehlertoleranten Modellen gefangen, die nur zum Plaudern geeignet ist und nicht für ernsthafte Aufgaben.

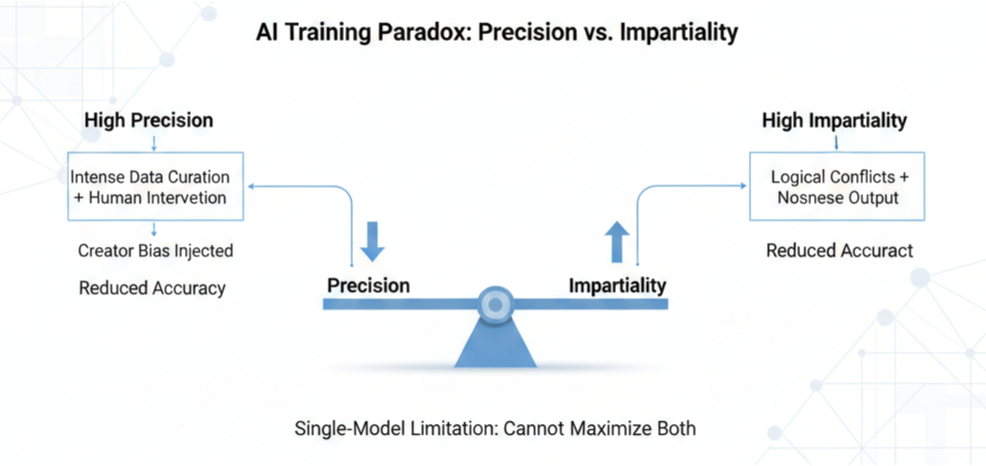

Ich habe über dieses sogenannte „Trainingsparadoxon“ nachgedacht; es ist wie das Gesetz der Energieerhaltung in der KI-Welt, das alle Modelle fest auf den Boden drückt. Wenn du die Genauigkeit erhöhen und die frustrierenden Illusionen reduzieren möchtest, musst du die Trainingsdaten verrückt intensiv manuell eingreifen und filtern. Aber durch dieses Filtern wird die Voreingenommenheit des Erstellers unweigerlich in die Essenz des Modells eingespeist, was die Genauigkeit natürlich schmälern kann. Umgekehrt, wenn du versuchst, eine große, umfassende Sammlung von verschiedenen Daten zu speisen, um der sogenannten Objektivität gerecht zu werden, wird das Modell aufgrund von logischen Konflikten inkohärent. Es ist wie eine präzise Waage; die linke Seite ist Präzision, die rechte Seite ist Gerechtigkeit, und du kannst nie in einem einzelnen Modell beide Seiten gleichzeitig maximieren. Selbst diese übertrieben gepriesenen Feinjustierungsmodelle werden, sobald sie auf ein unbekanntes „lebenslanges Lern“-Szenario treffen, ebenfalls scheitern.

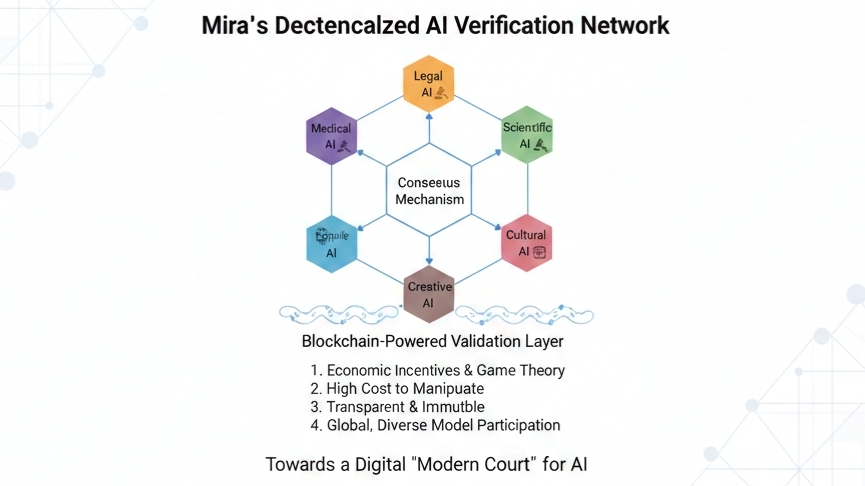

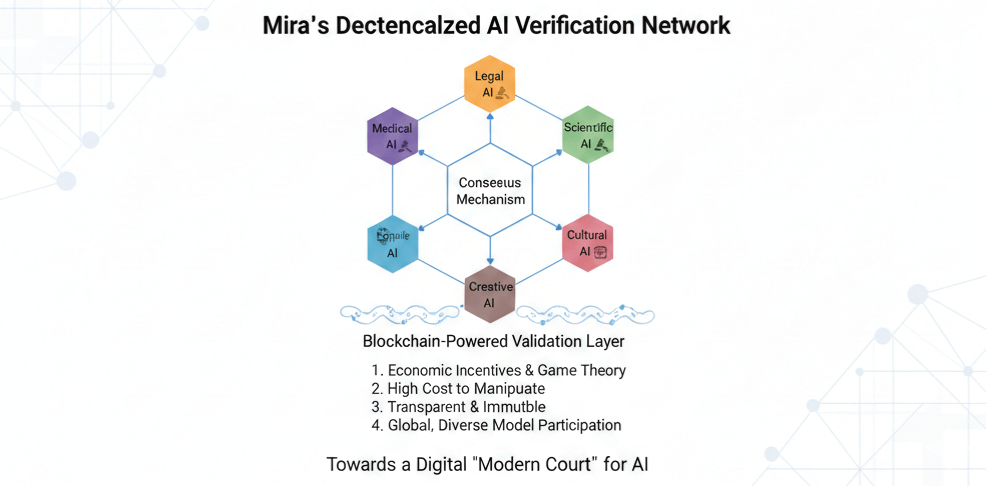

Kurz gesagt, dieses Einzelkämpfer-Modell hat bereits die physikalische Decke erreicht. Kürzlich habe ich ein Projekt namens Mira bemerkt, deren Ansatz tatsächlich interessant ist. Ein Modell könnte lügen, aber eine Gruppe von Modellen mit unterschiedlichen Hintergründen arbeitet zusammen, um einen Konsensmechanismus zu schaffen. Die Illusionen werden ausgeglichen, die Vorurteile werden ausbalanciert, und das ist tatsächlich viel zuverlässiger, als darauf zu hoffen, dass OpenAI oder Google in ihren geschlossenen Laboren irgendeine „ultimative Antwort“ finden. Schließlich, wenn die Wahrheit in den Händen von nur wenigen zentralisierten Knoten liegt, dann ist dieser systematische Fehler das, was einem kalte Schauer über den Rücken jagt.

Mira's härteste Methode ist es, diesen Konsensmechanismus auf die Blockchain zu bringen. Es ist nicht mehr nur ein einfaches Modell, das übereinander gestapelt wird, sondern es wurde ein dezentrales Validierungsnetzwerk aufgebaut. Möchtest du den Konsens manipulieren? Tut mir leid, das kostet enorme wirtschaftliche und rechnerische Aufwendungen. Diese Validierungsschicht, die durch wirtschaftliche Anreize und Spieltheorie aufgebaut wurde, ist wie eine digitale Fessel für die rasenden KI, und sie bietet auch einen Spiegel, der die Dämonen offenbart. Es hängt nicht mehr vom Vertrauen einer bestimmten Autorität ab, sondern lässt Modelle, die weltweit verteilt sind und unterschiedliche Kulturen und Fachgebiete repräsentieren, gegeneinander spielen, um am Ende einen belastbaren Beweis zu liefern. Diese Logik erinnert mich an eine Metapher: Die heutigen KI-Modelle sind wie Lehrlinge, die noch nicht ausgebildet sind, jeder mit eigenen geheimen Absichten und Stärken, während Mira dabei ist, ein wasserdichtes modernes Gericht aufzubauen, das die Absurdität des Individuums mit der Gerechtigkeit von Programmen einschränkt. In dieser digitalen Welt sind einzelne Genies oft unzuverlässig; nur dieses kalte, transparente und unveränderliche Container-Kooperationsnetzwerk ist der letzte Kilometer auf dem Weg zur echten allgemeinen künstlichen Intelligenz.